DeepSeek+本地知识库:真的太香了(修订版)

整个操作下来,AnythingLLM 的体验没有cherry好。AnythingLLM就像一个包壳的web应用(后来查了下,确实是)。AnythingLLM 得具备一定的程序思维,给技术人员用的。非技术人员还是使用cherry吧。作为喜欢折腾的开发人员,我们可以结合dify使用。个人知识库+本地大模型的优点隐私性很好,不用担心自己的资料外泄、离线可用在工作和学习过程中对自己整理的文档,能快速找到,

把之前的deepseek +本地知识库的部署内容做了一版修订。

增加内容:

1, ollama 安装

2,cherry studio在线模型配置

3,anythingLLM的在线以及文本分割配置

相关联的文章。

国产AI之光!DeepSeek本地部署教程,效果媲美GPT-4,

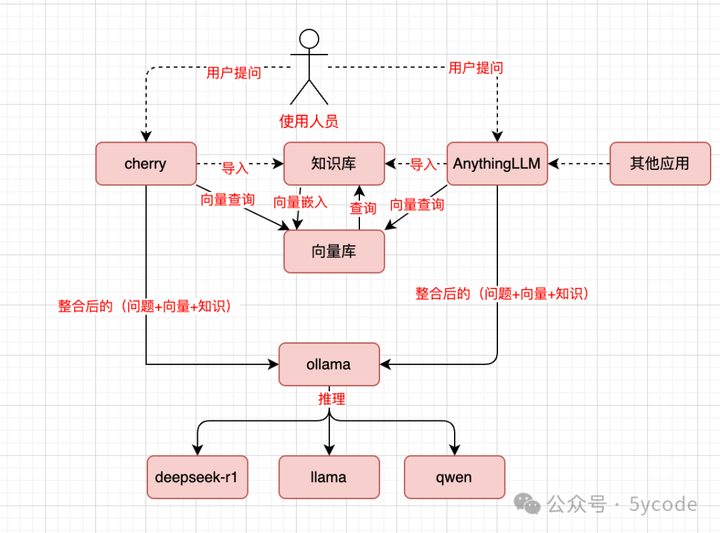

流程

先画个数据流程流程。

Ollama安装(非必须)

14B及以上有推理能力,32b比较实用。显卡最低12GB。内存最好32GB.

相关的软件,我已经放入到网盘,网不好的同学,可以直接下载。

下载链接:https://pan.quark.cn/s/b69829720b68

电脑配置低:可以参考

下载ollama

https://ollama.com/download/

默认为当前电脑的对应的版本,直接下载即可。下载以后,一路点点点即可。

环境变量设置

安装完以后先不要使用,先设置下环境变量。默认模型下载到C盘。一个模型最小也得几个GB.

通过 我的电脑->右键-> 属性-> 高级系统设置-> 环境变量->新建用户变量即可。

添加图片注释,不超过 140 字(可选)

OLLAMA_HOST: 0.0.0.0

OLLAMA_MODELS:E:\ai\ollama\models

OLLAMA_HOST:设置为0.0.0.0 会将ollama服务暴露到所有的网络,默认ollama只绑定到了127.0.0.1,只能通过localhost或0.0.0.0访问。

OLLAMA_MODELS:设置了模型的存放的地址。

https://ollama.com/library/deepseek-r1

安装DeepSeek模型(可选)

打开:https://ollama.com/library/deepseek-r1选择适合自己的模型,12GB~16GB显存建议最大选择14B,24GB显存建议32B.

安装语言模型

# 下载模型

ollama pull deepseek-r1:14b

# 下载或运行模型,正常ollama不会运行模型的

ollama run deepseek-r1:14b安装向量模型

基于本地的deepseek搭建个人知识库。使用本地服务,安装嵌入模型,用于将文本数据转换为向量标识的模型。

需要先下载向量模型

# 命令行窗口执行拉取下即可。

ollama pull bge-m3基于Cherry Studio搭建(首选)

cherry Studio 文本分割不能选择文本长度和重叠度。

下载cherry studio

根据自己的环境下载cherry studio

安装的时候,注意安装到其他磁盘,不要在c盘安装。

本地模型知识库

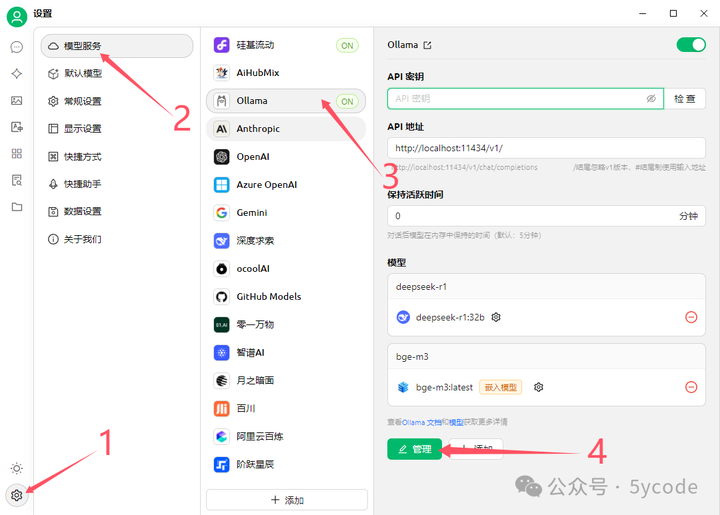

配置本地ollama

操作步骤:

-

找到左下角设置图标

-

选择模型服务

-

选择ollama

-

点击管理

-

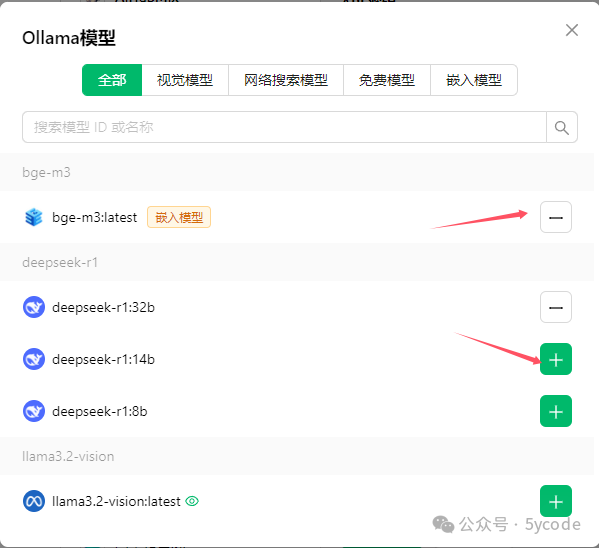

点击模型后面的加号(会自动查找到本地安装的模型)

-

减号表示已经选择了

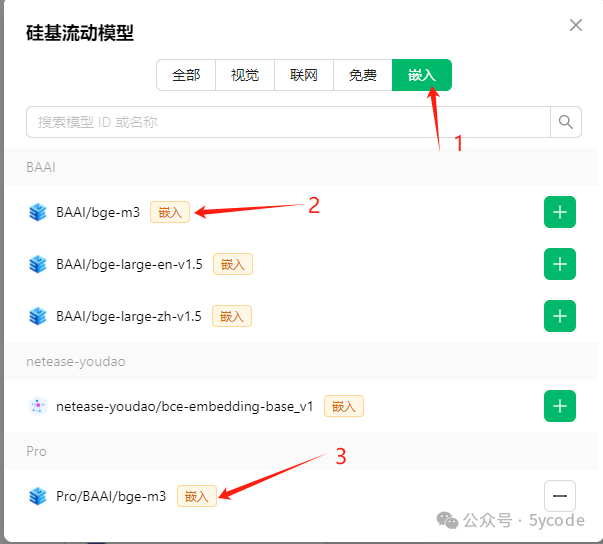

配置在线模型:

1,在模型服务里,选择对应的模型服务商,比如硅基流动

2,注意开关

3,填写自己的密钥

1,选择嵌入模型

2,选择要添加的模型

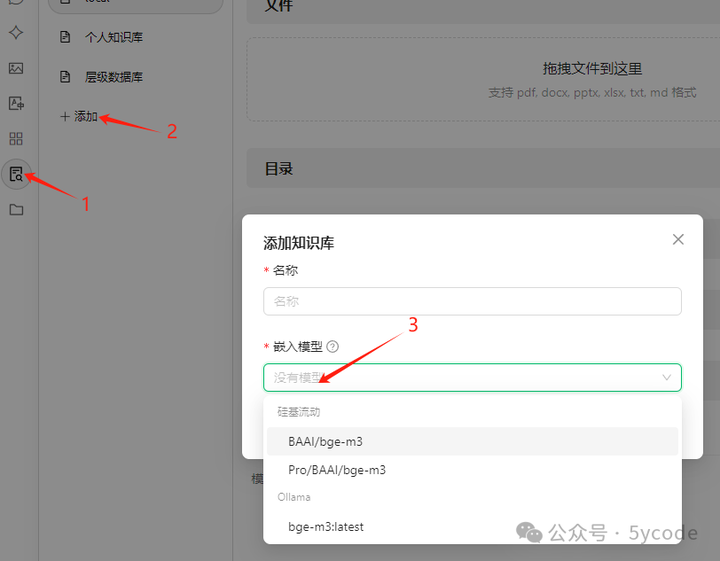

知识库配置

-

选择知识库

-

选择添加

-

选择嵌入模型,这个时候有在线和本地的

-

填写知识库名称

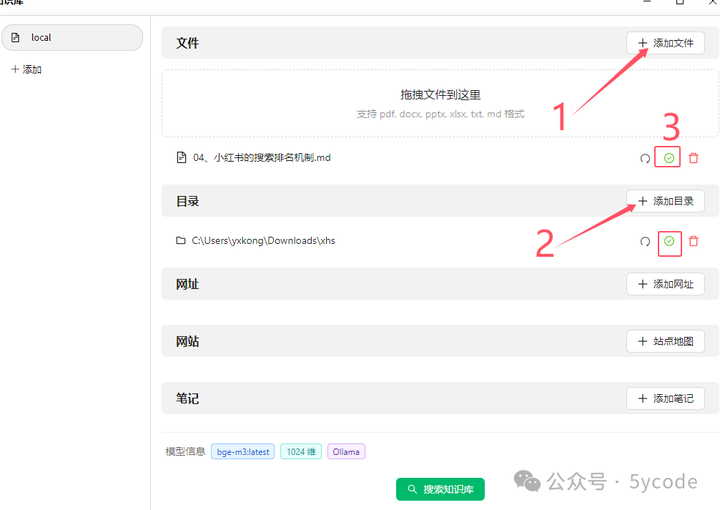

添加知识文档

cherry可以添加文档,也可以添加目录(这个极其方便),添加完以后出现绿色的对号,表示向量化完成。

搜索验证

-

点击搜索知识库

-

输入搜索顺序

-

点击搜索 大家可以看下我搜索的内容和并没有完全匹配,不过已经和意境关联上了。

大模型处理

-

点击左上角的聊天图标

-

点击助手

-

点击默认助手(你也可以添加助手)

-

选择大模型

-

选择本地deepseek,也可以选择自己已经开通的在线服务

-

设置知识库(不设置不会参考)

-

输入提问内容

-

发问

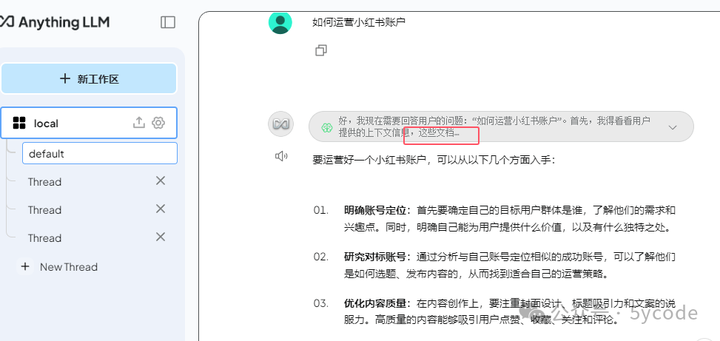

大家可以看到deepseek已经把结果整理了,并告诉了我们参考了哪些资料。

满血版

差别就是大模型的选择,在模型服务里配置下在线的deepseek服务即可。

如果你的知识库有隐私数据,不要联网!不要联网!不要联网!

方案二 基于AnythingLLM搭建

下载AnythingLLM Desktop

下载以后,安装的时候,注意安装到其他磁盘,不要在c盘安装。

AnythingLLM 配置

点击左下角的设置

Ollama配置

1. 点击 LLM首选项

2. 选择ollama作为模型提供商

3. 选择已安装的deepsek 模型

4. 注意下地址,如果本地就127.0.0.1

5. 保存

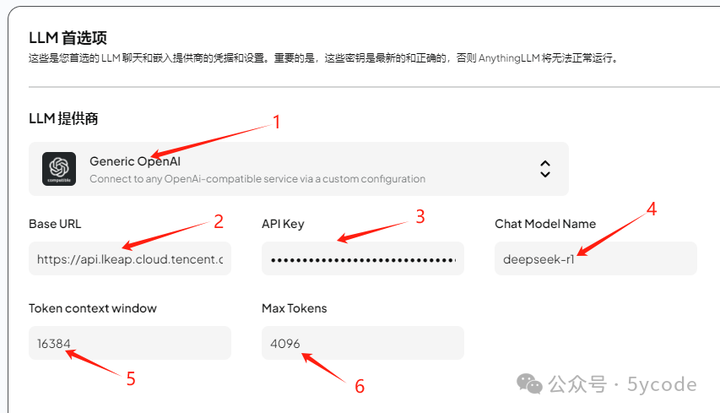

腾讯云配置(推荐,目前最稳定的)

1,选择openAi通用接口

2,配置腾讯云的大模型BASE地址 : https://api.lkeap.cloud.tencent.com/v1

3,配置获取到的APIKEY

4,输入模型:deepseek-r1

5, 设置Token context window 模型单次能够处理的最大长度(输入+输出),如果你的使用知识库建议放大,想多关联上下文也调大;

6,max tokens 模型最大生成token

apiKey申请地址

https://console.cloud.tencent.com/lkeap/api

接口地址

https://cloud.tencent.com/document/product/1772/115969

ollama show deepseek-r1:14b

Model

architecture qwen2

parameters 14.8B

context length 131072

embedding length 5120

quantization Q4_K_M14b的最大长度是131072,ollama 默认是不用设置的。

向量库模型配置

切换使用本地ollama,也可以自带的。

1,选择ollama

2,选择对应的向量模型

3,设置分段最大长度

4,注意下url

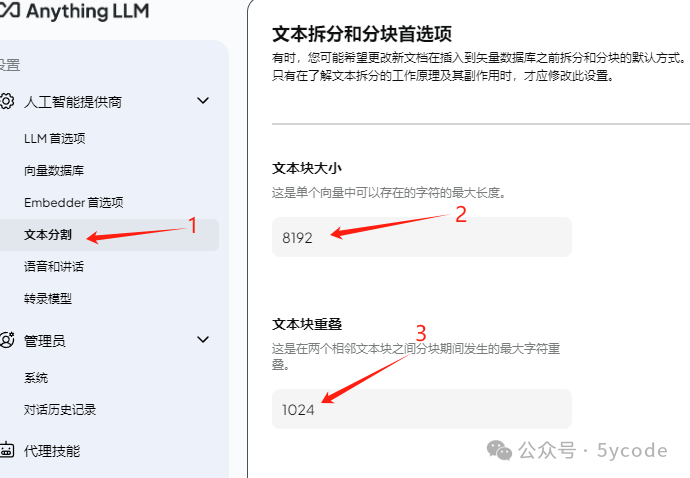

文本分割配置

1,设置文本块大小,根据自己的文本输入。

2,设置文本块重叠(建议重叠10%~25%)

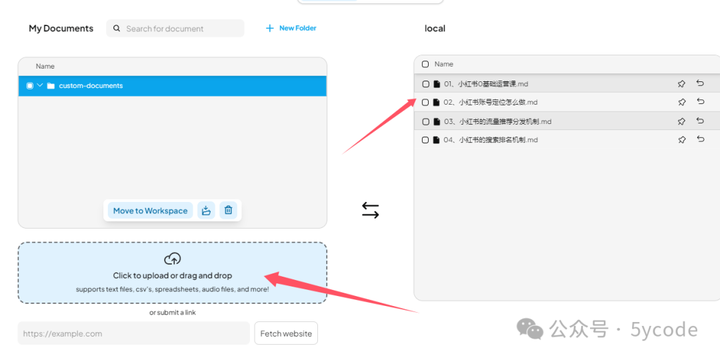

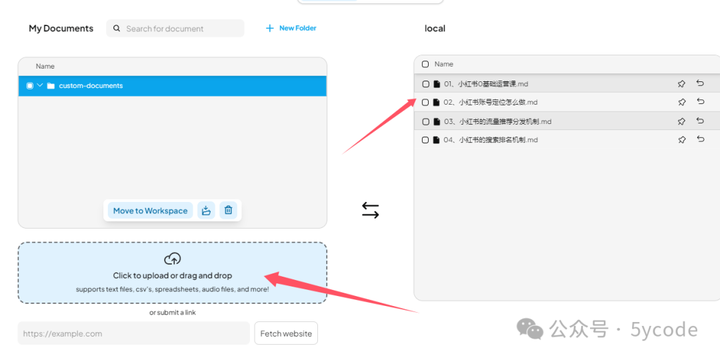

配置工作区

-

在1里点击New Thread 新建一个聊天框

-

默认会话

-

上传知识库文档

将文档拖拽到上传框。ps: 只需要拖拽一次就行了,它在聊天框能看到。不知道为什么,我这拖拽以后,没看到上传成功,然后又拖拽了几次。然后聊天框就好多份。

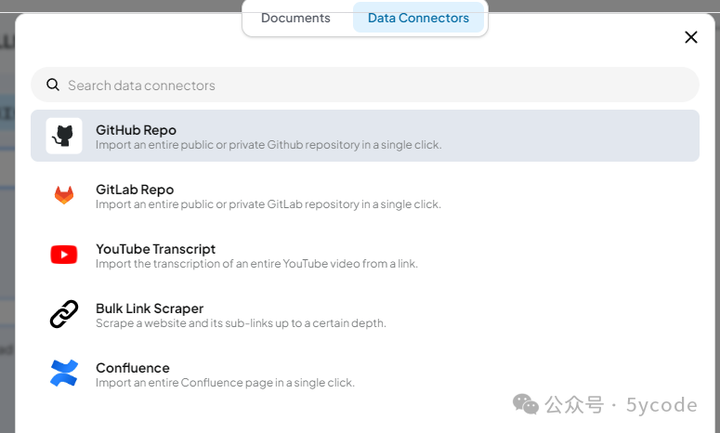

当然你可以配置远程文档,confluence、github都可以。

ps: 需要注意的是文档在工作区间内是共用的。

api功能

AnythingLLM 可以提供api访问的功能,这个可以作为公共知识库使用。

总结

整个操作下来,AnythingLLM 的体验没有cherry好。AnythingLLM就像一个包壳的web应用(后来查了下,确实是)。AnythingLLM 得具备一定的程序思维,给技术人员用的。非技术人员还是使用cherry吧。作为喜欢折腾的开发人员,我们可以结合dify使用。

最后

个人知识库+本地大模型的优点

-

隐私性很好,不用担心自己的资料外泄、离线可用

-

在工作和学习过程中对自己整理的文档,能快速找到,并自动关联

-

在代码开发上,能参考你的开发习惯,快速生成代码

创作不易,辛苦大家动动发财的小手。

if 文章有用:

点赞() # 👍 小手一抖,bug没有

收藏() # 📂 防止迷路,代码永驻

关注() # 🔔 追更最新内容

else:

留言吐槽() # 💬 评论区等你来战最后,我们邀请了各个AI赛道的极客和大咖,开了一个10多天的免费公开课,有图文分享,有直播实操讲解。

如果你想深度使用学习AI,并且想要抓住AI风口赚钱,请尽快扫码进群听课程分享。

名额有限,先到先得!

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)