wgan人脸_假作真时真亦假 人工智能时代的真假人脸

导言深度学习(deep learning)作为最重要的新一代人工智能技术需要大量的数据作为驱动(data-driven),数据量的大小在一定程度上决定了深度学习模型性能的好坏。深度学习的研究很多情况下都是基于已有的数据集,而并不关心数据的来源和获取。近年来,越来越多的研究者开始关注数据的生成问题,即期望利用深度学习算法来随机产生逼真的假数据,达到以假乱真的效果。随着生成模型的不断研究尤其...

导言

深度学习(deep learning)作为最重要的新一代人工智能技术需要大量的数据作为驱动(data-driven),数据量的大小在一定程度上决定了深度学习模型性能的好坏。深度学习的研究很多情况下都是基于已有的数据集,而并不关心数据的来源和获取。近年来,越来越多的研究者开始关注数据的生成问题,即期望利用深度学习算法来随机产生逼真的假数据,达到以假乱真的效果。随着生成模型的不断研究尤其是生成对抗网络(generative adversarial network, 简称GAN)的提出,生成的假数据已经达到了真假难分的程度,比如上图中的人脸图像全是GAN模型随机生成的。本文将着重介绍生成对抗网络在人脸图像生成以及人脸表情智能编辑方面的最新进展。

1

生成对抗网络(GAN)简介

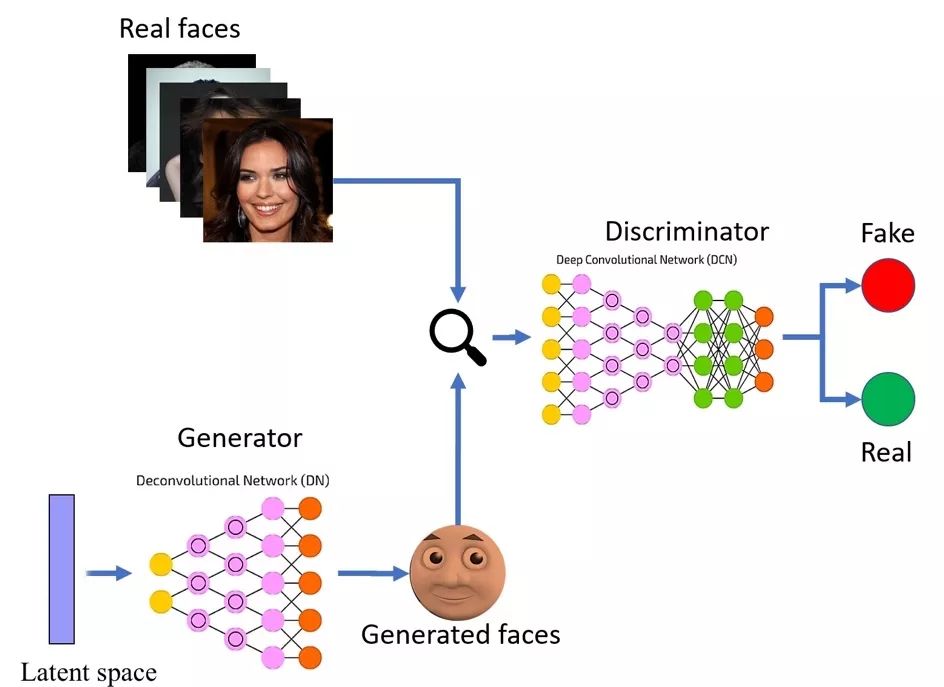

生成对抗网络,通常称为GAN[1]是由谷歌研究员(现在在苹果公司)Ian Goodfellow 2014提出来的,其论文发表至今在Google Scholar上已有11,650的引用量,据报道[2]这个想法是他和朋友在酒吧里想到的。GAN要解决的问题是如何从训练样本中学习出新样本,本质上是非监督式学习的一种方法,通过让两个神经网络相互博弈的方式进行学习。如下图所示,生成对抗网络由一个生成网络(generator)与一个判别网络(discriminator)组成。生成网络从潜在空间(latent space)中随机取样作为输入,其输出结果需要尽量模仿训练集中的真实样本比如人脸照片。判别网络的输入则为真实样本以及生成网络的输出,其目的是将生成网络的输出从真实样本中尽可能的进行区分、判断其真假(Real or Fake),同时生成网络则要尽可能地欺骗判别网络。两个网络相互对抗、交替训练,不断调整参数,最终使判别网络无法判断生成网络的输出结果是否真实。

GAN模型不仅仅只限于虚构图像生成,还可用于改善图像质量,其应用范围已经非常广泛。特别地,GAN还被应用到天文科学研究中,用于模拟重力透镜以进行暗物质(dark matter)研究[3]。卷积神经网络之父、Facebook首席人工智能科学家Yann LeCun描述生成式对抗网络是“机器学习这二十年来最酷的想法”。

2

DCGAN

最开始的GAN模型并不能很好地生成高质量图像,2015年Radford等[4]提出了基于深度卷积层(Deep Convolutional)的GAN模型,即DCGAN。DCGAN提出了一套有效的网络架构和训练技巧,成功实现了当时最好的人脸图像生成,下图展示了DCGAN随机生成的人脸图像。

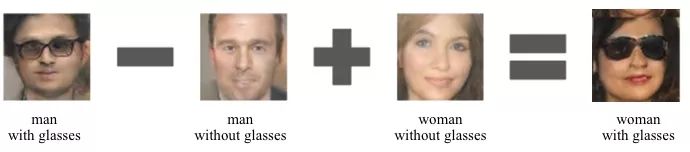

另外,基于潜在空间latent space上的算术运算,DCGAN还能进一步实现对人脸图像在语义层面的修改。如下图所示,将戴眼镜的男性图像减去不戴眼镜的男性图像,再加上不戴眼镜的女性图像,最终能生成戴眼镜的女性图像。这种高层语义层面上的操作在一定程度上实现了对人脸图像处理的智能化,也为GAN的进一步研究提供了多种可能。

3

VAE-WGAN

VAE-WGAN[5]将另一种生成模型变分自编码器(Variational AutoEncoder)与GAN相结合,生成了更高质量的人脸图像。另外,该工作还根据人脸属性的标签信息(比如是否是笑脸等)计算出不同人脸属性对应的隐向量(attribute-specific vector),再以此为基础实现了对目标人脸图像属性(如表情)的更改和调整,下面的动画展示了对不同人脸、不同属性的更改。我们可以看出,他们的方法能使人脸自动戴上眼镜(eyeglass)、变秃头(bald)、使头发变黑(black hair)甚至能实现由女性到男性(male)的自然过度。

4

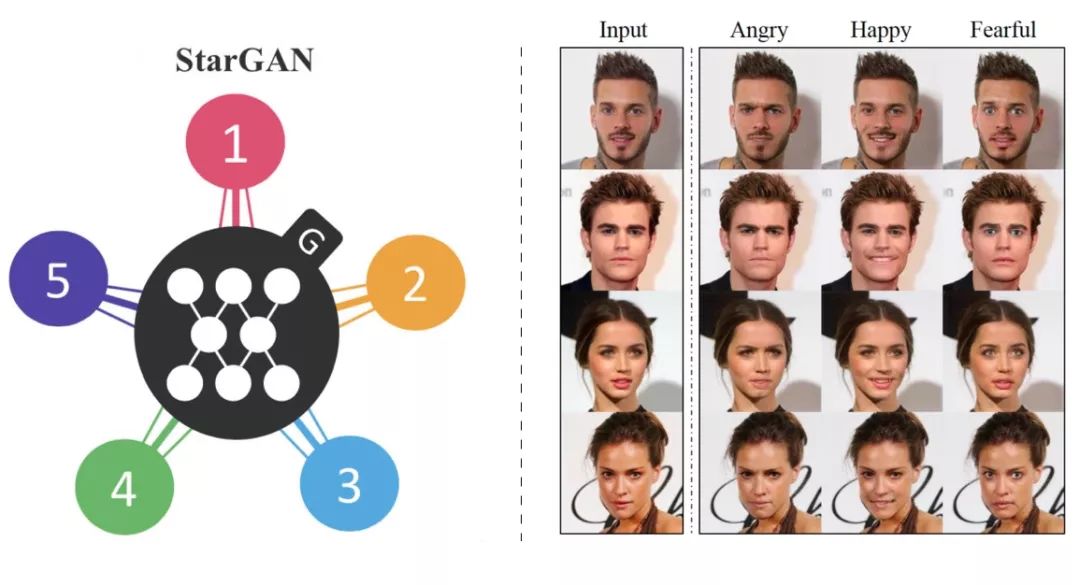

StarGAN

韩国研究者[6]成功地将多种图像域的转化有机地整合在一个模型里,称为StarGAN。StarGAN的最大的优势是同一模型能实现不同人脸图像属性的相互转换,下图展示了他们在人脸图像表情迁移上的结果。

5

ProgressiveGAN 和StyleGAN

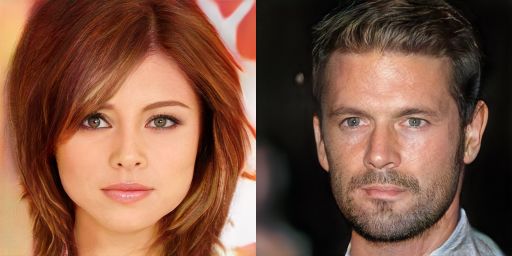

ProgressiveGAN[7]和StyleGAN[8]都是美国英伟达(NVIDIA)公司Karras等研究员于2018和2019年提出来的,是现今生成人脸质量最高的GAN模型。特别地,ProgressiveGAN提出了从小尺寸图像到大尺寸图像渐进训练的方式,成功生成了尺寸高达1024x1024的高清人脸图像,下图展示了生成的女性和男性人脸图像。

StyleGAN是在ProgressiveGAN训练方法基础上改进了GAN的生成器,将输入的随机向量作为图像的风格(style),借助可适应的归一化方法(Adaptive Instance normalization)搭建全新的生成器网络。StyleGAN能生成更高清、质量更高的人脸图像,并且能实现将不同人脸风格进行近乎完美的融合,下图展示StyleGAN在保留源图像(source)姓别、年龄和姿态等属性的条件下,使其具有目标图像(destination)的背景、发色和面色等风格。强烈推荐点击观看下面的完整视频,相信读者也会被其惊艳的效果而震撼。

6

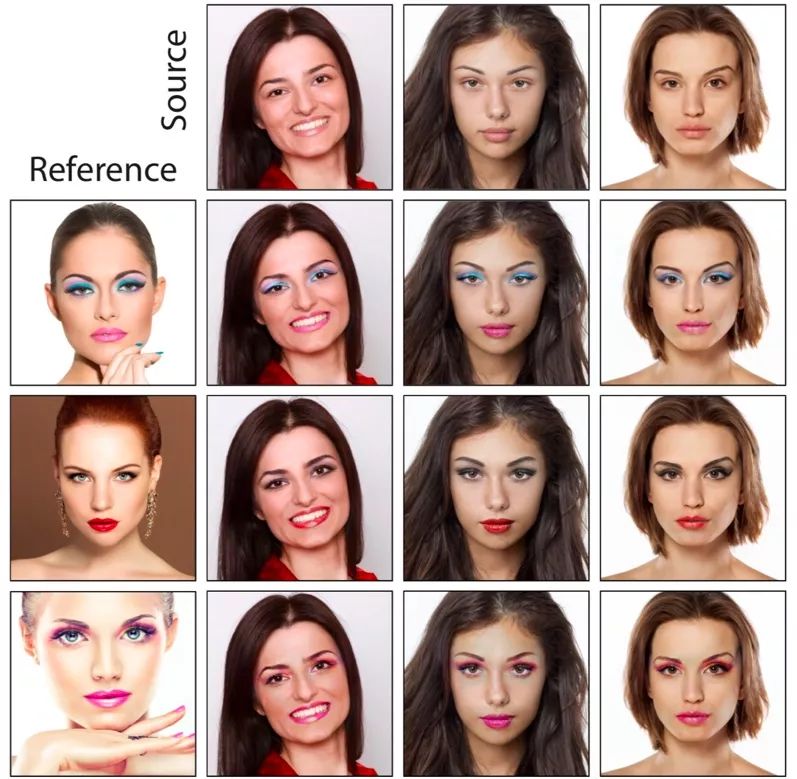

PairedCycleGAN

PairedCycleGAN[9]由美国普林斯顿大学和Adobe公司研究者提出来的,实现了自动的人脸化妆风格的精细转移,即将一个人脸图像的妆容(make up)迁移到另外一张人脸图像上。下图展示了PairedCycleGAN能精细地将同一人脸图像的妆容(reference)迁移到没有化妆的不同人脸图像(source)上,另外同一人脸也能快速地被加上不同的妆容,相信相关的手机应用程序(app)也会随之开发出来。

7

结语

随着生成对抗网络(GAN)模型的快速发展,随机生成的高清人脸图像已经达到了真假难分的程度。如何定义和使用这些“造”出来的人脸图像是在技术以及伦理上都需要关注的问题。另外,我们也可以看到基于GAN的智能图像编辑技术也已比较成熟,有着潜在的商业价值。最后,需要注意的是GAN的应用远不只限于图像生成上,已出现了不少与其他学科的交叉研究,比如利用GAN来发现新的药物,贤谈AI也会在以后的文章中作相应的介绍。

主要参考文献

[1] Goodfellow, I., et al. "Generative adversarial nets." Advances in neural information processing systems. 2014.

[2]https://blogs.nvidia.com/blog/2017/06/08/ai-podcast-an-argument-in-a-bar-led-to-the-generative-adversarial-networks-revolutionizing-deep-learning/

[3] Mustafa, et al. "CosmoGAN: creating high-fidelity weak lensing convergence maps using Generative Adversarial Networks." Computational Astrophysics and Cosmology 6.1 (2019): 1.

[4] Radford, A., Luke M., and Soumith C.. "Unsupervised representation learning with deep convolutional generative adversarial networks." arXiv preprint arXiv:1511.06434 (2015).

[5] Hou, X., et al. "Improving variational autoencoder with deep feature consistent and generative adversarial training." Neurocomputing 341 (2019): 183-194.

[6] Choi, Y., et al. "Stargan: Unified generative adversarial networks for multi-domain image-to-image translation." Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2018.

[7] Karras, T., et al. "Progressive growing of gans for improved quality, stability, and variation." arXiv preprint arXiv:1710.10196 (2017).

[8] Karras, T., Samuli L., and Timo A. "A style-based generator architecture for generative adversarial networks." Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2019.

文章在看点这里

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)