chatGLM3+chatchat实现本地知识库

背景由于客服存在大量的问题为FAQ问题,需要精准回复客户,所以针对此类精准问题,通过自建同量数量库进行回复。落地方案通过chatGLM3-6B+langchain-chatchat+bge-large-zh实现本地知识库库。注意:相关介绍和说明请看官网~配置要求名称要求说明内存16G最好是32GGPU英伟达16G最好是24Gpython3.10环境搭建拉取代码https://github....

背景

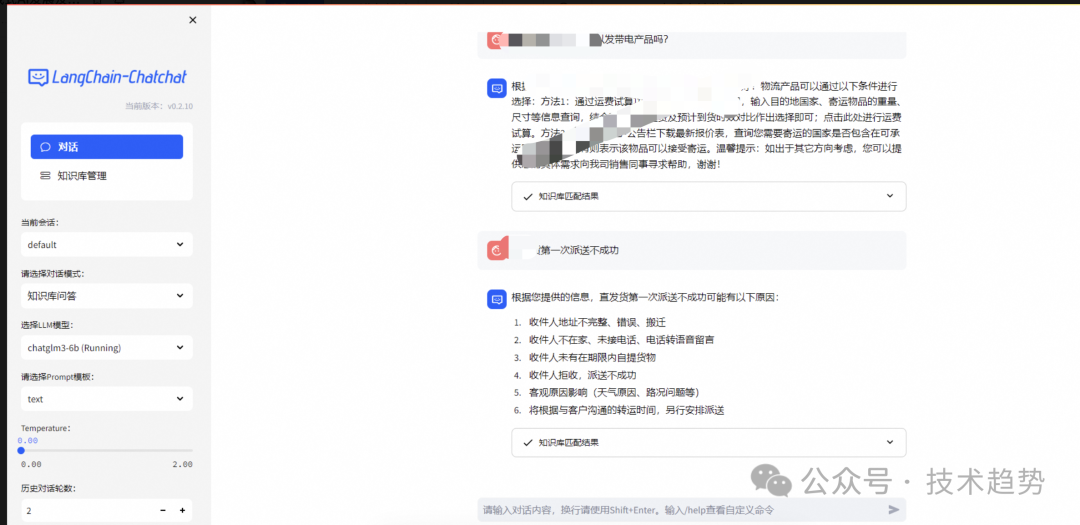

由于客服存在大量的问题为FAQ问题,需要精准回复客户,所以针对此类精准问题,通过自建同量数量库进行回复。

落地方案

通过chatGLM3-6B+langchain-chatchat+bge-large-zh实现本地知识库库。

注意:相关介绍和说明请看官网~

配置要求

|

名称 |

要求 |

说明 |

|

内存 |

16G |

最好是32G |

|

GPU |

英伟达16G |

最好是24G |

|

python |

3.10 |

环境搭建

拉取代码

https://github.com/chatchat-space/Langchain-Chatchat.git安装环境

建议:通过conda 创建专用环境

进入环境然后执行如下

pip install -r requirements.txt

pip install -r requirements_api.txt

pip install -r requirements_webui.txt下载模型

#国内源下载(推荐)git lfs installgit clone https://www.modelscope.cn/ZhipuAI/chatglm3-6b.git

git clone https://www.modelscope.cn/AI-ModelScope/bge-large-zh.git#需要梯子

git lfs installgit clone https://huggingface.co/THUDM/chatglm3-6b

git clone https://huggingface.co/BAAI/bge-large-zh项目部署

初始化配置

进入项目执行如下命令:

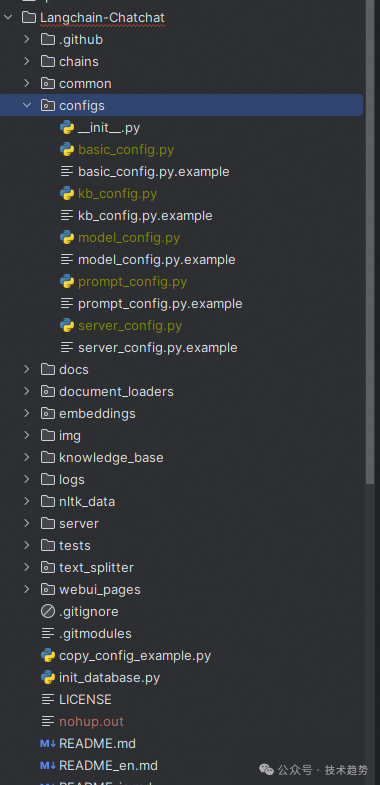

python copy_config_example.py

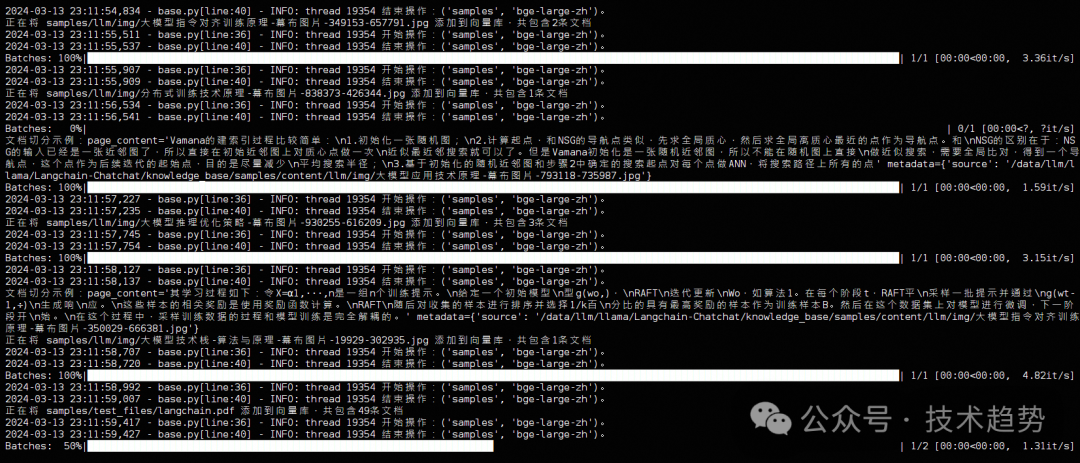

python init_database.py --recreate-vs

然后会在config中生成如下:

|

文件名称 |

说明 |

|

basic_config.py |

基础配置,用于配置日志相关 |

|

kb_config.py |

向量数据量配置,可配置相关的参数 |

|

model_config.py |

模型配置,可以在这里配置模型相关信息 |

|

prompt_config.py |

消息板模配置 |

|

server_config.py |

服务配置,配置端口及host等 |

配置修改

model_config.py 修改如下:

MODEL_ROOT_PATH =存放你模型的路劲(不需要指定到模型位置)

EMBEDDING_MODEL=向量数据库名称(不需要包含路劲)

server_config.py 修改如下:

OPEN_CROSS_DOMAIN = True

项目启动

#前台启动

python startup.py -a

#后台启动

nohup python startup.py>startup.log -a &

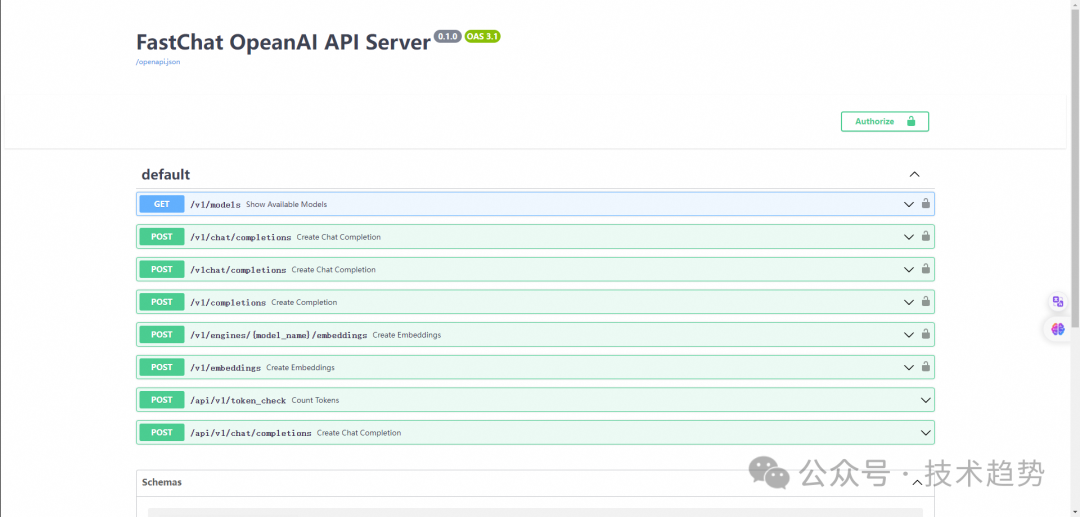

访问API接口列表:http://127.0.0.1:20000/docs#/

项止

访问页面:127.0.0.1:8501

最后

试了最新的chatchat发现这个版本在识别agent中的utils有时生效有时无效,官方也承认有这个问题,建议后续还是用官方的chatGLM3的utils,下次文章再输出。

相关链接:

https://github.com/THUDM/ChatGLM3

https://github.com/chatchat-space/Langchain-Chatchat

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)