记录一下使用lora微调codellama遇到的问题

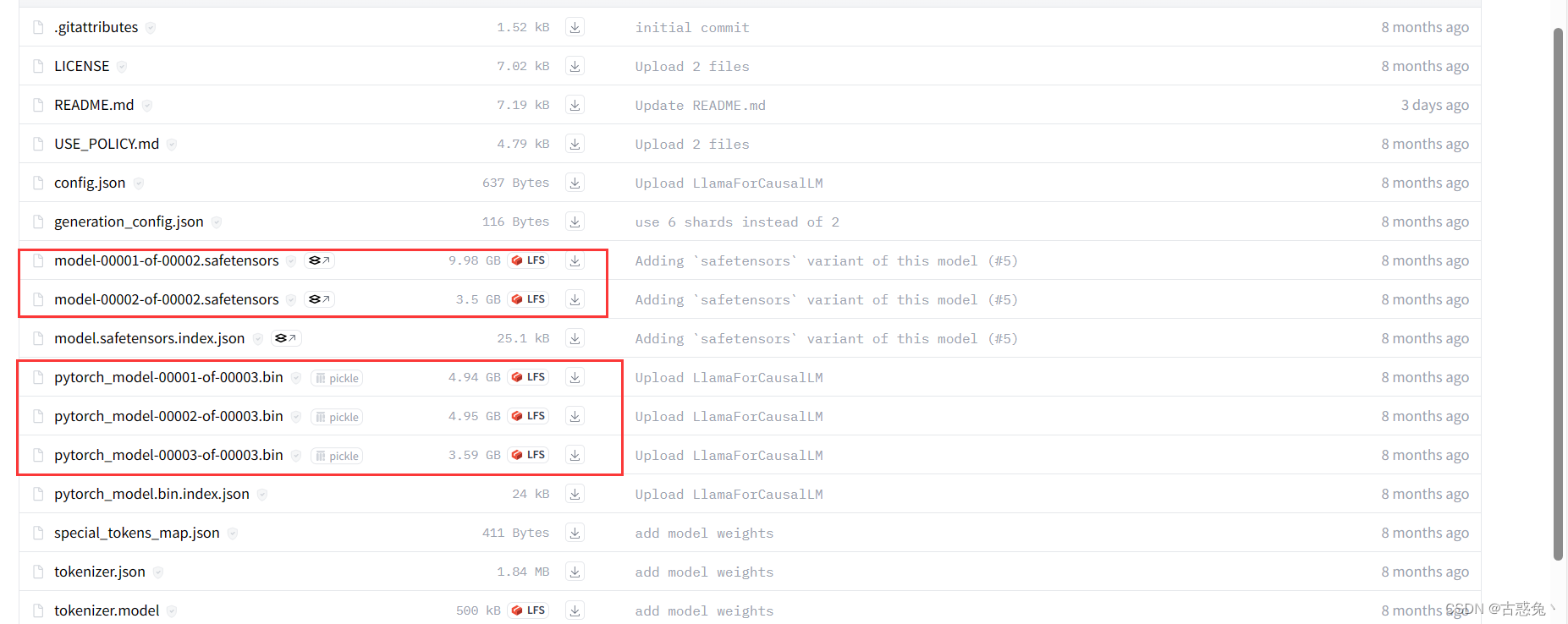

使用AutoModelForCausalLM加载模型会报错,改使用LlamaForCausalLM模型告知是因为模型参数没有下载完全导致的错误。在huggingface上下载模型文件的时候需要把红色框中内容全部下载。我使用的是safetensors。

·

### 问题1

RuntimeError: "normal_kernel_cpu" not implemented for 'Char'.

使用AutoModelForCausalLM加载模型会报错,改使用LlamaForCausalLM模型告知是因为模型参数没有下载完全导致的错误。在huggingface上下载模型文件的时候需要把红色框中内容全部下载。我使用的是safetensors

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)