小白也能轻松上手!Doris专属RAG知识库搭建指南(上)——MaxKB零代码落地

本文作为开篇,重点讲解**最简单、最易落地的MaxKB方案**,无需写一行代码,只需跟着步骤点击操作,就能快速拥有属于自己的Doris专属问答助手,彻底解放双手,高效检索Doris官方文档。

在Apache Doris生态日益壮大的今天,官方文档、最佳实践、技术手册已成为开发者、运维人员的核心学习资料。但面对海量文档,逐页翻阅、关键词搜索效率低下,基于RAG技术构建Doris专属智能问答知识库,能让你用自然语言快速获取精准答案,彻底告别“找文档难、查信息慢”的痛点。

搭建Doris RAG知识库,无需复杂技术储备,我们将采用「由浅入深、循序渐进」的流程,分上、中、下三篇逐步落地:

-

上篇(本文):零代码快速落地 —— 用MaxKB开源工具,轻松搞定Doris知识库,小白也能直接上手;

-

中篇:代码定制开发 —— 用LangChain搭建可深度定制的Doris知识库,适配复杂场景;

-

下篇:低代码企业级部署 —— 用Dify搭建支持团队协作、多模型对接的企业级Doris问答系统。

本文作为开篇,重点讲解最简单、最易落地的MaxKB方案,无需写一行代码,只需跟着步骤点击操作,就能快速拥有属于自己的Doris专属问答助手,彻底解放双手,高效检索Doris官方文档。

一、为什么首选MaxKB?(小白必看)

搭建Doris RAG知识库,核心需求是「支持Markdown/PDF等多种文档格式解析、中文语义检索精准、部署简单、可私有化」,而MaxKB恰好完美匹配所有需求,也是最适合小白的方案,核心优势如下:

-

零代码,开箱即用:无需编程基础,Docker一键部署,所有操作均为可视化点击;

-

文档适配性强:原生支持Markdown、PDF等多种格式,完美适配Doris官网文档,解析准确率高;

-

中文优化,检索精准:内置中文专用向量模型,无需额外配置,对Doris技术术语的检索、理解更精准;

-

支持私有化部署:开源免费,可部署在自己的服务器上,保障数据安全;

-

自带Web界面:无需额外开发,部署完成即有现成的问答界面,可直接使用或嵌入第三方平台。

对比其他方案(LangChain需代码、Dify需基础配置),MaxKB的门槛最低、落地最快,是小白入门Doris RAG知识库的首选,也是大多数开发者、运维人员快速落地的最优解。

二、前期准备(提前备好,避免踩坑)

搭建前只需准备3件事,无需复杂环境配置,新手也能轻松搞定:

- 服务器要求:最低2C4G,推荐4C8G(运行更流畅),系统支持CentOS 7+/Ubuntu 22.04+(本地电脑也可测试,需安装Docker);

- 必备工具:安装Docker和Docker Compose(本文提供一键部署命令,无需手动配置复杂环境);

- Doris文档:访问Doris官网(https://doris.apache.org/docs/4.x/gettingStarted/what-is-apache-doris),手动下载所需版本的文档;

三、MaxKB搭建Doris知识库(手把手)

步骤1:一键部署MaxKB

无论你是服务器还是本地电脑,只要安装了Docker,执行以下命令即可一键部署,数据会持久化保存,不用担心重启丢失。

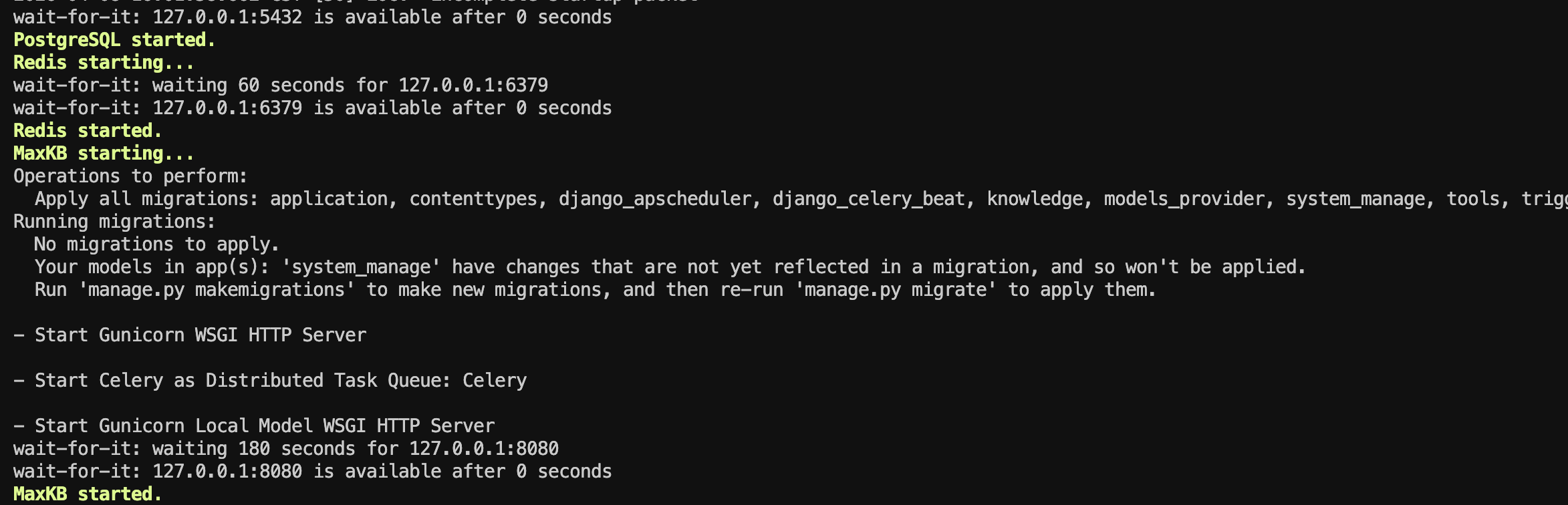

# 启动docker(需要提前装一下docker)

# macos直接启动程序就行,通过下面命令检查一下

docker ps

# 一键启动Docker容器

docker run -d --name=maxkb \

--restart=always \

-p 8080:8080 \

-v ~/.maxkb:/opt/maxkb \

1panel/maxkb

## 检查是否正常启动

docker logs -f maxkb

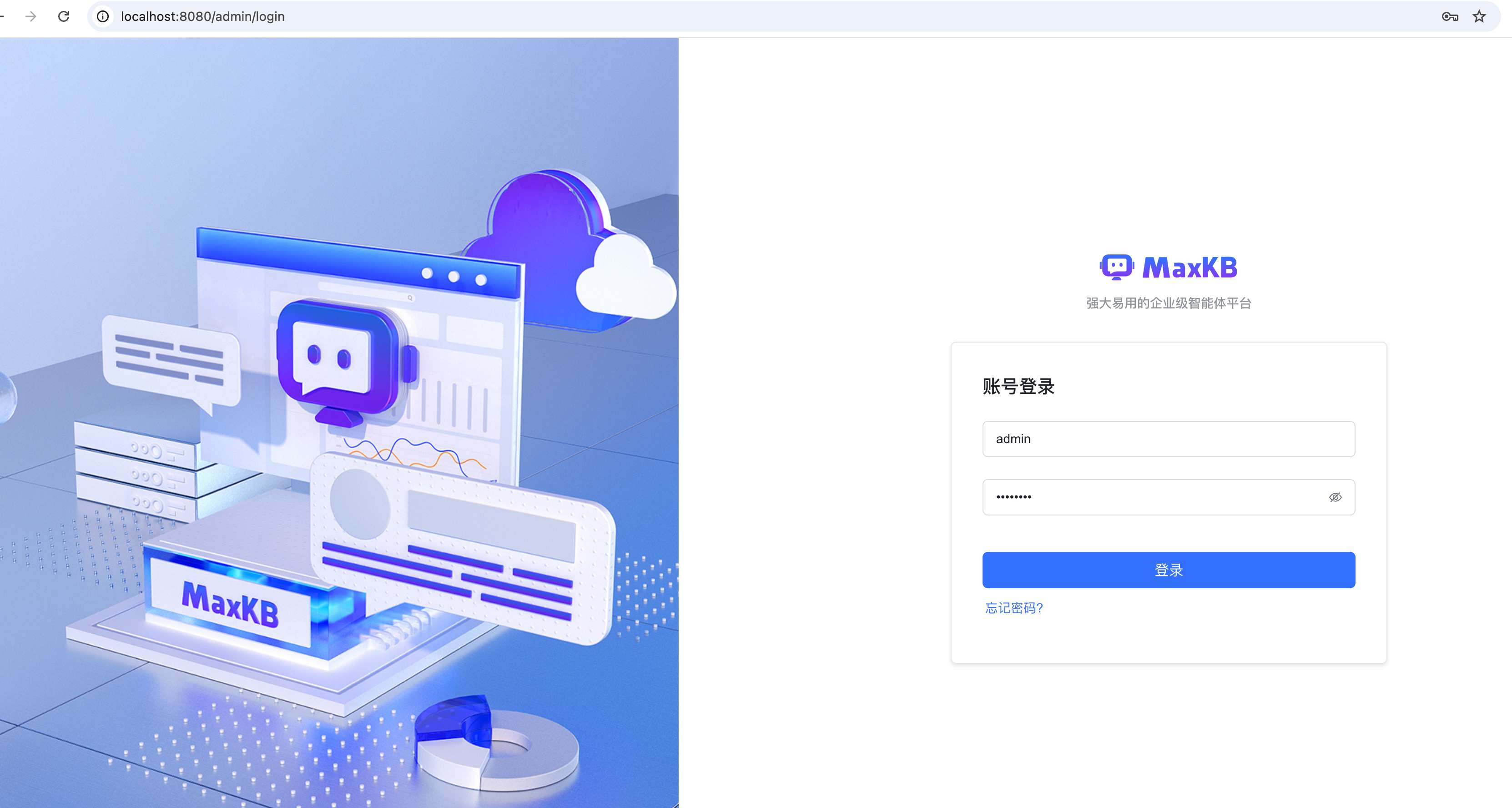

部署完成后,访问 http://服务器IP:8080,默认账号:admin,密码:MaxKB@123..(首次登录会提示修改,建议立即修改,不然后面疯狂提示修改)。

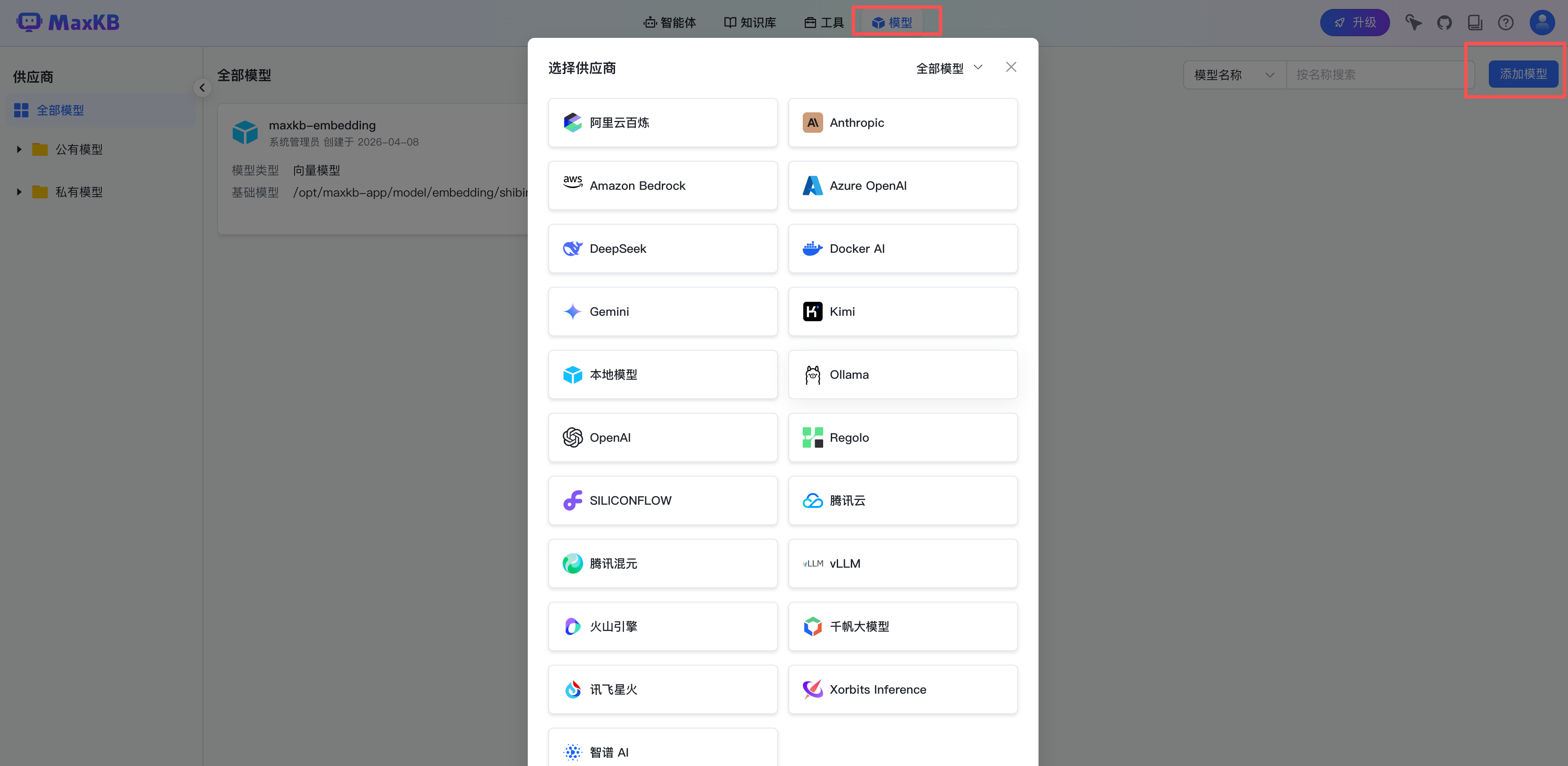

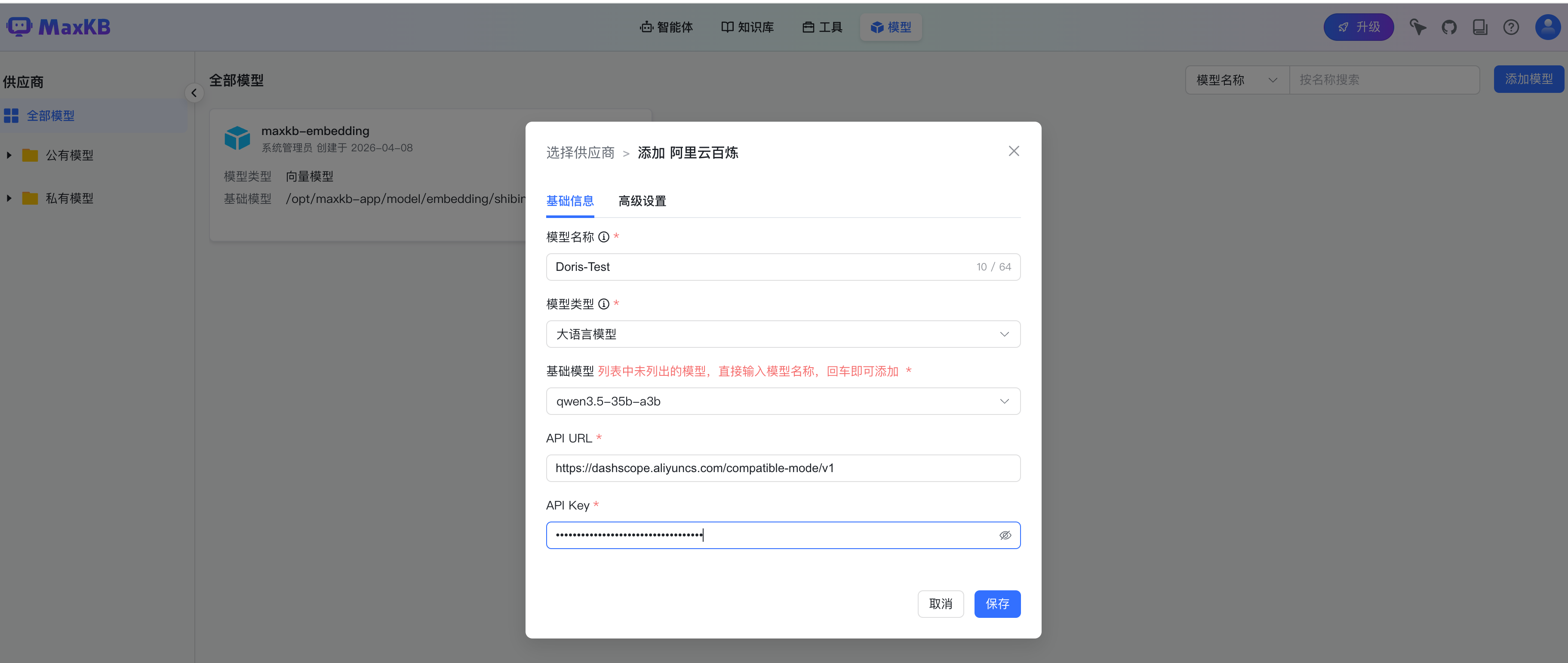

步骤2:配置大模型(支持云端/本地)

MaxKB支持云端大模型(通义千问、DeepSeek、OpenAI等)和本地模型(Ollama部署的Llama 3、Qwen等),新手推荐先使用云端模型(配置简单),步骤如下:

-

上方菜单进入「模型」→「添加模型」,选择「合适的模型」

-

填写配置:

- 模型名称:自定义(如「Doris-Test」)

- API Key:在你选择的模型官网获取

- 基础模型:选择合适的模型

- API地址:基于你选择的模型在官网获取base url

- 点击「保存」,显示成功后保存。

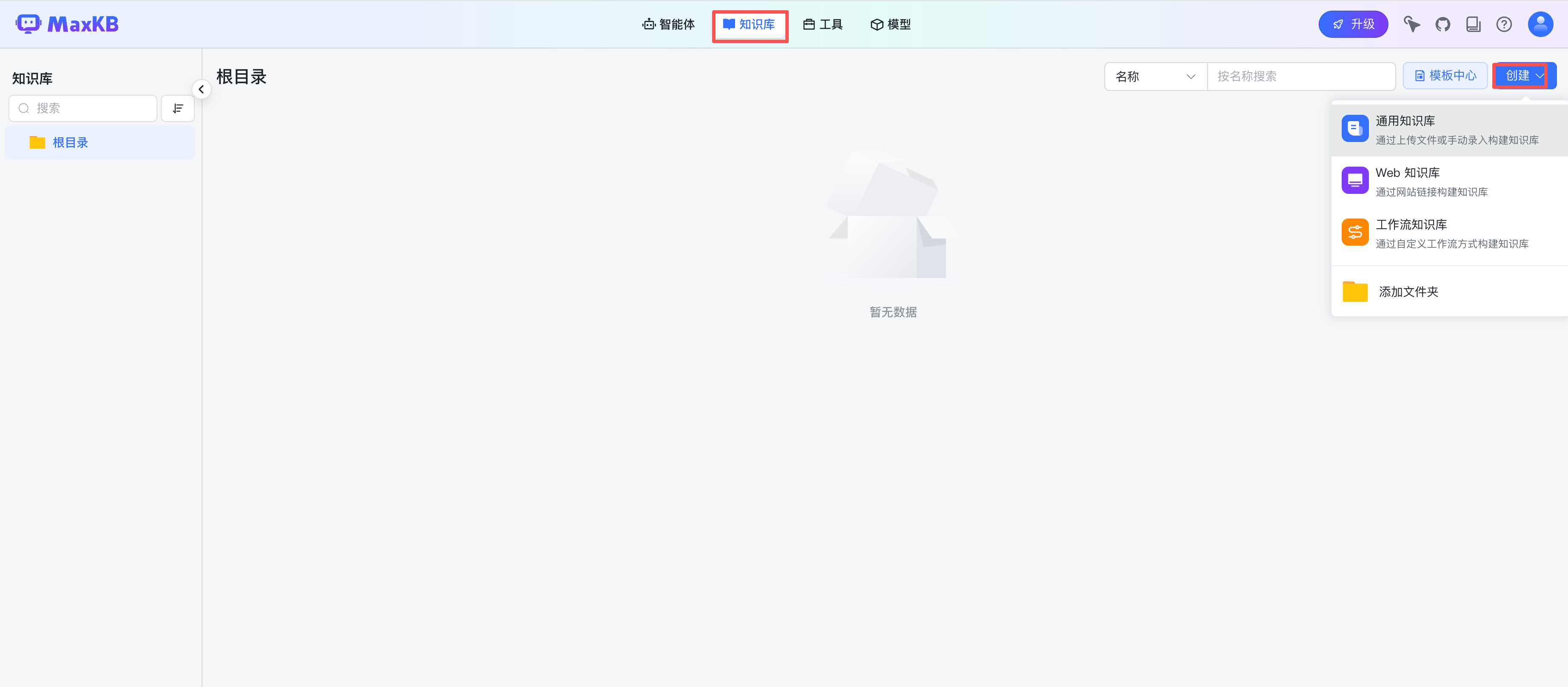

步骤3:创建Doris专属知识库

- 上方菜单进入「知识库」→「创建」

- 基础配置:

- 知识库名称:Apache Doris 官方文档知识库

- 知识库描述:包含Doris安装、部署、优化、SQL语法、生态工具等全部官方文档

- 向量模型:选择内置

MaxKB-Embedding(中文专用,无需额外配置,也可以使用其他的向量模型)

-

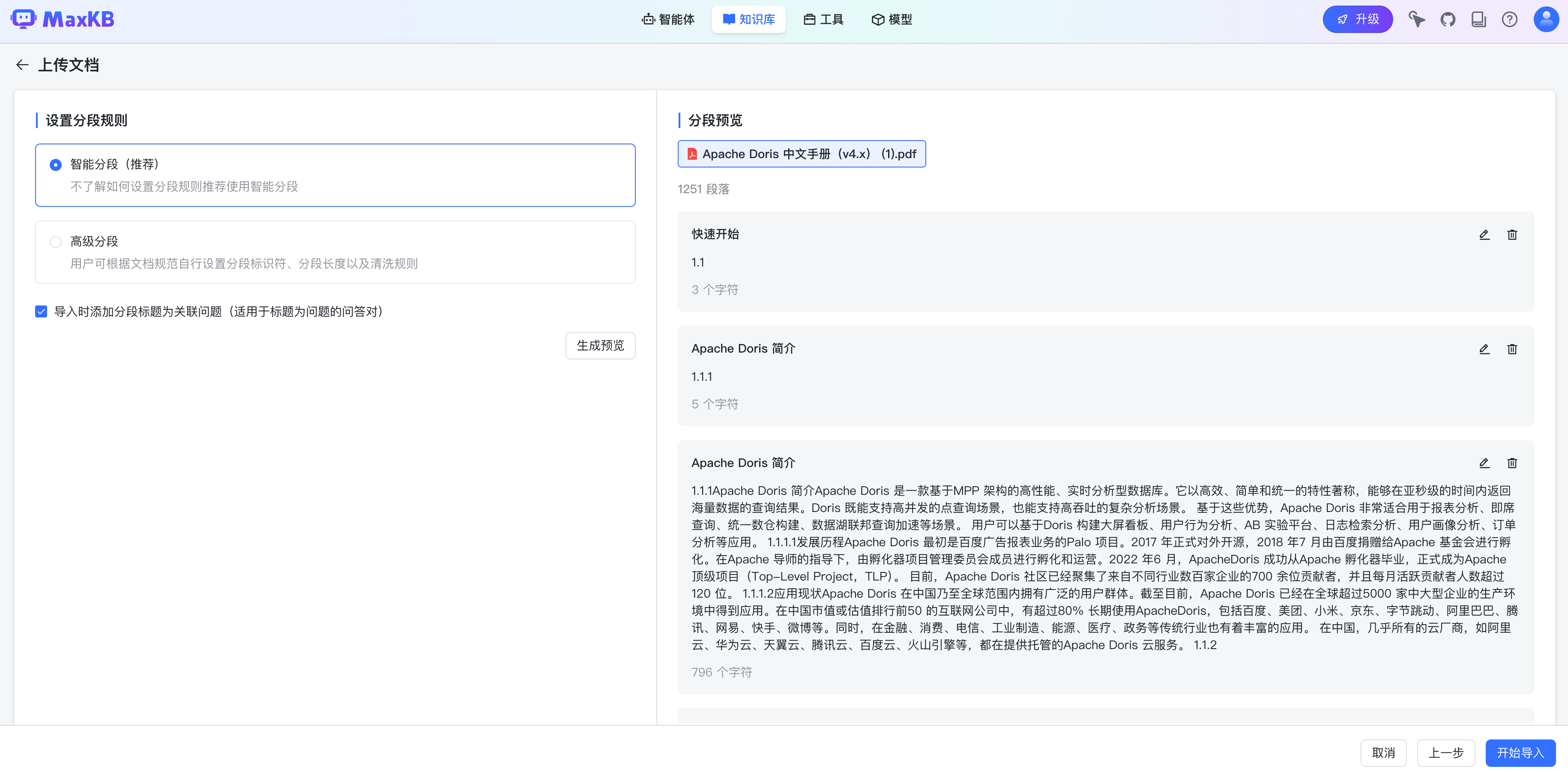

上传Doris文档:

- 点击「上传文档」,选择本地下载好的文档(支持批量上传,单次最多50个)

- 分段设置:选择「智能分段」(按文档标题自动拆分,适配Doris文档结构)

- 勾选「导入时添加分段标题为关联问题」,提升检索精准度

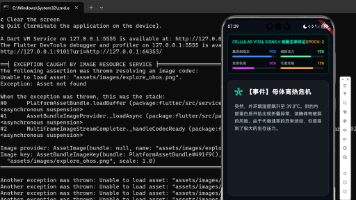

Doris的这个PDF的文档,解析有些问题会报错,他会持续的解析的。莫慌~

invalid input syntax for type json LINE 1: …n", “role”: “ADMIN”}‘::jsonb, 200, ‘172.17.0.1’, E’{“path”:… ^ DETAIL: Token “|” is invalid. CONTEXT: JSON data, line 1: …json_quote(“\0”) |±-----------------+| “\”|…

- 等待处理:系统自动完成文档解析、分段、向量化,状态显示「成功」即完成(文档比较长,他会花一段时间)。

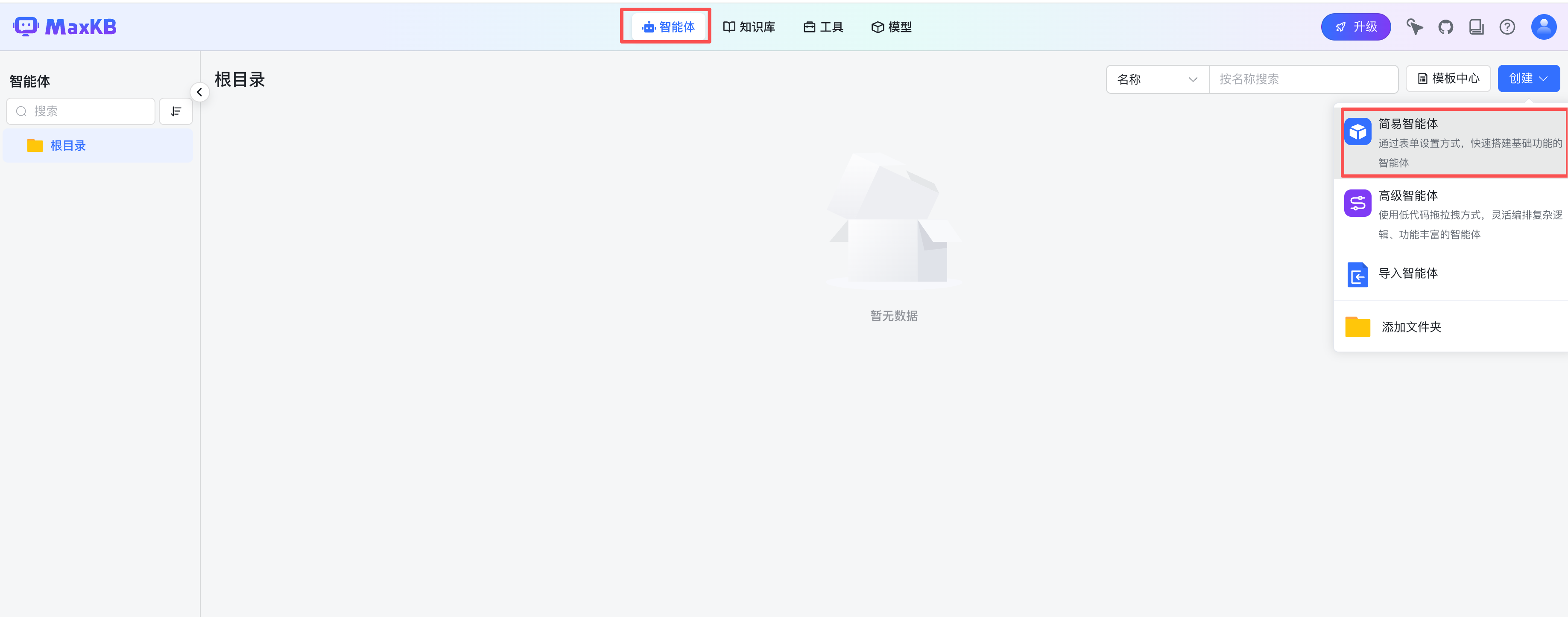

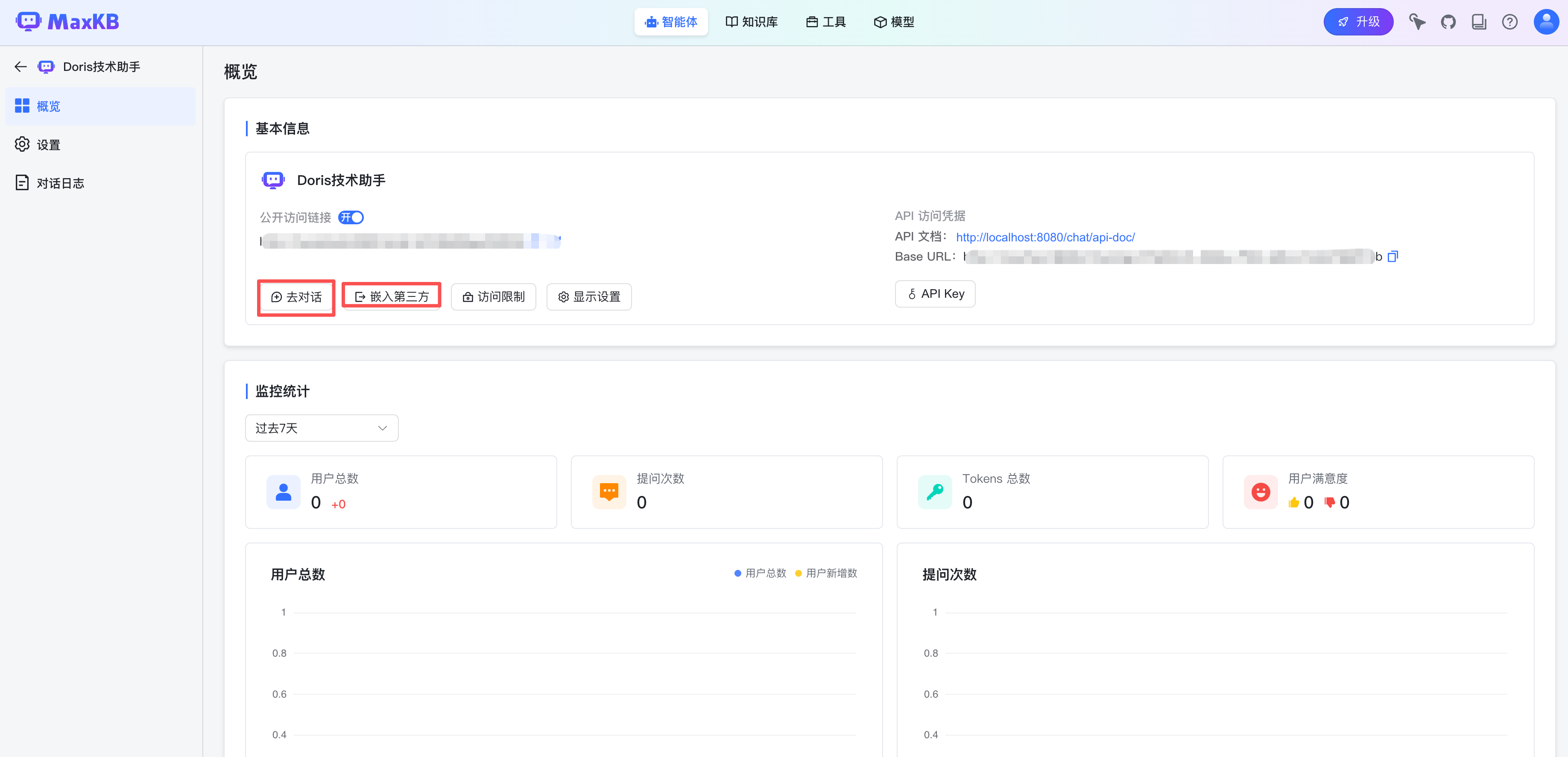

步骤4:创建Doris问答助手并测试

- 上方菜单进入「智能体」→「创建智能体」,选择「简易智能体」

-

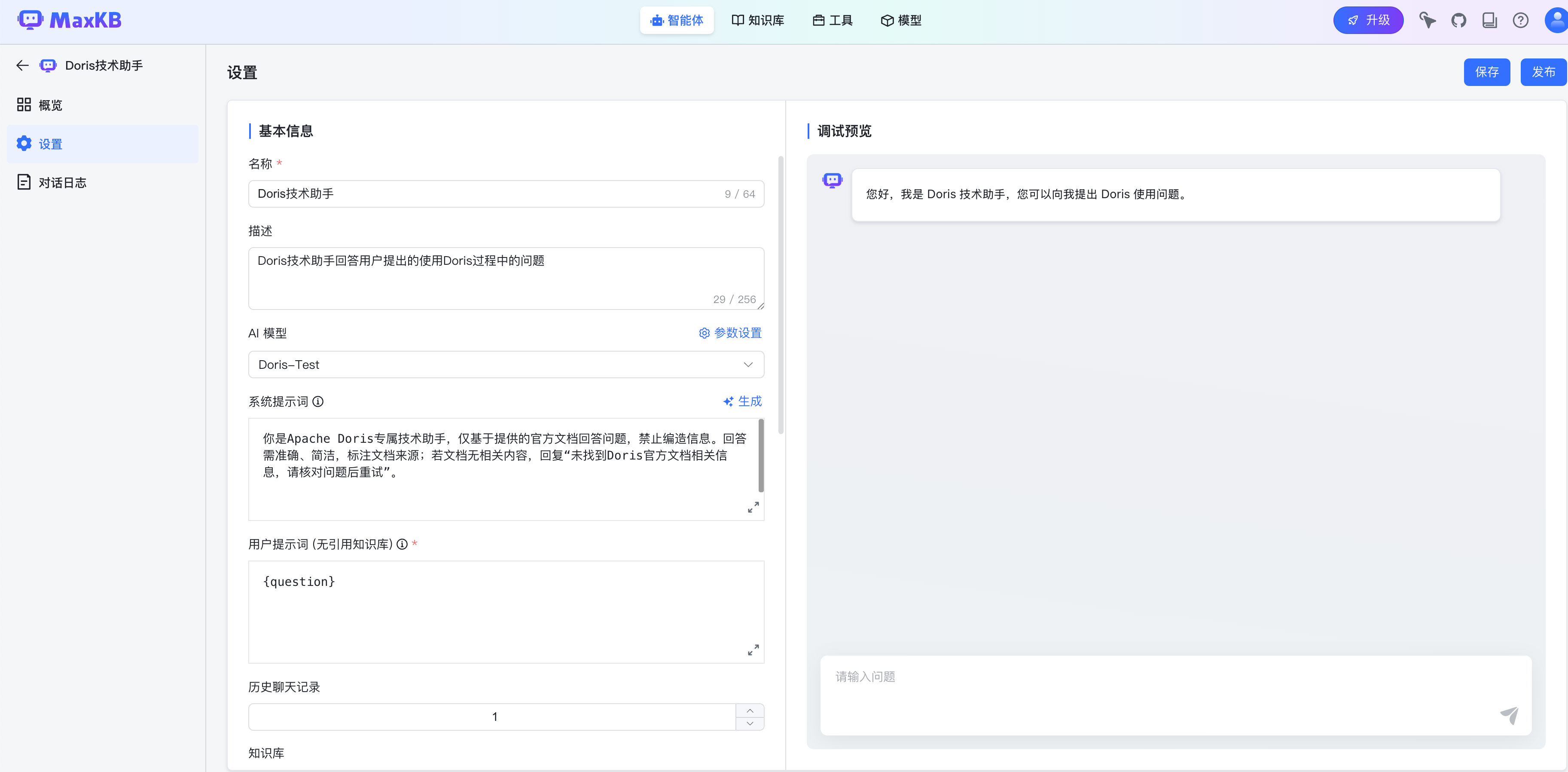

配置:

- 名称:Doris技术助手

- 绑定知识库:选择刚创建的「Apache Doris 官方文档知识库」

- 大模型:选择已配置的大模型

- 系统提示词(可选):

你是Apache Doris专属技术助手,仅基于提供的官方文档回答问题,禁止编造信息。回答需准确、简洁,标注文档来源;若文档无相关内容,回复“未找到Doris官方文档相关信息,请核对问题后重试”。

- 保存之后,然后点击发布即可

系统会精准检索文档并生成答案,同时附带文档来源,完全避免幻觉。

步骤5:发布使用(可选)

支持发布为Web页面、嵌入第三方,直接对外提供Doris知识库问答服务。

可以直接进行使用了,下面是一些测试案例

- 示例1:Doris 4.0版本有哪些新特性?

- 示例2:如何部署Doris存算分离集群?

- 示例3:Doris的Bitmap索引适用场景是什么?

四、总结

无需代码、无需复杂技术,用MaxKB就能轻松搭建属于自己的Doris专属RAG知识库,让AI帮你快速检索官方文档,告别逐页查找的烦恼。

无论是新手入门Doris,还是运维、开发者日常查询文档,这个知识库都能大幅提升效率,让你把更多时间放在核心工作上。

赶紧跟着本文步骤操作,搭建你的第一个Doris智能问答助手吧! 下篇我们将解锁更灵活的代码方案,敬请期待~

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)