5分钟玩转基于ModelEngine Nexent的智能体全流程工程最佳实践 - 智能AI客服

摘要: ModelEngine Nexent是一款开源AI Agent平台,致力于降低智能体开发门槛,推动AI技术从模型研究向生产落地转化。该平台通过零代码方式实现智能体自动生成,支持多模态对话、知识库检索等复杂功能,解决了传统开发中流程碎片化、门槛高、生产落地难等问题。平台提供轻量快速部署和完整功能版两种选择,支持Docker快速部署,最低配置要求为2核CPU和6GB内存。部署过程包含版本选择、

随着人工智能的不断发展,大语言模型技术日益成熟。AI应用已经从最初专注于语音识别等简单任务的应用,演进到能够进行自主推理决策,完成复杂任务的Agent。基于大语言模型的AI Agent,具备自主性、目标导向性和交互性,能够在复杂多变的环境中感知信息、推理决策并执行任务。在各个行业场景中,AI Agent都展示出巨大的应用潜力,广泛应用于客户支持、销售拓展、医疗诊断和金融分析等场景。

ModelEngine Nexent作为开源Agent平台,致力于提供灵活、强大且易用的AI Agent开发与运行能力。基于该平台,开发者可快速构建处理各类简单或复杂任务的AI Agent,实现多Agent协同交互,高效开发生产级可靠AI Agent;并助力企业与个人快速搭建AI Agent系统或平台,推动商用级Agentic AI技术广泛应用与落地。

一、前言:

一般我们在生成式AI智能体开发时,大多数只是提供了一个框架,各种集成第三方工具,很少会出现大模型从 Demo 阶段快速走向生产落地,在AI技术从模型研究迈向大规模应用落地的过程中,真正的难点已经不在“有没有一个强模型”,而在“能不能高效、稳定地把模型变成业务能力”。

-

①. 开发流程碎片化:AI应用开发涉及数据处理、模型微调、应用部署等多个环节,传统工具链分散,缺乏统一平台,导致工程成本高、迭代慢。

-

②. 智能体开发门槛高:构建复杂智能体需要协调提示词设计、知识库管理、工具集成等多方面能力,手动实现易出现逻辑混乱、调试困难等问题。

-

③. 从原型到生产的鸿沟:许多AI项目在演示阶段表现良好,但难以满足生产环境对稳定性、可观测性和可维护性的要求,缺乏标准化的工程实践。

二、ModelEngine Nexent平台简介:

ModelEngine Nexent 是 ModelEngine 社区旗下的核心智能体平台,它是一个零代码智能体自动生成平台,旨在通过纯语言描述自动生成功能完备的智能体。用户无需进行复杂的流程编排或拖拽式设计,即可快速构建具备多模态对话、知识库检索、网络搜索等能力的AI应用。

依托 MCP 开放生态,ModelEngine Nexent 实现了丰富的工具集成,能够精准匹配工作协同、旅行规划、日常服务等不同场景的智能需求。同时,平台还内置强大的核心能力矩阵,涵盖智能体运行控制、多智能体协作、数据处理与知识溯源、多模态交互及批量扩展等功能,真正做到“一个提示词,解锁智能体的无限可能”。

三、ModelEngine Nexent 的安装与部署:

ModelEngine Nexent 提供本地安装部署的,根据官方提供的源码进行 Docker 部署方案,三步命令就能快速完成部署并运行,接下来我们来看看如何使用 Docker 部署 Nexent,部署Nexent前,请确保你的系统满足以下最低配置:

- CPU:2核

- 内存:6GB

- 架构:x86_64 / ARM64

- 软件:已安装Docker和Docker Compose

在安装之前需要自行准备好docker以及docker-compose环境,这里不做赘述。这里我们选择的是1.8.0版本,如果你想要使用最新版本,可以切换到master分支。

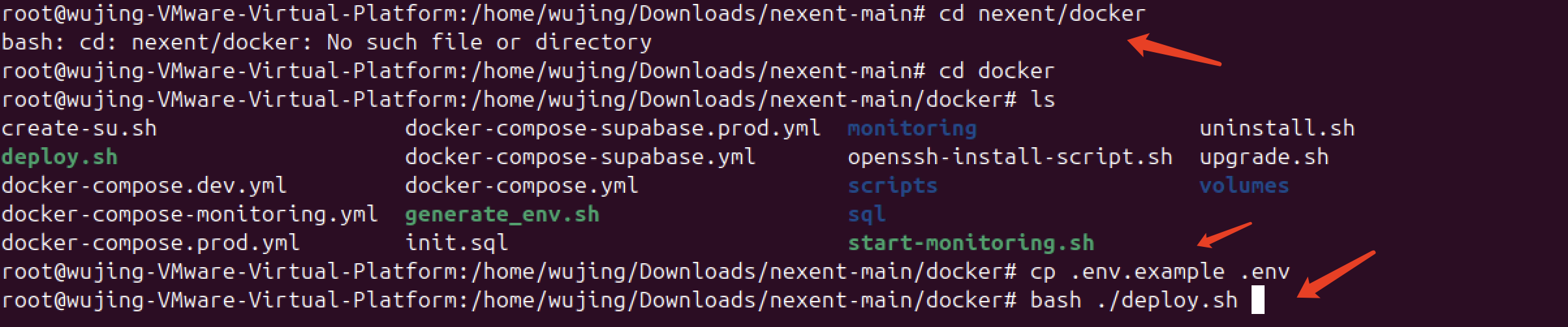

git clone https://github.com/ModelEngine-Group/nexent/tree/release/v1.8.0

cd nexent/docker

cp .env.example .env # 复制环境变量配置文件(一定要复制一下,不然会报错)

运行以下命令开始部署:

bash deploy.sh

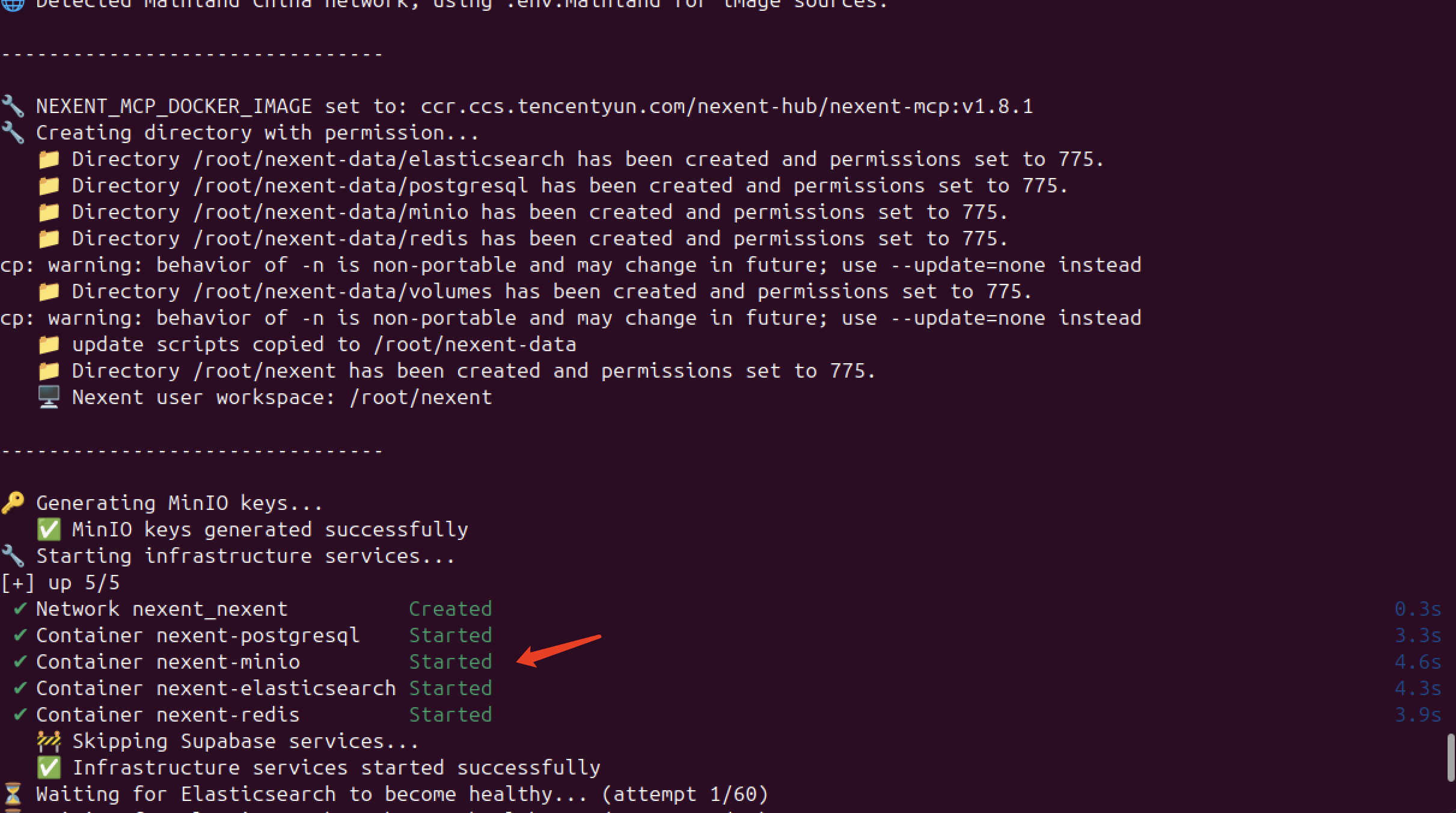

接下来,就开始进行部署的过程了,先会进行系统的端口检查,接着下载相关镜像,最后启动容器。

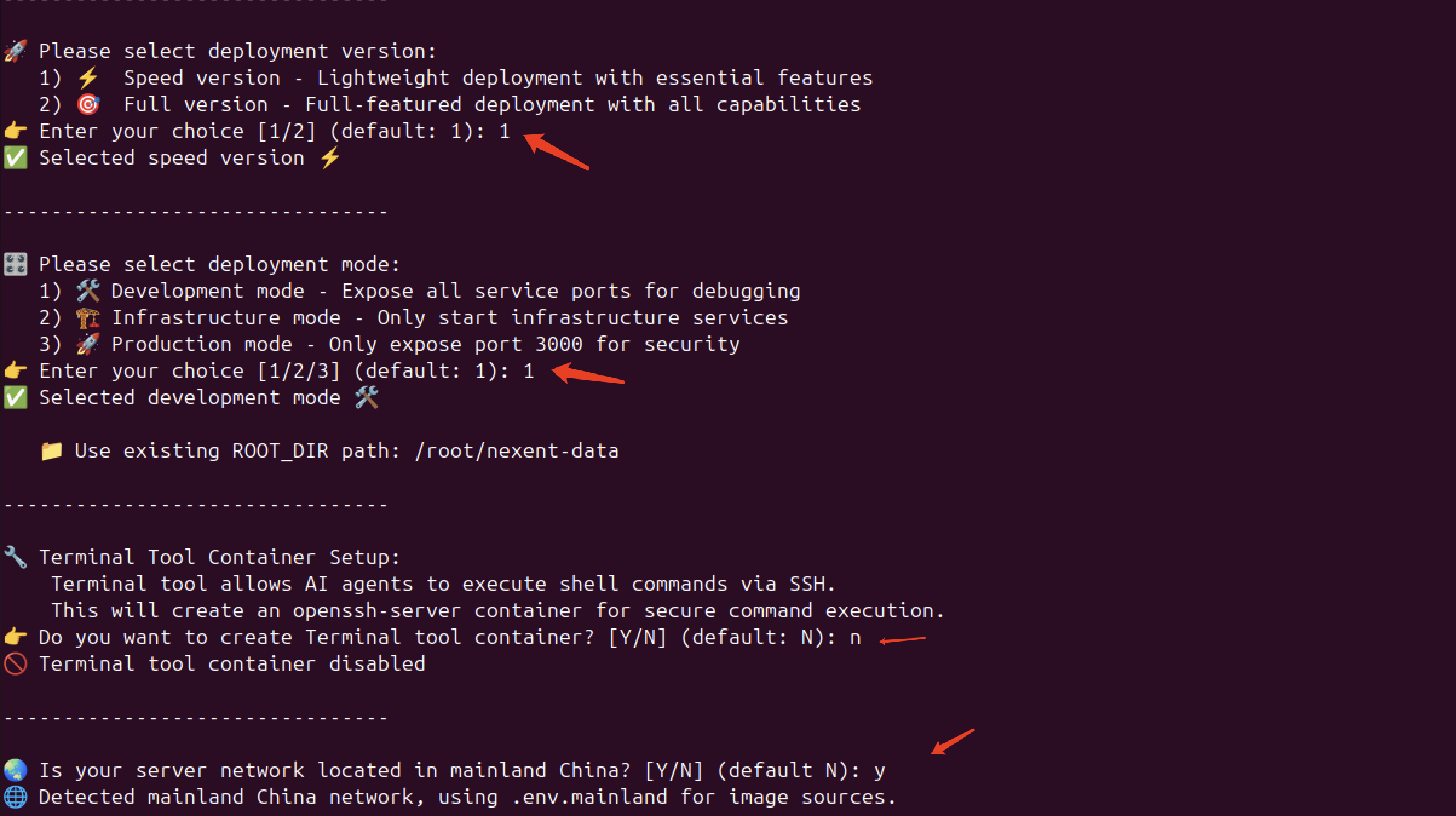

第一步【版本选择】:输入1,系统会提供两个不同的版本供您选择:

- Speed version(轻量快速部署,默认): 快速启动核心功能,适合个人用户和小团队使用

- Full version(完整功能版): 提供企业级租户管理和资源隔离等高级功能,但安装时间略长,适合企业用户

Please select deployment version:

1) Speed version - Lightweight deployment with essential features

2) Full version - Full-featured deployment with all capabilities

这里我们选择1,使用轻量快速部署的方式。

第二步【部署模式】: 选择1,进行开发模式部署,暴露所有服务端口以便调试。

- 开发模式 (默认): 暴露所有服务端口以便调试

- 基础设施模式: 仅启动基础设施服务

- 生产模式: 为安全起见仅暴露端口 3000

第三步【可选组件】:我这里终端工具输入N,但是区域优化选择了Y。

- 终端工具: 启用 openssh-server 供 AI 智能体执行 shell 命令

- 区域优化: 中国大陆用户可使用优化的镜像源

接下来,会下载一些镜像,这里需要看一下网速是否正常,如果网速过慢,请耐心等待,如果网速正常,我这里是大概10分钟左右就完成了。接下来就是启动容器了,最后所有容器都启动完成后,就是在浏览器中打开 http://localhost:3000

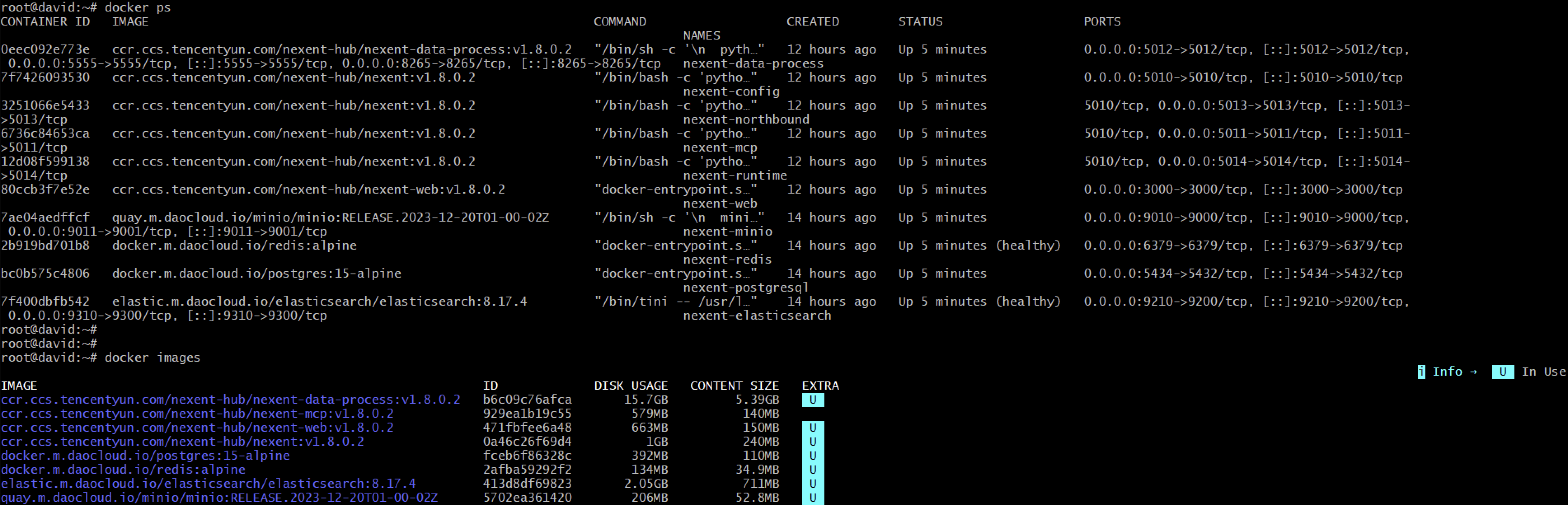

接下来使用docker images查看一下所有下载的镜像:

root@david:~# docker images

IMAGE ID DISK USAGE CONTENT SIZE EXTRA

ccr.ccs.tencentyun.com/nexent-hub/nexent-data-process:v1.8.0.2 b6c09c76afca 15.7GB 5.39GB U

ccr.ccs.tencentyun.com/nexent-hub/nexent-mcp:v1.8.0.2 929ea1b19c55 579MB 140MB

ccr.ccs.tencentyun.com/nexent-hub/nexent-web:v1.8.0.2 471fbfee6a48 663MB 150MB U

ccr.ccs.tencentyun.com/nexent-hub/nexent:v1.8.0.2 0a46c26f69d4 1GB 240MB U

docker.m.daocloud.io/postgres:15-alpine fceb6f86328c 392MB 110MB U

docker.m.daocloud.io/redis:alpine 2afba59292f2 134MB 34.9MB U

elastic.m.daocloud.io/elasticsearch/elasticsearch:8.17.4 413d8df69823 2.05GB 711MB U

quay.m.daocloud.io/minio/minio:RELEASE.2023-12-20T01-00-02Z 5702ea361420 206MB 52.8MB U

再使用docker ps查看一下所有正在运行的容器:

root@david:~# docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

0eec092e773e ccr.ccs.tencentyun.com/nexent-hub/nexent-data-process:v1.8.0.2 "/bin/sh -c '\n pyth…" 12 hours ago Up 5 minutes 0.0.0.0:5012->5012/tcp, [::]:5012->5012/tcp, 0.0.0.0:5555->5555/tcp, [::]:5555->5555/tcp, 0.0.0.0:8265->8265/tcp, [::]:8265->8265/tcp nexent-data-process

7f7426093530 ccr.ccs.tencentyun.com/nexent-hub/nexent:v1.8.0.2 "/bin/bash -c 'pytho…" 12 hours ago Up 5 minutes 0.0.0.0:5010->5010/tcp, [::]:5010->5010/tcp nexent-config

3251066e5433 ccr.ccs.tencentyun.com/nexent-hub/nexent:v1.8.0.2 "/bin/bash -c 'pytho…" 12 hours ago Up 5 minutes 5010/tcp, 0.0.0.0:5013->5013/tcp, [::]:5013->5013/tcp nexent-northbound

6736c84653ca ccr.ccs.tencentyun.com/nexent-hub/nexent:v1.8.0.2 "/bin/bash -c 'pytho…" 12 hours ago Up 5 minutes 5010/tcp, 0.0.0.0:5011->5011/tcp, [::]:5011->5011/tcp nexent-mcp

12d08f599138 ccr.ccs.tencentyun.com/nexent-hub/nexent:v1.8.0.2 "/bin/bash -c 'pytho…" 12 hours ago Up 5 minutes 5010/tcp, 0.0.0.0:5014->5014/tcp, [::]:5014->5014/tcp nexent-runtime

80ccb3f7e52e ccr.ccs.tencentyun.com/nexent-hub/nexent-web:v1.8.0.2 "docker-entrypoint.s…" 12 hours ago Up 5 minutes 0.0.0.0:3000->3000/tcp, [::]:3000->3000/tcp nexent-web

7ae04aedffcf quay.m.daocloud.io/minio/minio:RELEASE.2023-12-20T01-00-02Z "/bin/sh -c '\n mini…" 14 hours ago Up 5 minutes 0.0.0.0:9010->9000/tcp, [::]:9010->9000/tcp, 0.0.0.0:9011->9001/tcp, [::]:9011->9001/tcp nexent-minio

2b919bd701b8 docker.m.daocloud.io/redis:alpine "docker-entrypoint.s…" 14 hours ago Up 5 minutes (healthy) 0.0.0.0:6379->6379/tcp, [::]:6379->6379/tcp nexent-redis

bc0b575c4806 docker.m.daocloud.io/postgres:15-alpine "docker-entrypoint.s…" 14 hours ago Up 5 minutes 0.0.0.0:5434->5432/tcp, [::]:5434->5432/tcp nexent-postgresql

7f400dbfb542 elastic.m.daocloud.io/elasticsearch/elasticsearch:8.17.4 "/bin/tini -- /usr/l…" 14 hours ago Up 5 minutes (healthy) 0.0.0.0:9210->9200/tcp, [::]:9210->9200/tcp, 0.0.0.0:9310->9300/tcp, [::]:9310->9300/tcp nexent-elasticsearch

四、ModelEngine Nexent 的最佳实践:

在体验智能体的效果前,需要提前配置一下大模型,在华为 ModelEngine Nexent 中可以接入各类AI模型,包括大语言模型、向量化模型和视觉语言模型。Nexent支持多种模型提供商,帮助我们根据实际需求灵活选择最适合的模型,包括批量添加模型、单个模型配置等方式,支持10+模型供应商,包括OpenAI、DeepSeek、Qwen等。

4.1 大模型配置:

配置Embedding模型:

Embedding模型是一种将高维、离散或非结构化数据(如文本、图像、语音)映射到低维连续向量空间的技术,这些向量能捕捉原始数据的语义或特征信息,使得相似的对象在向量空间中距离更近。

点击ModelArts Studio 大模型即服务平台,集模型体验、精调、部署、管理、应用开发于一体,降低企业使用大模型的开发门槛,加速AI应用落地。

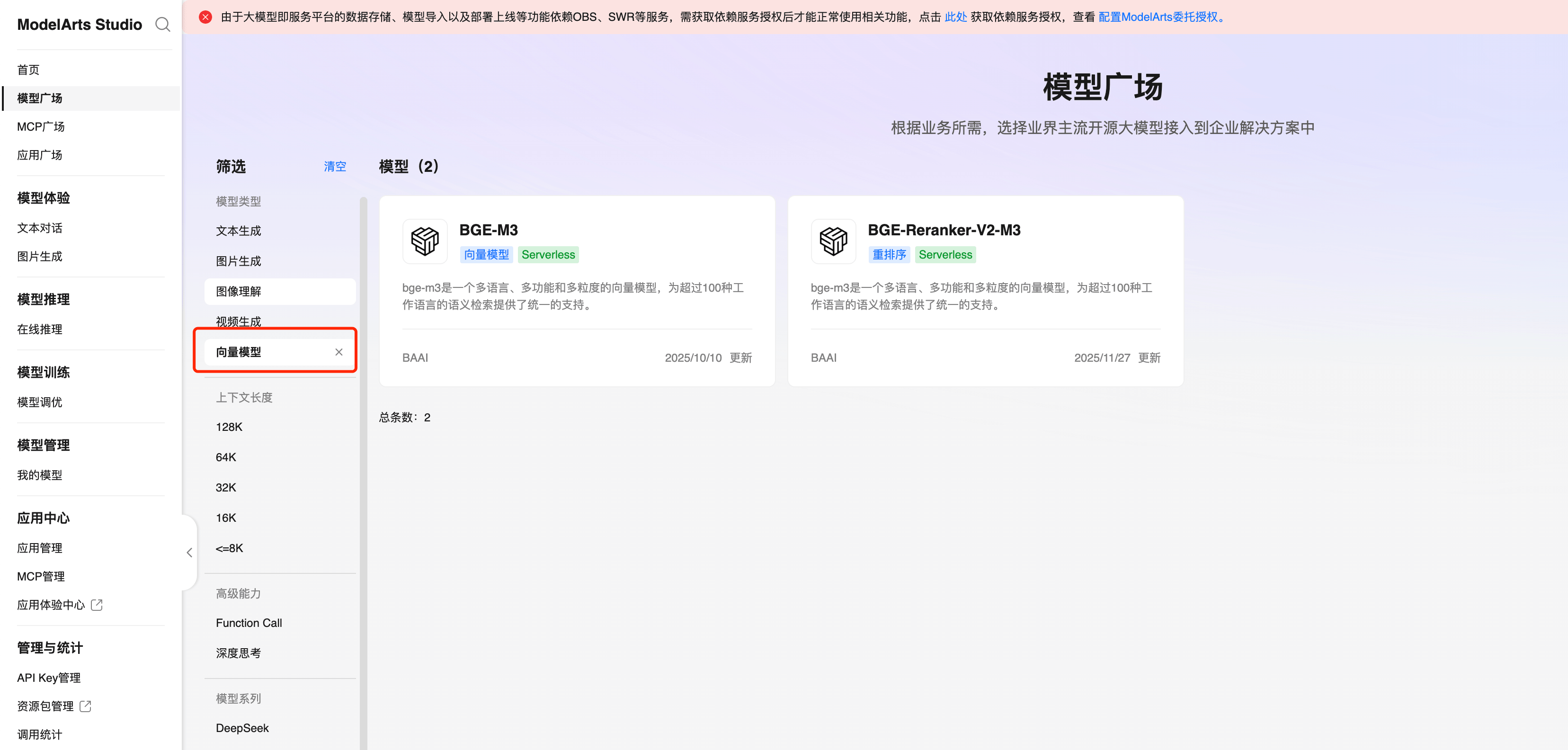

这里我们需要选择“模型管理”,里面模型类型我们选择“向量模型”,这里有2种模型,我们可以随便使用哪一种都可以,这里我们使用“BGE-M3模型”。

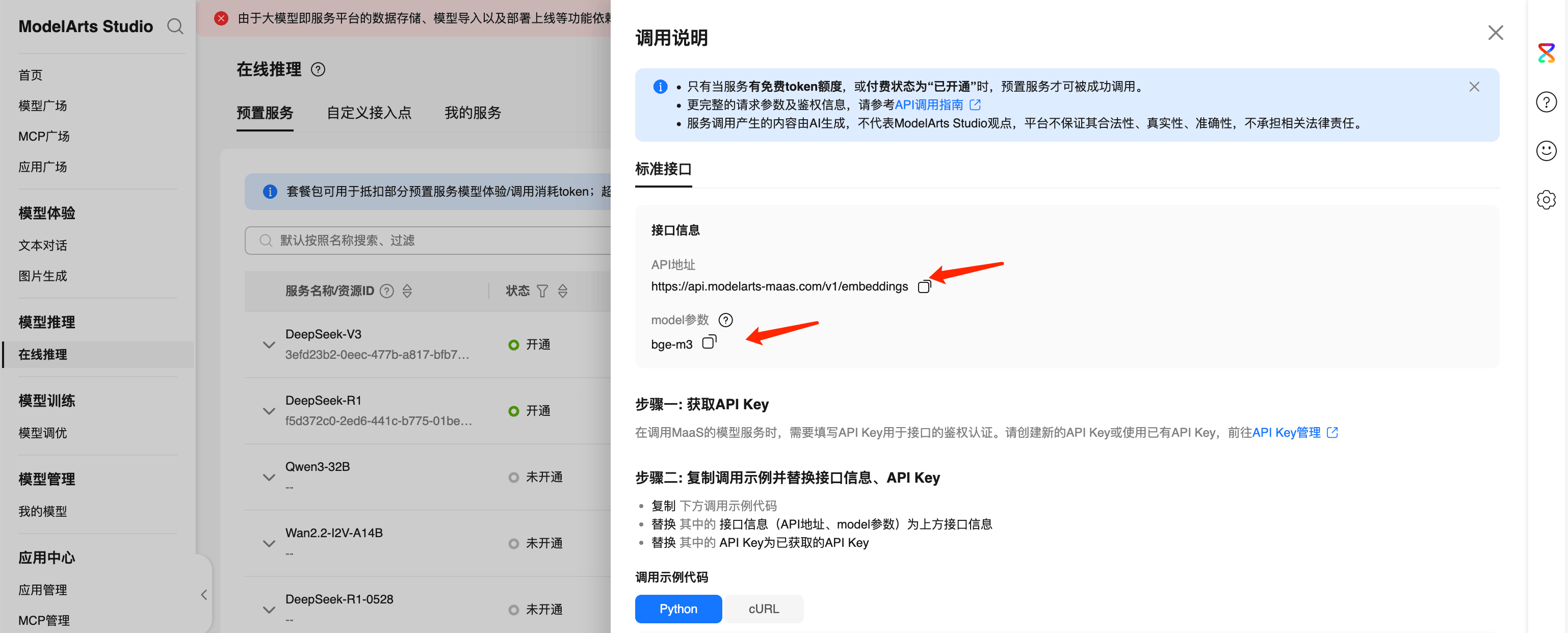

最后可以在模型基础信息页面中,配置相关的参数:

- 模型名称:bge-m3

- 模型标识符:bge-m3

- 基础服务地址:https://api.modelarts-maas.com/v1/embeddings

配置LLM模型:

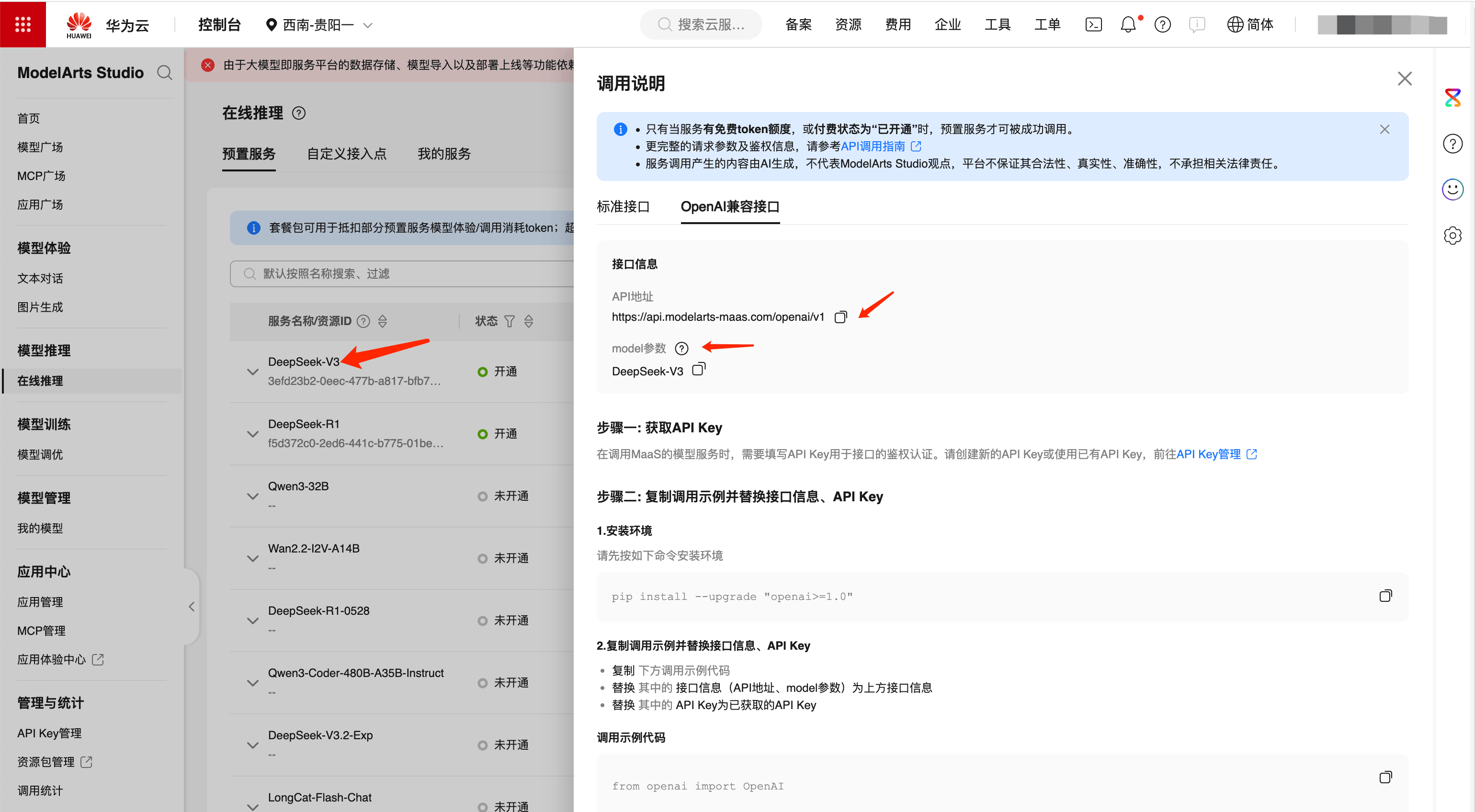

还是继续在ModelArts Studio 大模型即服务平台中,选择模型类型为LLM模型,这里我们选择“DeepSeek-V3模型”。

接下来,我们在模型管理中,添加LLM模型,这里我们添加“DeepSeek-V3模型”。

- 模型名称:系统显示名称,用户可自定义。

- 模型ID:由模型服务提供商定义的调用名称,可在各提供商的官方网站查询。(对应从华为云获取的model参数)

- API 密钥:模型的API Key(对应从华为云获取的API Key)

- 基础服务地址:由模型服务提供商定义的API地址,可在各提供商的官方网站查询。(对应从华为云获取的API地址)

- 描述:模型的详细描述,用户可自定义

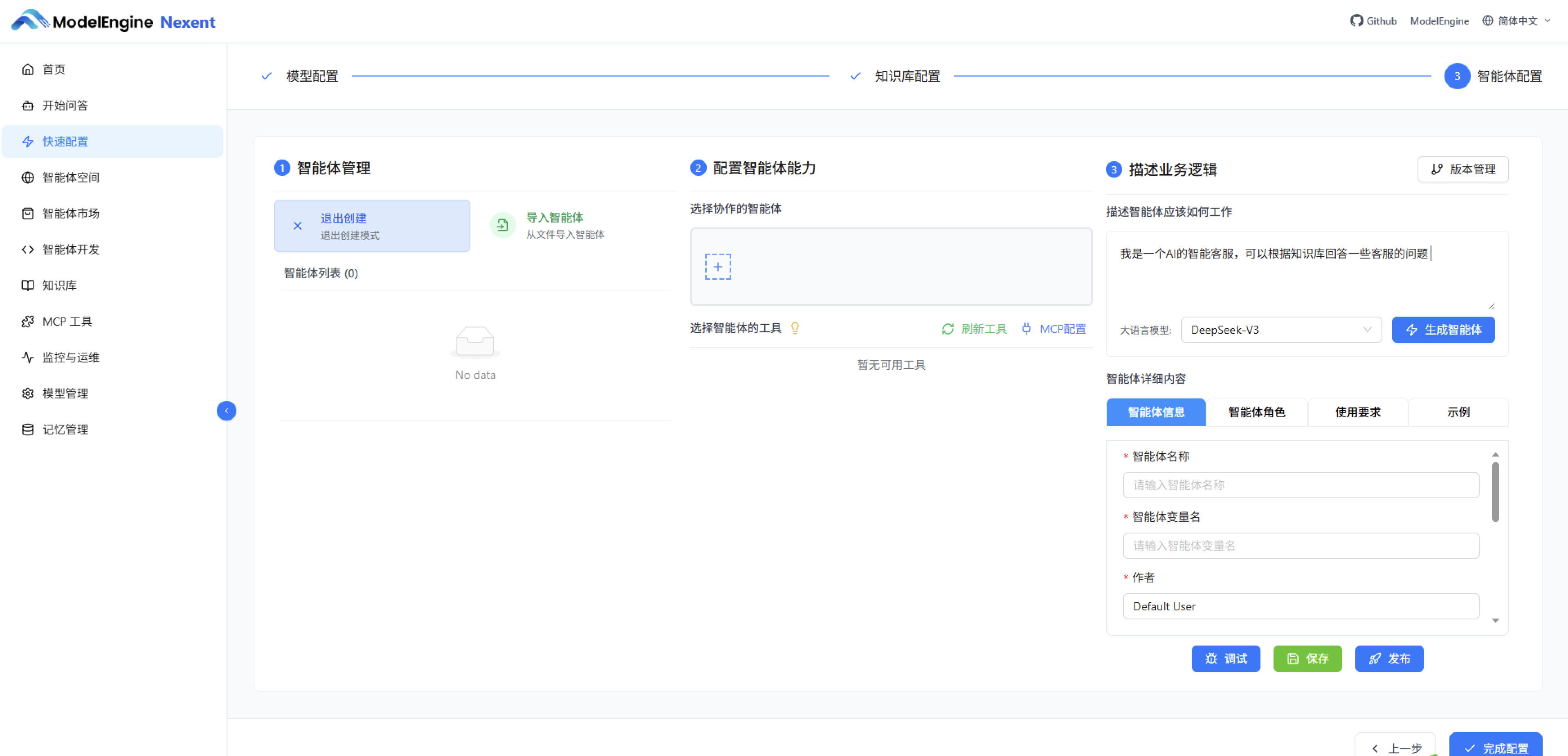

4.2 快速配置一个智能体:

在"应用设置"中,配置智能体的其它功能前,将应用的名称和应用的详细描述配置好,只需用自然语言描述智能体功能,这样在创建智能体时,智能体会根据应用的名称和描述来生成智能体的名称和描述,点击下一步即可。

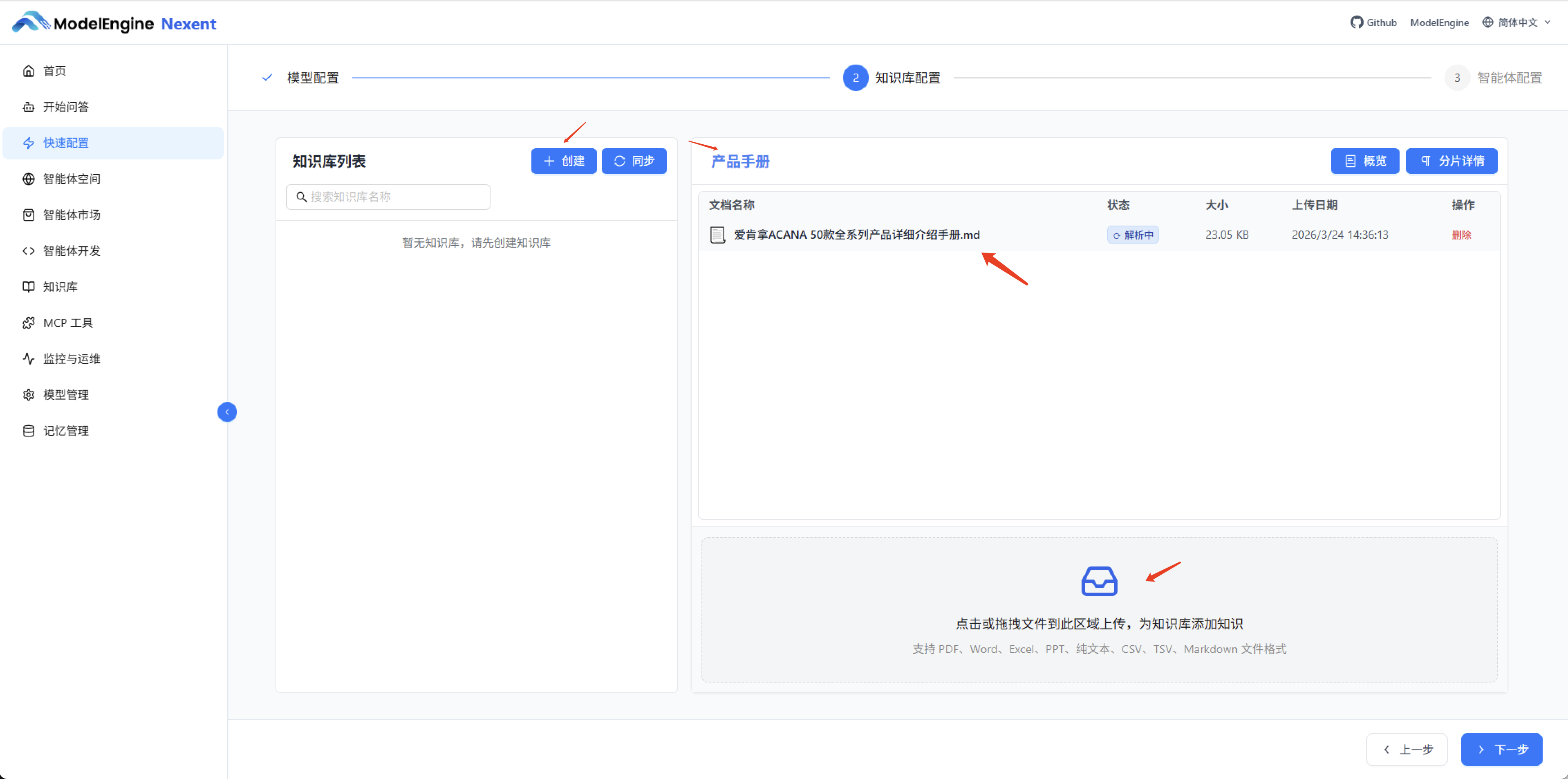

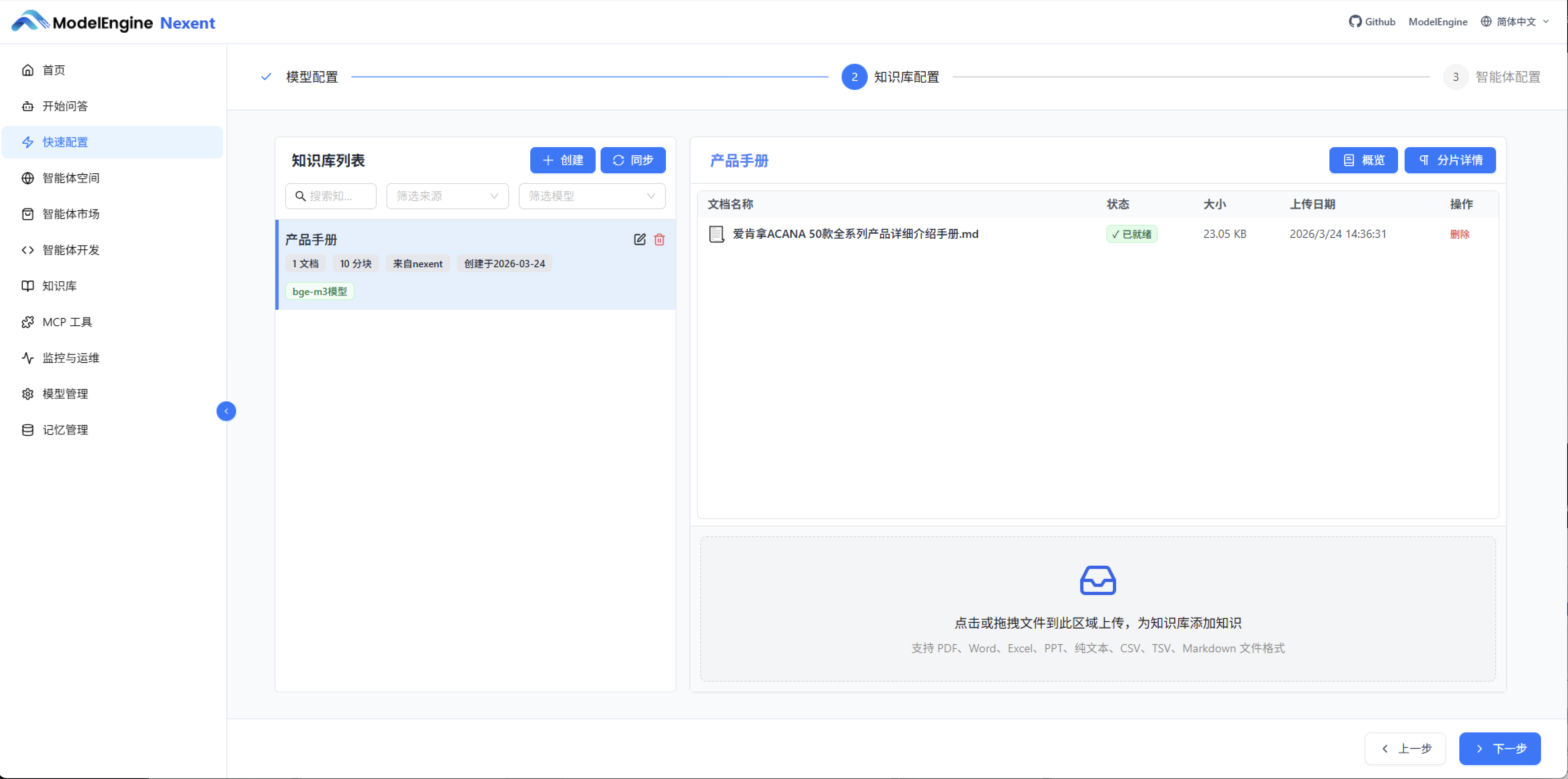

4.4 知识库配置:

知识库是ModelEngine Nexent平台进行本地知识管理的重要方式,用户可以通过管理本地知识库增强智能体知识检索RAG能力,在知识库模块,可以创建和管理知识库,上传各种格式的文件,并生成内容总结。知识库是智能体的重要信息来源,让智能体能够访问您的私有数据和文档,Nexent支持创建多类型知识库,让智能体拥有专业领域知识储备,助力智能体在特定领域内提供专业、精准的回答。

这里我们先创建一个"产品手册"的知识库,再将"爱肯拿ACANA 50款全系列产品详细介绍手册.md"文件上传到知识库中,可以看到刚刚上传的状态在"解析中",说明文件正在进行分片解析处理。

系统会自动处理上传的文件,提取文本内容并进行向量化,可在列表中查看文件的处理状态(解析中/入库中/已就绪)。点击文件名可查看详细信息,包括文件元数据、分片数量、向量化状态等。

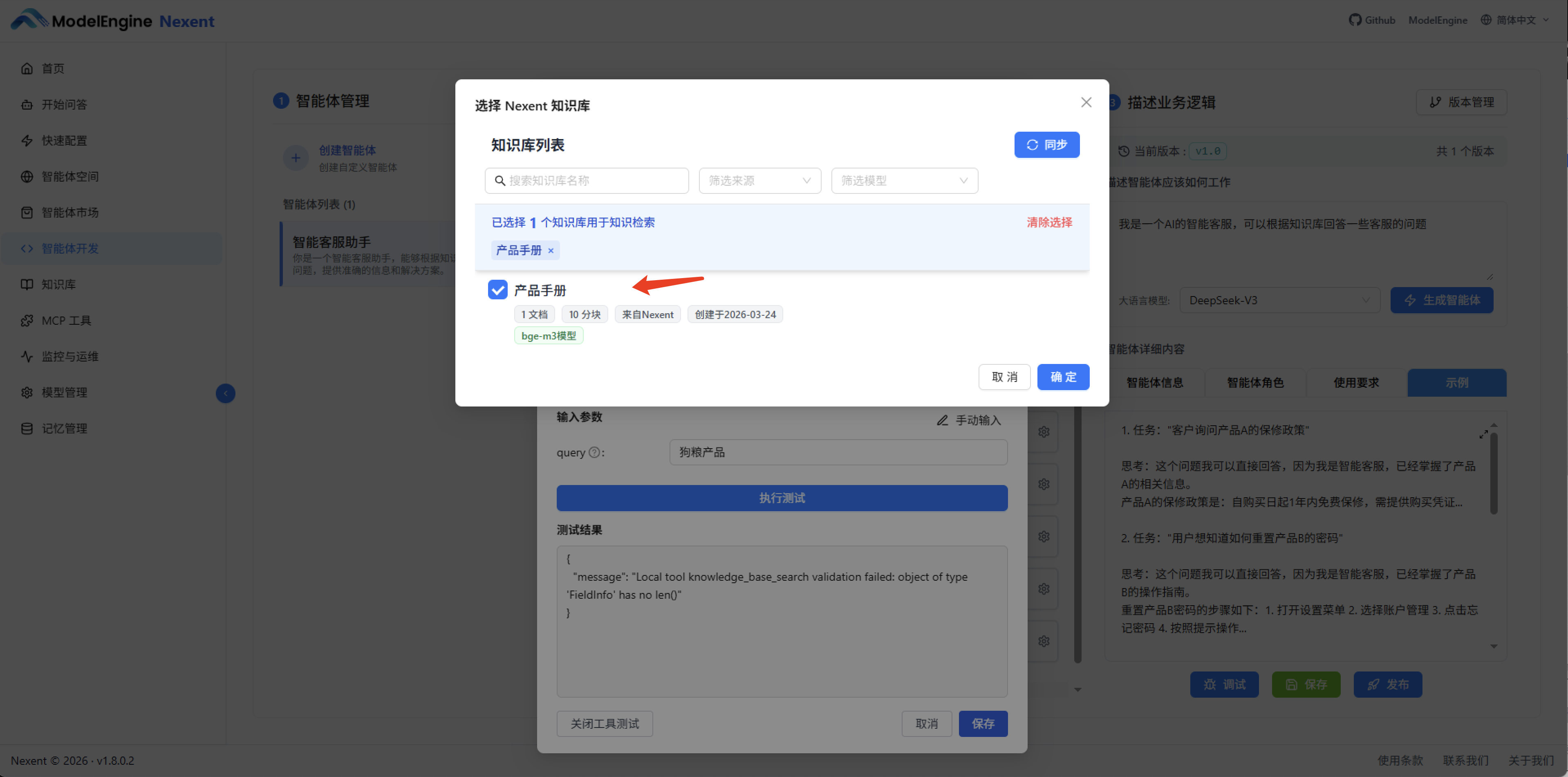

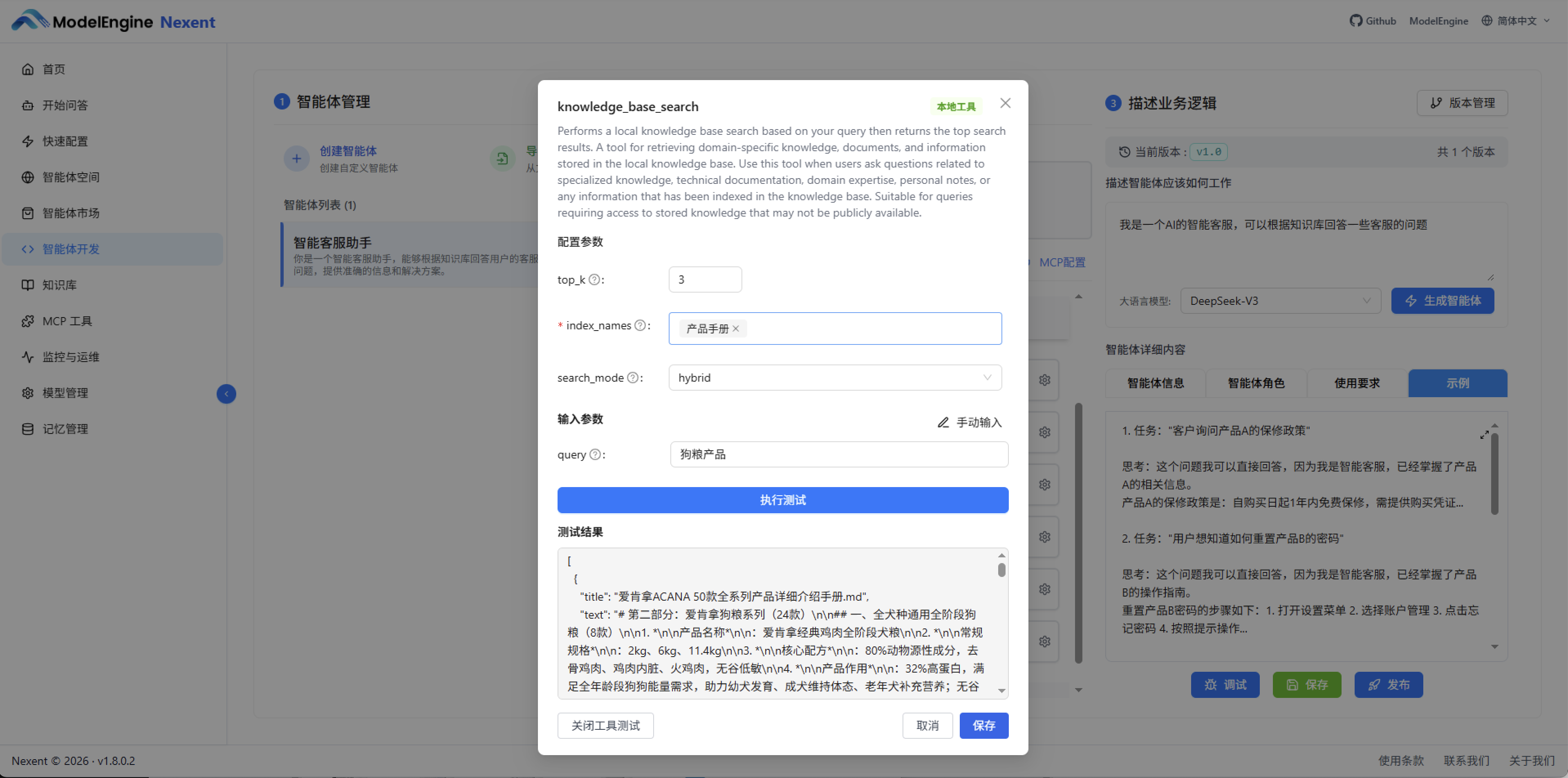

知识库创建完成后,需先选中该知识库;同时在智能体配置页面启用「knowledge_base_search」工具这样才能在后续问答中调用,并且需要重新生成提示词,确保咱们的配置生效。

4.5 提示词配置:

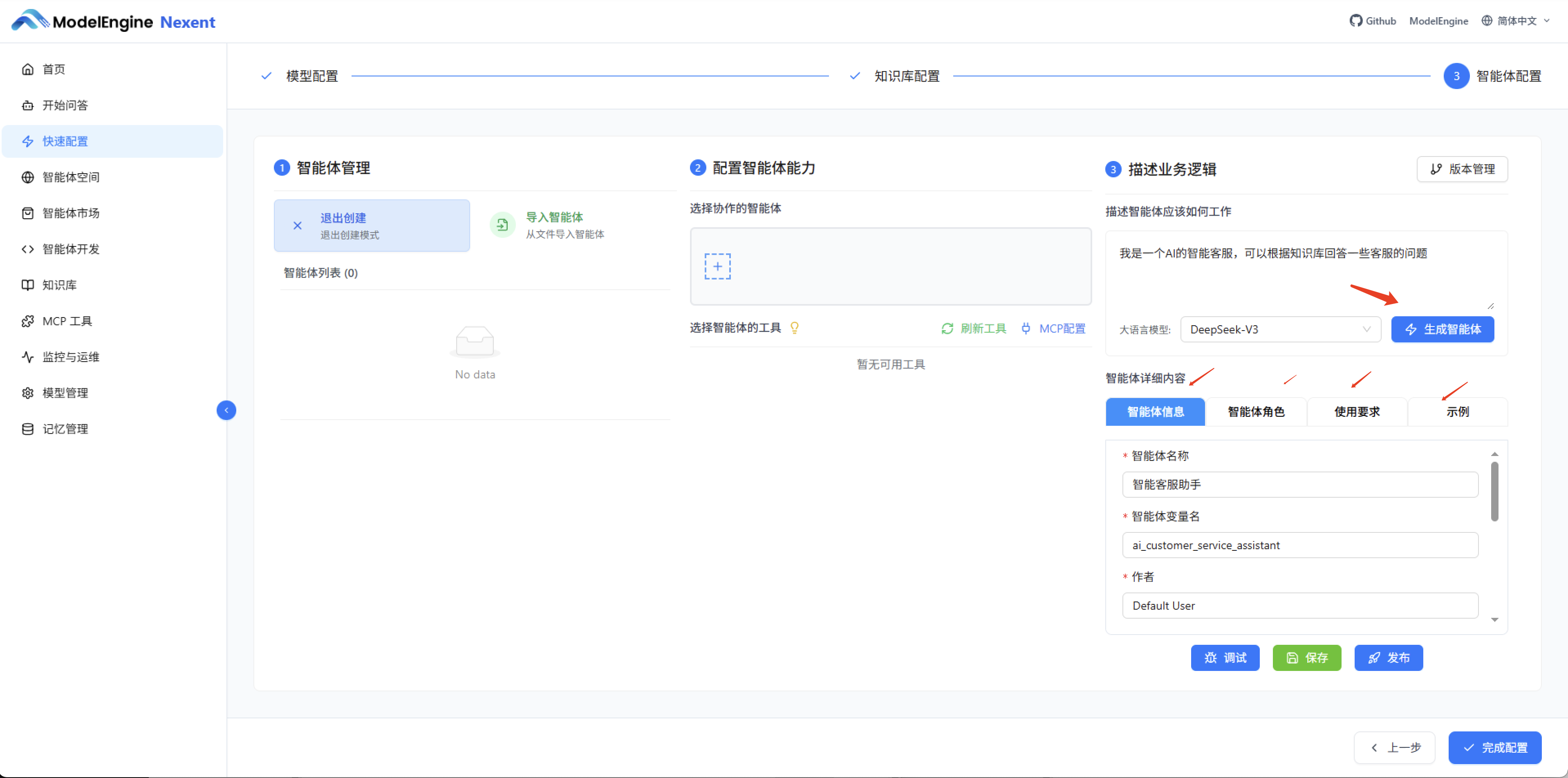

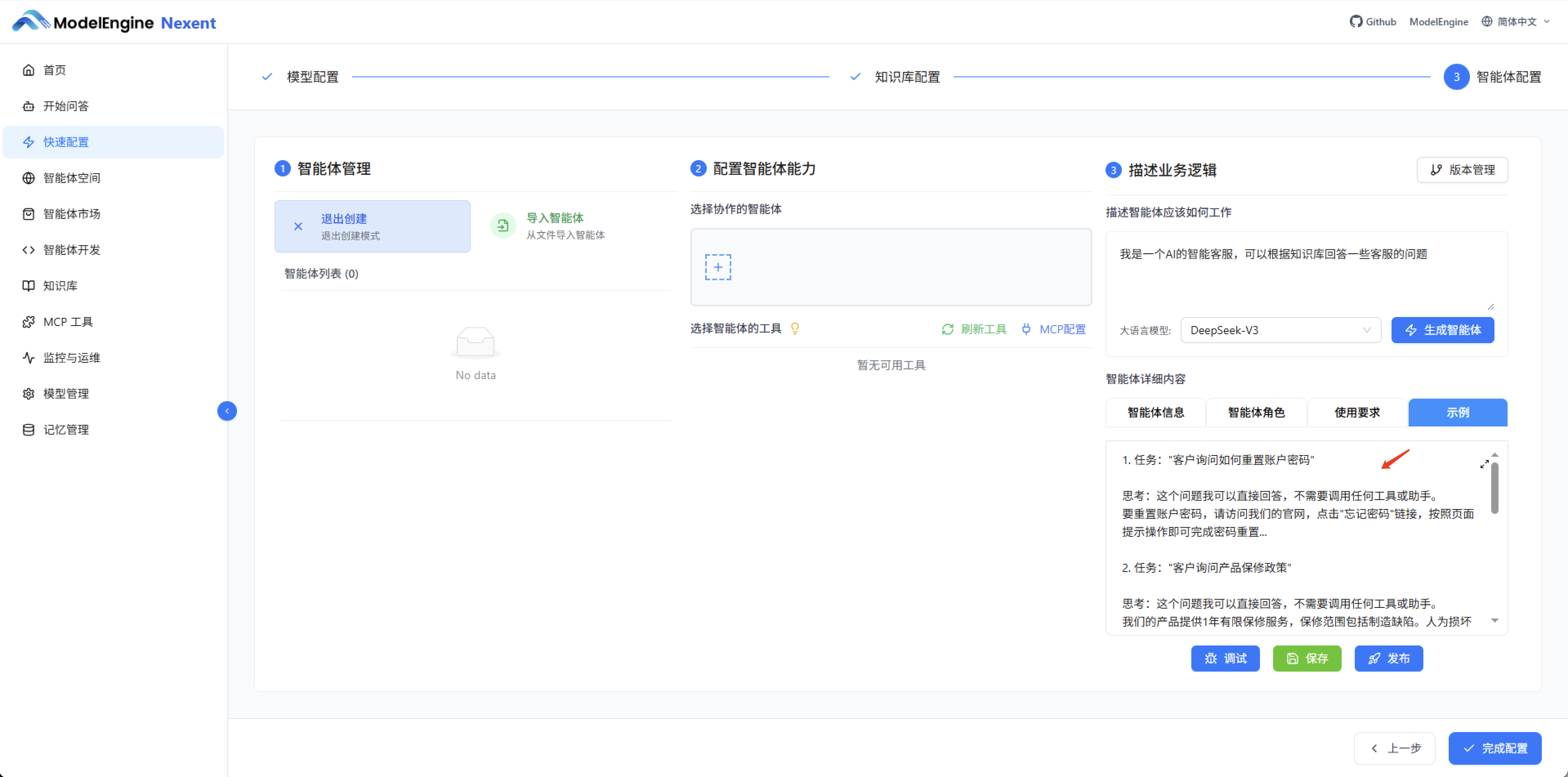

在描述业务逻辑中,跟其它的智能体一样,这里可以配置提示词,提示词是智能体与用户进行对话时,用于引导智能体的行为和逻辑。ModelEngine Nexent 零代码平台只需输入简短的功能描述,点击"生成智能体"操作后,系统便会自动生成智能体的信息(智能体信息、智能体角色、使用要求、示例)等多个纬度的智能体详细内容。非常适合不擅长撰写复杂提示词的开发者来说,大大降低了智能体开发的门槛。

我们通过一句简单的文案描述,ModelEngine Nexent 零代码平台便为 Agent 角色生成了详尽的角色说明,同时,可以看到将智能体信息、智能体角色、使用要求、示例全部AI填充完成了:

1. 任务:"客户询问产品A的保修政策"

思考:这个问题我可以直接回答,因为我是智能客服,已经掌握了产品A的相关信息。

产品A的保修政策是:自购买日起1年内免费保修,需提供购买凭证...

2. 任务:"用户想知道如何重置产品B的密码"

思考:这个问题我可以直接回答,因为我是智能客服,已经掌握了产品B的操作指南。

重置产品B密码的步骤如下:1. 打开设置菜单 2. 选择账户管理 3. 点击忘记密码 4. 按照提示操作...

3. 任务:"客户投诉产品C送货延迟"

思考:这个问题我可以直接回答,因为我是智能客服,已经掌握了相关处理流程。

对于送货延迟的问题,我们深表歉意。您可以提供订单号,我们会优先处理您的订单并给予适当补偿...

4. 任务:"用户询问产品D的技术参数"

思考:这个问题我可以直接回答,因为我是智能客服,已经掌握了产品D的技术规格。

产品D的技术参数如下:尺寸20x30cm,重量1.5kg,功率50W,支持蓝牙5.0...

5. 任务:"客户想了解退货流程"

思考:这个问题我可以直接回答,因为我是智能客服,已经掌握了退货政策。

我们的退货流程是:1. 联系客服申请退货 2. 收到退货授权码 3. 寄回商品 4. 收到退款...

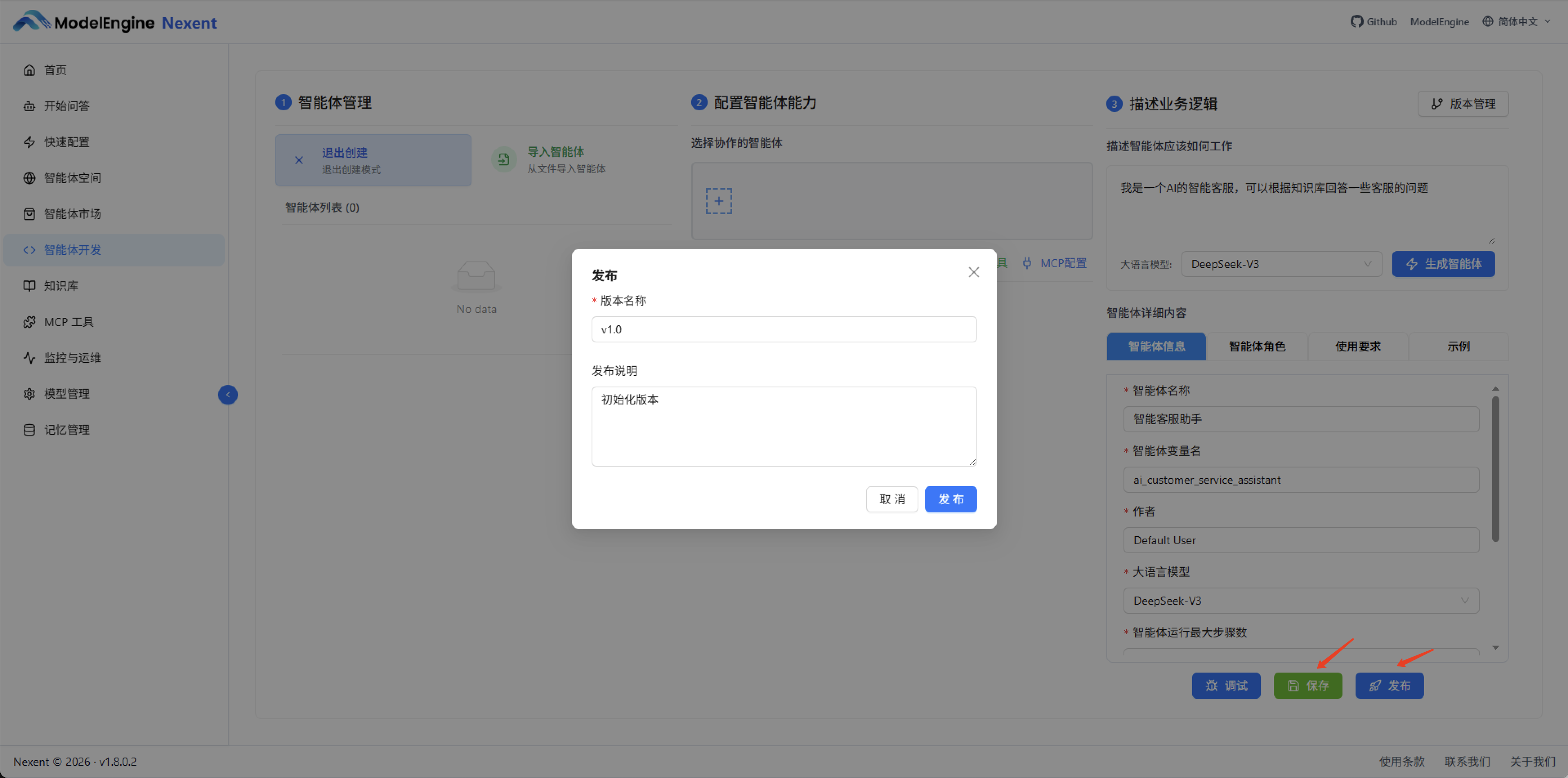

接下来,我们可以点击"保存",再点击一下"发布"。

以上就是借助 ModelEngine 零代码平台进行简单进行了智能体的相关配置,接下来就可以进行智能体的实践测试了。

4.6 智能体实践测试:

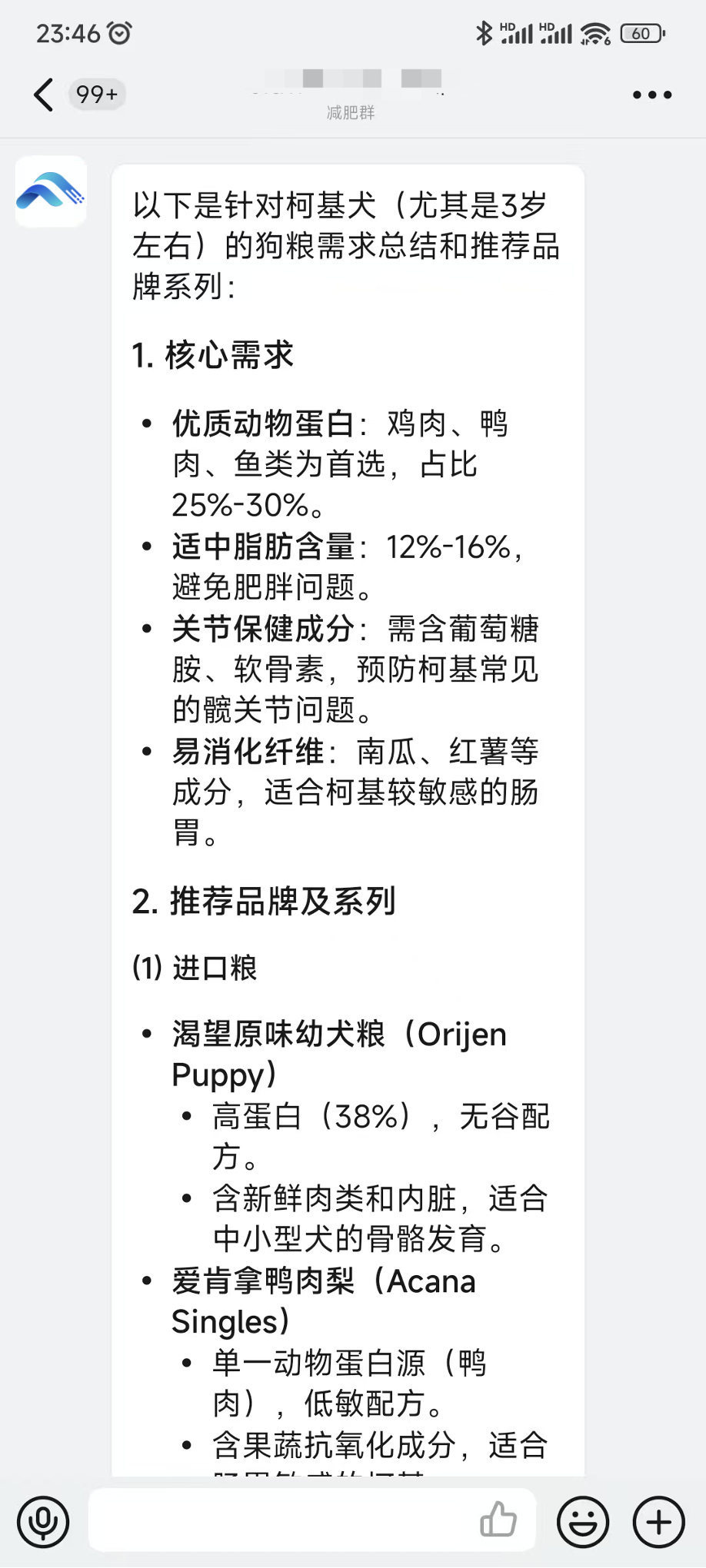

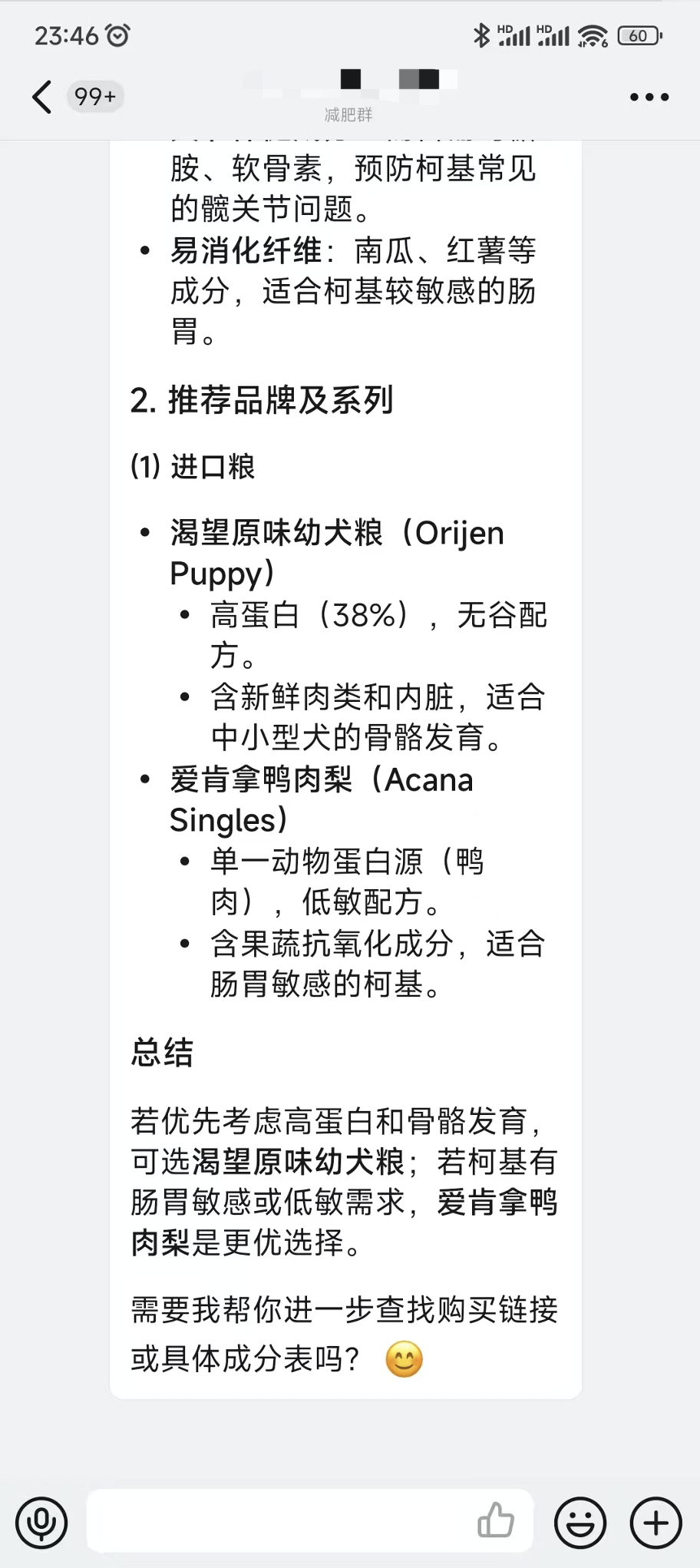

在智能体体的对话框中,我们选择上面创建好的"智能客服助手",接下来就可以进行对话测试了,这里我咨询一下"3岁柯基狗粮推荐"就给出了以下答案:

为3岁的柯基犬选择狗粮时,需考虑其体型适中、易发关节问题和活跃度高的特点。以下是推荐方向和具体建议:

---

### **1. 核心需求**

- **优质动物蛋白**(鸡肉、鸭肉、鱼类等为首选,占比25%-30%)

- **适中脂肪含量**(12%-16%,避免肥胖)

- **关节保健成分**(葡萄糖胺、软骨素,预防髋关节问题)

- **易消化纤维**(南瓜、红薯等,柯基肠胃较敏感)

---

### **2. 推荐品牌及系列**

#### **(1)进口粮**

- **渴望原味幼犬粮(Orijen Puppy)**

- 高蛋白(38%)、无谷,含新鲜肉类和内脏,适合中小型犬骨骼发育。

- **爱肯拿鸭肉梨(Acana Singles)**

- 单一动物蛋白源(鸭肉),低敏配方,含果蔬抗氧化。

- **Now Fresh小型犬粮**

- 火鸡肉+三文鱼配方,无谷且含益生菌,支持消化健康。

#### **(2)国产/性价比款**

- **伯纳天纯小型犬成犬粮**

- 鸭肉+紫薯配方,添加软骨素和益生元,国内购买方便。

- **比瑞吉健康体态粮**

- 低脂(14%脂肪),含L-肉碱帮助控制体重。

- **网易严选全期犬粮**

- 三文鱼+鸡肉组合,性价比高,通过AAFCO标准。

---

### **3. 需避开的成分**

- ❌ 过量谷物(如玉米、小麦易致敏)

- ❌ 人工防腐剂(BHA/BHT)

- ❌ 脂肪含量>18%(柯基易胖)

---

### **4. 喂养小贴士**

- **每日量**:约60-80g(分2餐),根据运动量调整。

- **换粮过渡**:7天内逐步替换旧粮,观察排便是否正常。

- **加分项**:每周可添加1-2次煮熟的三文鱼(富含Omega-3)或蓝莓(抗氧化)。

---

### **5. 特殊情况处理**

- 若狗狗有软便:选择单一蛋白源+低敏配方(如鸭肉)。

- 若关节已有不适:补充含MSM的关节护理粮(如希尔思j/d系列)。

建议结合狗狗的个体差异(如活动量、过敏史)选择,并定期体检调整饮食。

五、从单一到多元化 - 使用MCP打通企业机器人对话:

5.1 什么是MCP?

MCP(Model Compatibility Platform)是华为云推出的模型兼容性平台,旨在帮助开发者轻松地将大语言模型接入到各种应用场景中。通过MCP,开发者可以快速找到适配的模型和工具,无需深入了解底层技术细节,即可实现模型的集成和应用开发。MCP支持多种模型和工具的集成,包括文本生成、图像识别、语音识别等,为开发者提供了丰富的功能和灵活性。

5.2 如何配置工具和MCP?

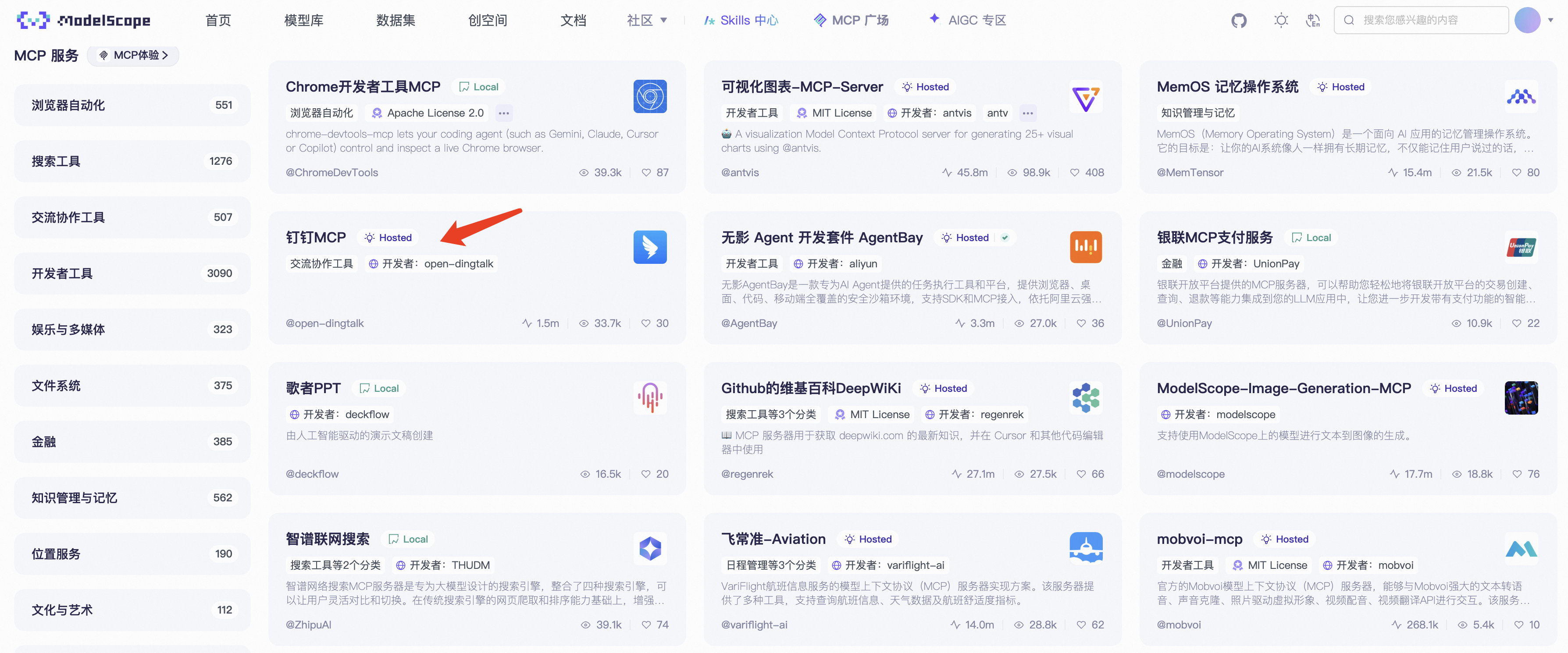

我们可以通过访问魔搭社区的MCP广场,魔搭社区的MCP广场是 ModelScope(魔搭)社区于 2025年4月15日 正式推出的国内最大 MCP(Model Context Protocol)中文社区平台,旨在降低大语言模型调用外部工具与数据源的门槛,推动 AI 智能体(Agent)和 AI 应用的快速开发与落地。

- 统一标准接口:基于 Anthropic 于 2024 年 11 月推出的开源协议 MCP,实现大模型通过统一接口对接各类工具、API 和数据源 。

- 海量服务集成:截至 2026年3月,已上线 超9200个 MCP Server,覆盖搜索、地图、支付、开发者工具、多模态生成(如语音、图像、视频)等多个领域 。

- 独家首发服务:包括 支付宝、MiniMax 等知名企业的 MCP 服务在魔搭独家首发 。

- 免费托管与一键部署:提供免费云端资源,支持开发者将自建 MCP 服务托管至平台,实现“开箱即用” 。

- 调试与实验工具:

- MCP 实验场:在线配置和调试 MCP 服务 。

- MCP Bench:开源评估工具,用于对比服务性能、效率与资源消耗 。

- 三层开放体系:

- 底层:汇聚社区与官方 MCP 工具,提供免费托管;

- 中层:通过 Open API 支持外部应用集成;

- 上层:落地于 MCP 实验场及第三方平台(如通义灵码、Cherry Studio)。

5.3 配置钉钉机器人:

将 ModelEngine Nexent 与 钉钉 打通,可实现通过钉钉MCP聊天窗口直接调用 AI 自动化能力(如生成文档、查询信息、执行任务等),结合大模型与钉钉消息通道,构建一个轻量化、随时可用、专业可靠的养虾问答助手,降低“养殖”技术门槛。

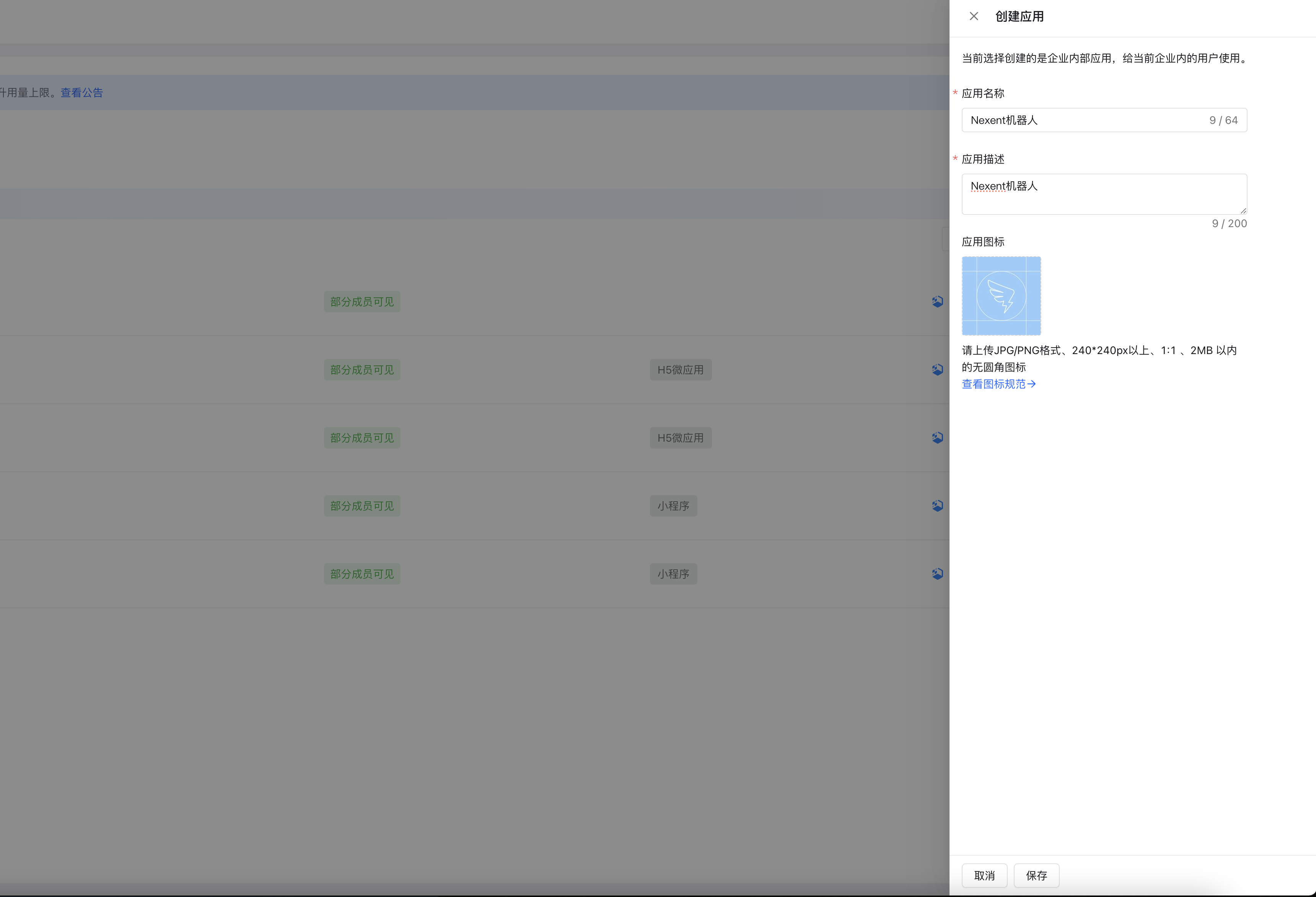

进入钉钉开发者后台,访问 https://open-dev.dingtalk.com,登录后在顶部菜单,选择 “应用开发” → “钉钉应用” → “创建应用”:

填写应用的名称和描述,再上传一个应用的图标,并点击 "保存"即可创建的一个新的应用。

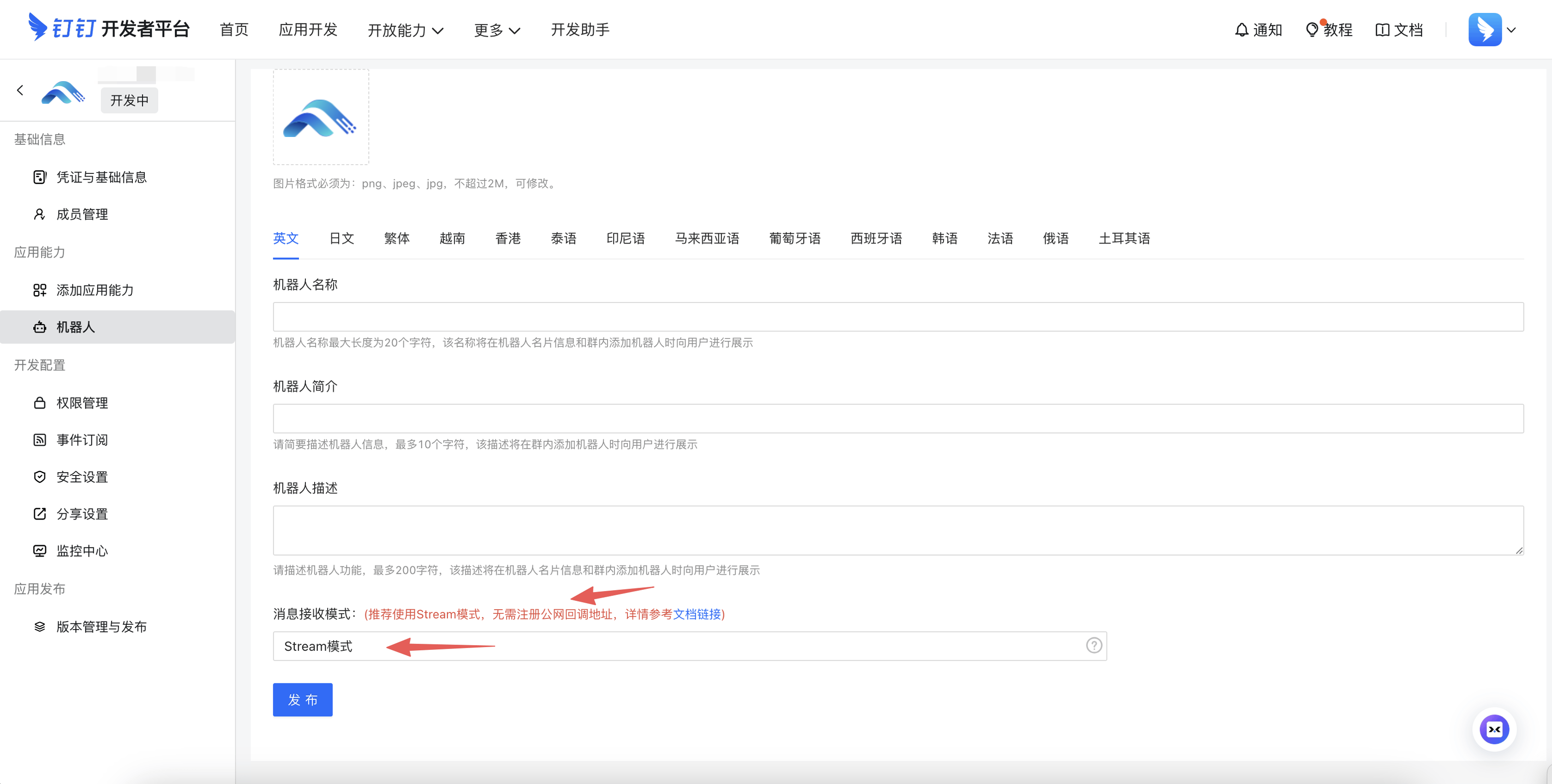

在"添加应用能力"中,我们可以选择最为简单的机器人来配置一下添加机器人能力,这样我们可以通过机器人实现高效的消息推送和接收的效果,使用机器人向组织内用户或群内发送和接收消息,实现消息的自动高效触达。

接下来,点击开启"机器人配置",并填写机器人名称(如自动化OA办公)、机器人简介(≤10 字)等信息,还可以上传机器人消息预览的图片。

配置消息接收模式这里,建议使用"Stream"模式,这样可以使用WebSocket长连接,无需公网IP,适合云函数/本地调试。

接下来需要进行"配置权限",在 “权限管理” 页面,开启以下权限(建议):

- 送单聊/群聊消息:qyapi_robot_sendmsg

- 根据手机号查 userId(用于单聊):topapi_v2_user_getbymobile

- 发送互动卡片:Card.Instance.Write

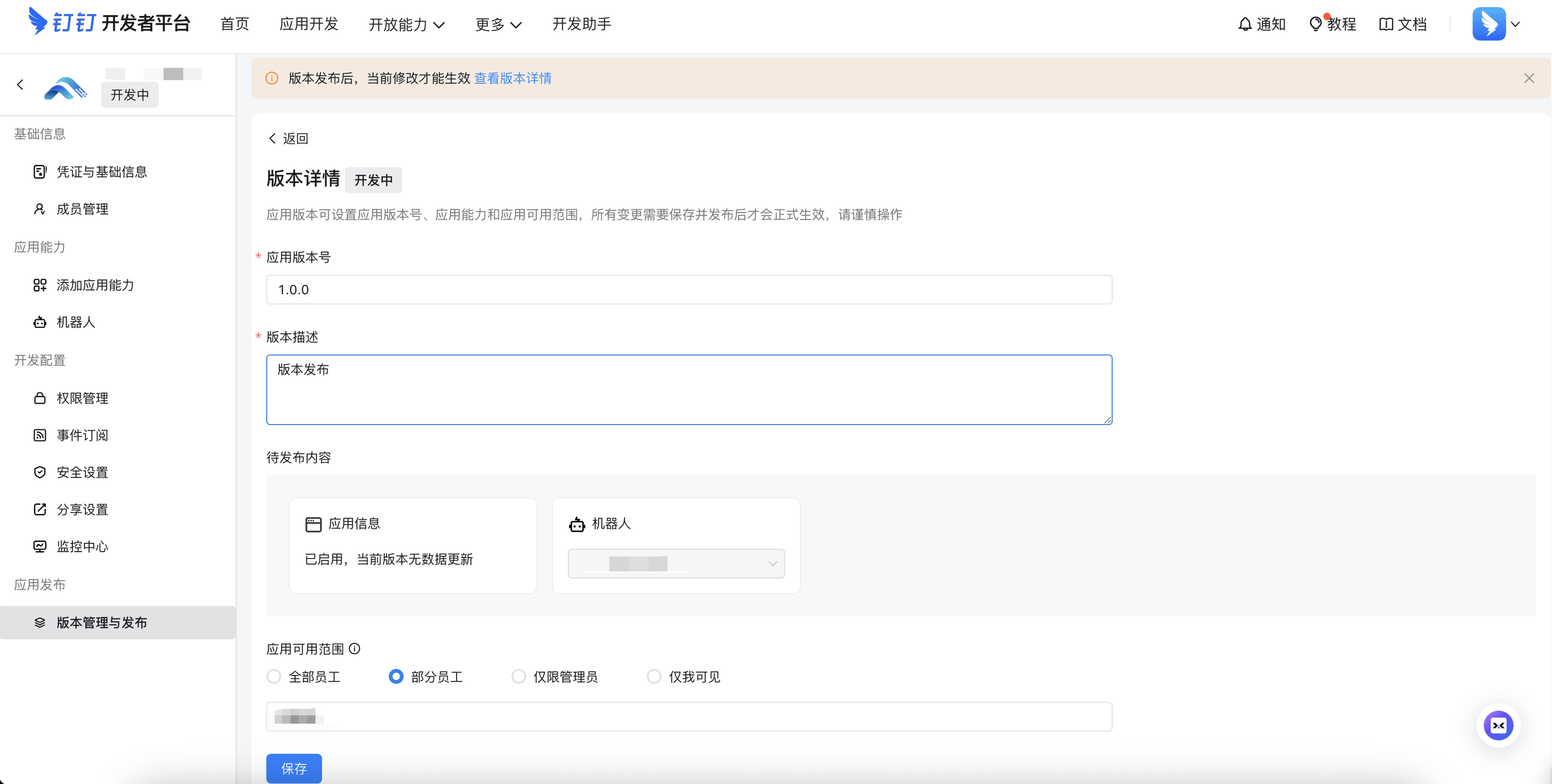

- 流式更新卡片(AI 场景必备):Card.Streaming.Write

最后,保存并发布机器人,填写完版本号和版本描述后,即可点击"保存"按钮来进行应用的发布。

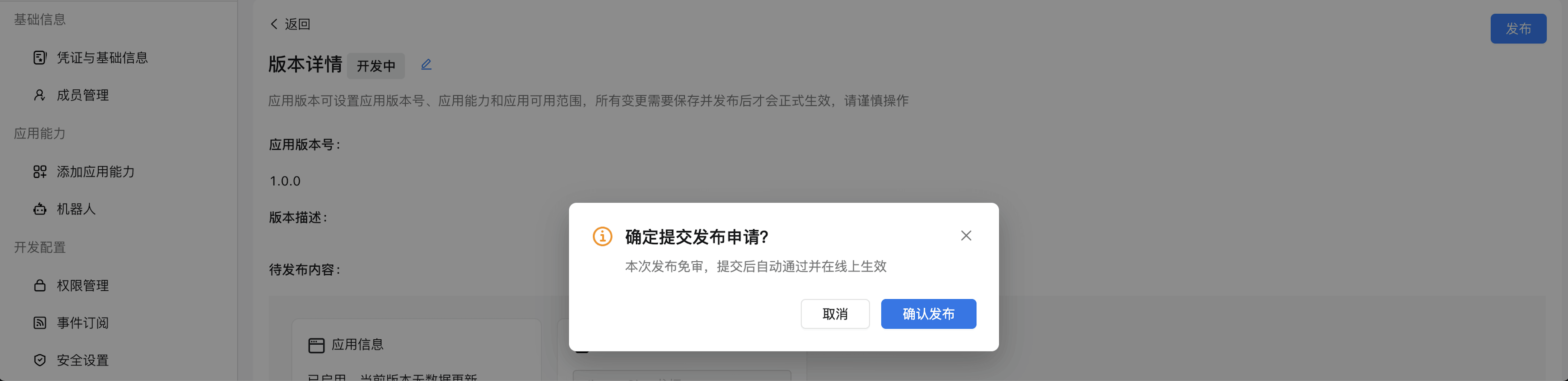

因为我们开通了自动发布的功能,所以,直接点击"发布"按钮,即可完成应用的发布(自动shenhee上线)。

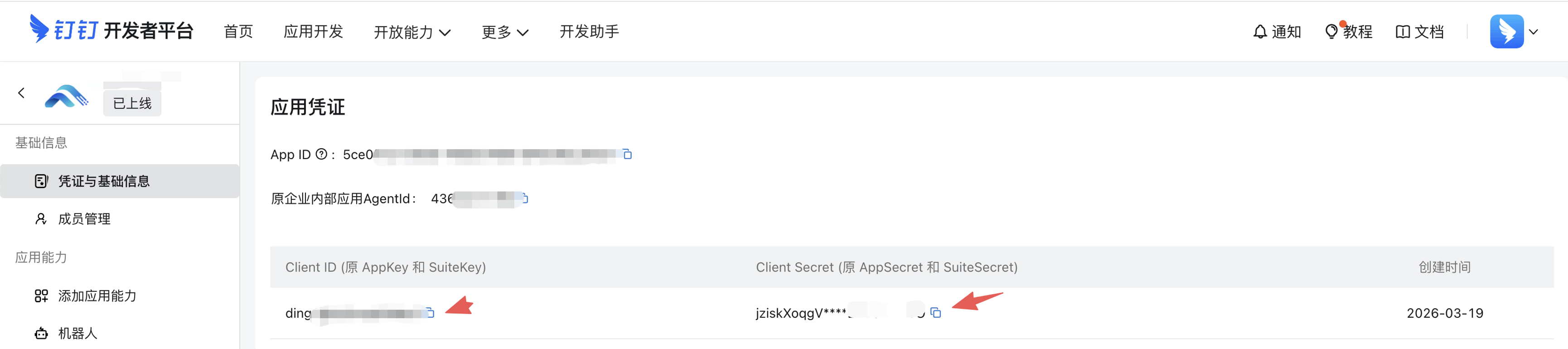

最后,可以看到在左上角的"应用"中,已经显示"已上线",这样就表示一个钉钉机器人就配置成功了,在"凭证与基础信息"是2项是需要配置到魔搭社区的MCP中,就可以打通钉钉机器人和魔搭社区的MCP之间的联系了:

- Client ID

- Client Secret

我们通过钉钉客户端软件,可以直接搜索"Nexent龙虾",然后点击进入,就可以看到Nexent的钉钉机器人了。

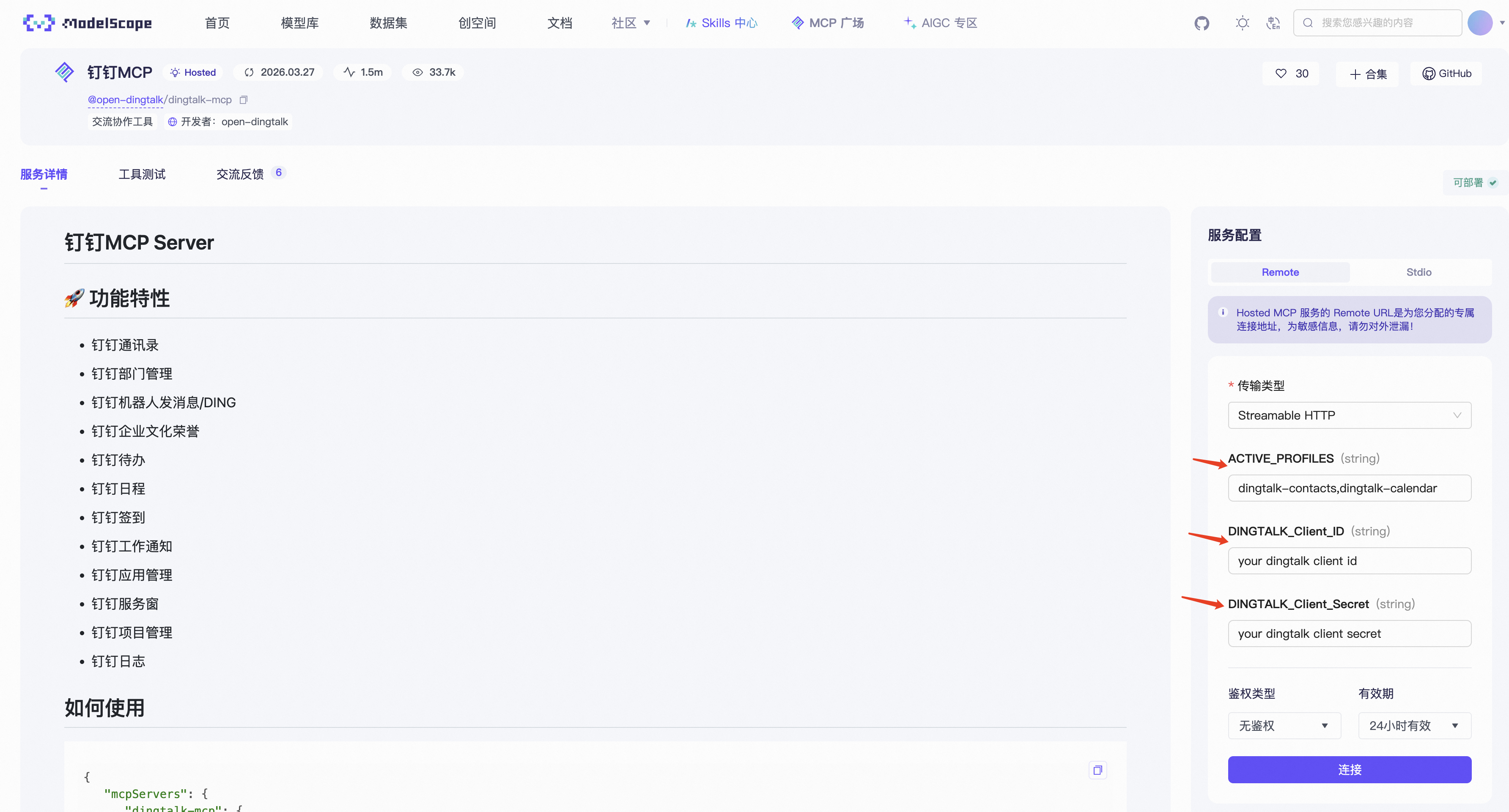

5.4 配置MCP工具:

想要进行企业打通办公场景就需要钉钉、企业微信等对接,这里我们选择钉钉对接,在上面我们已经配置好了钉钉机器人,接下来我们需要在魔搭社区的MCP广场中将相关参数配置到MCP中,即可得到一个在线可以使用的MCP工具:

添加相关的工具参数后,可以点击"连接"按钮即可创建一个在线的MCP工具,此时,可以在配置中配置工具参数,工具参数的配置项如下:

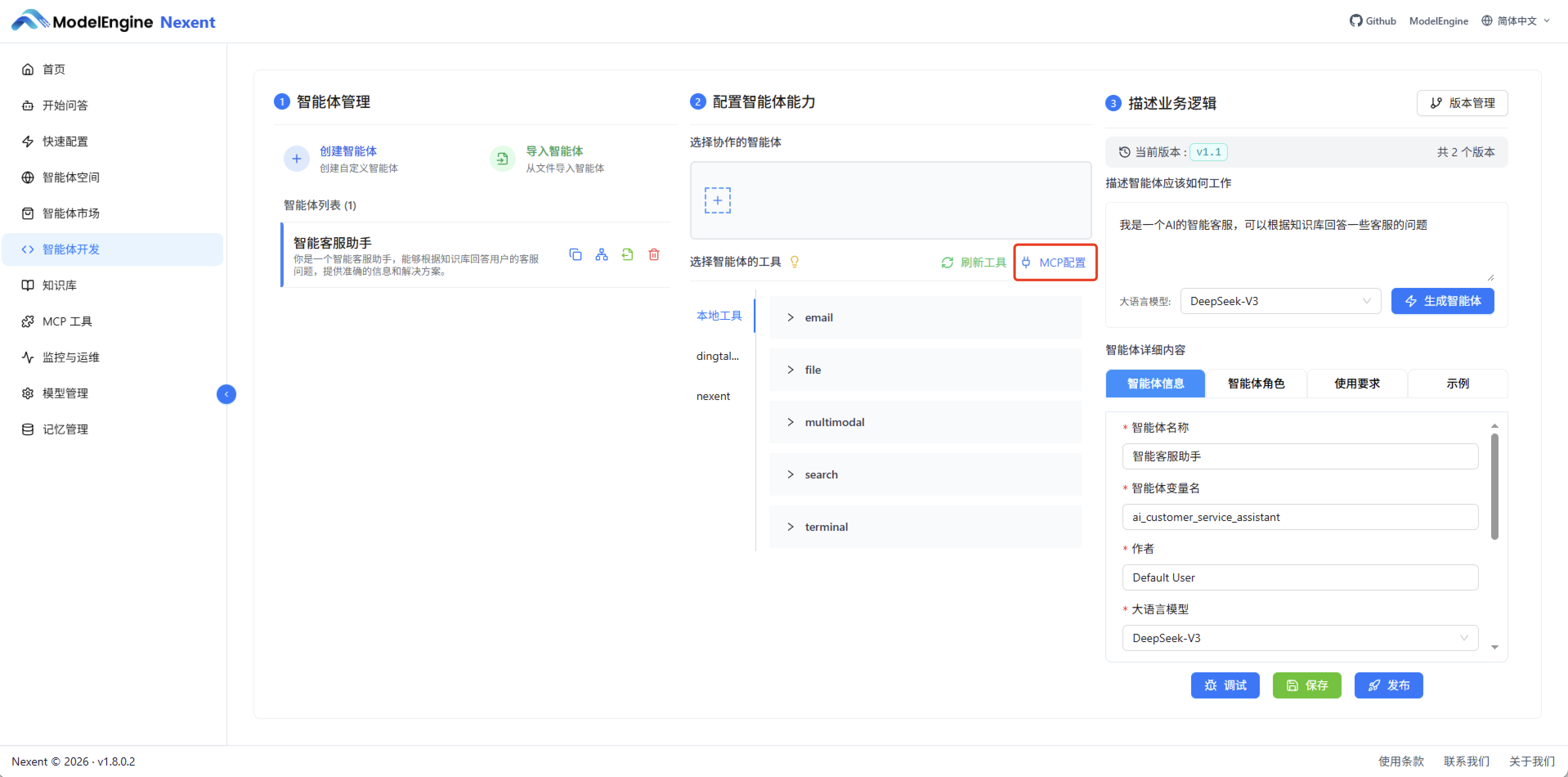

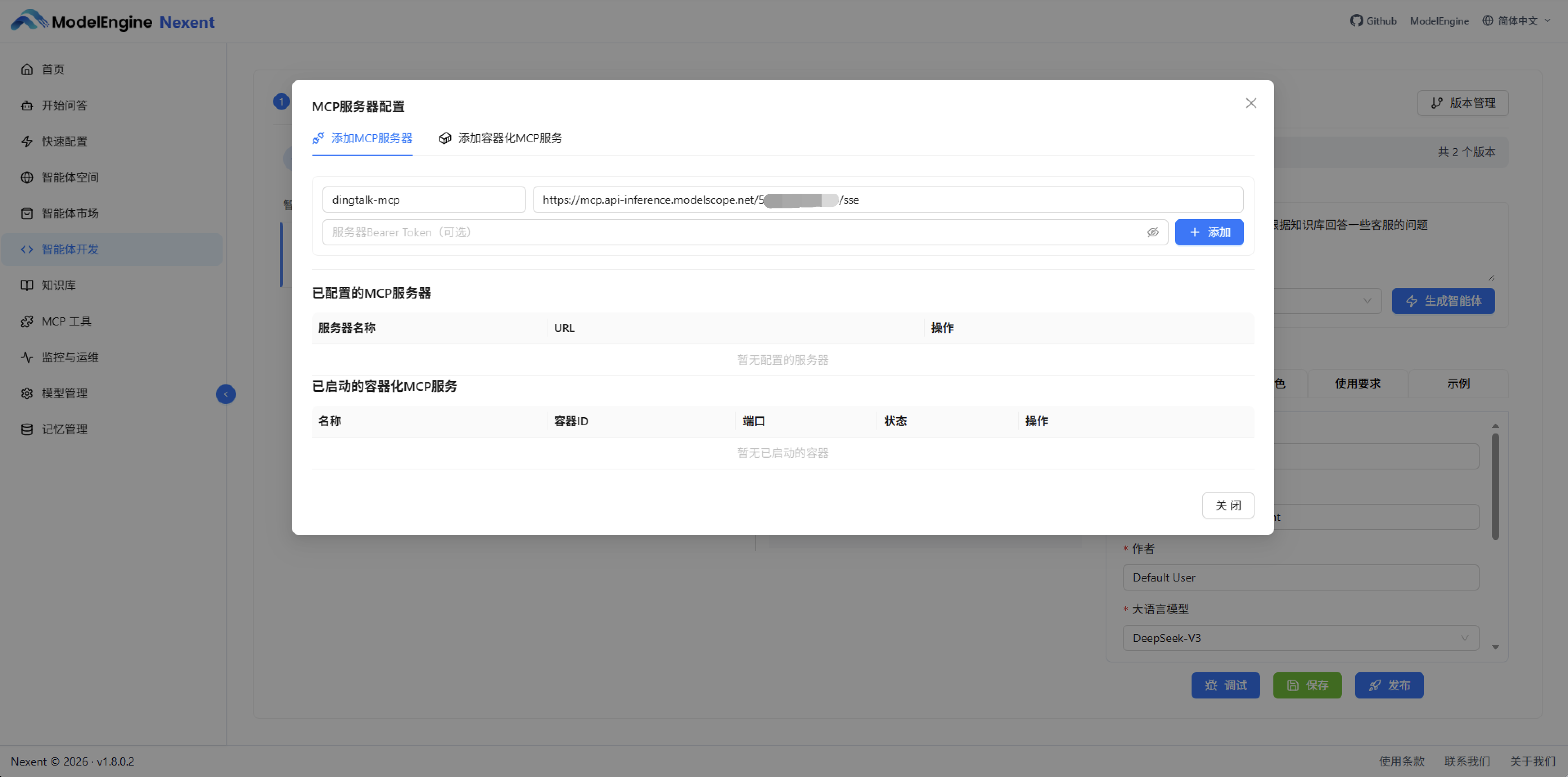

在ModelEngine Nexent 智能体中,我们点击"MCP配置":

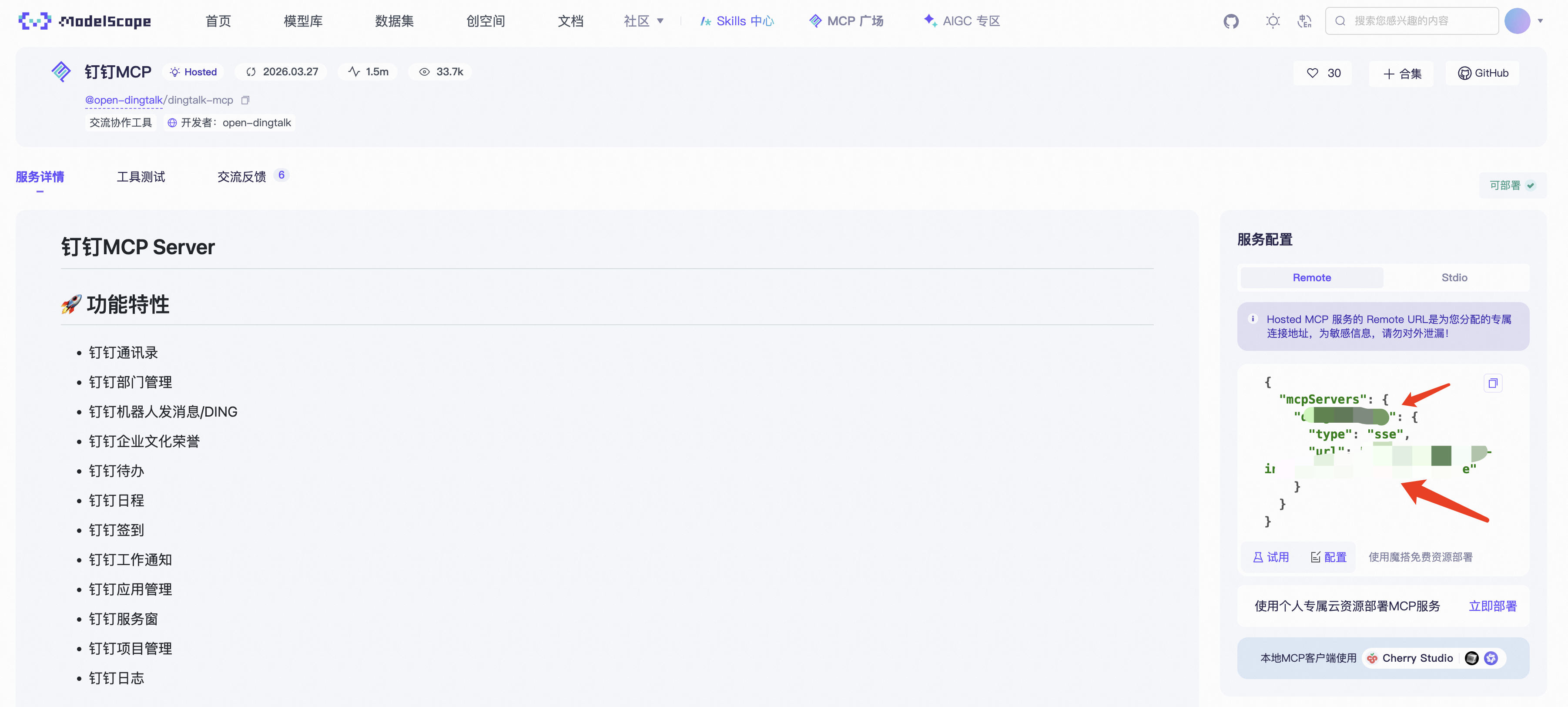

将相关参数配置到MCP中:

- 服务器名称:dingtalk-mcp

- 服务器地址:https://mcp.api-interence.modelscope.net/xxxxx/sse

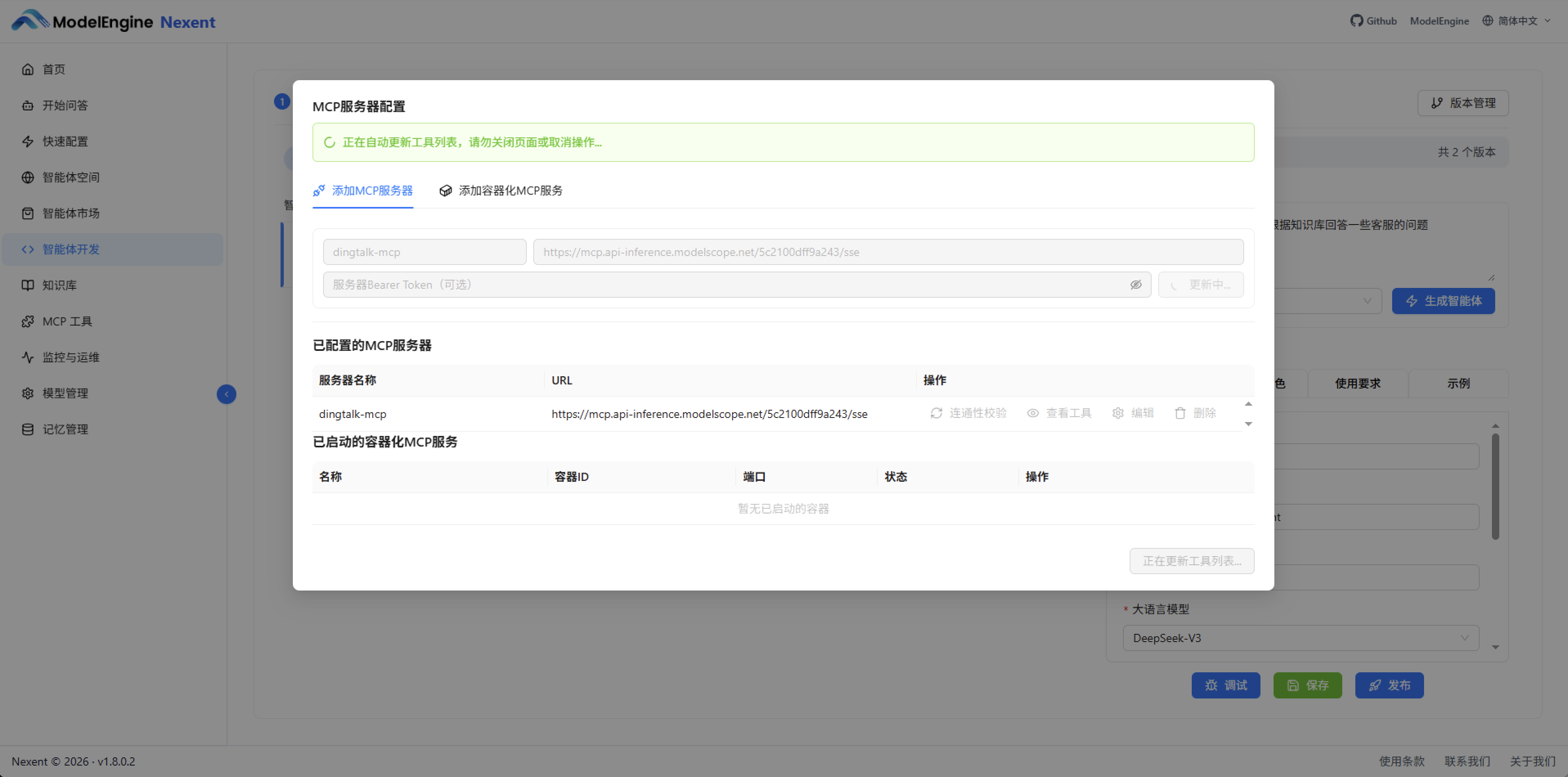

点击添加后,会自动进行更新工具列表操作,等待几秒钟后,下面的已配置的MCP服务器也是置灰的:

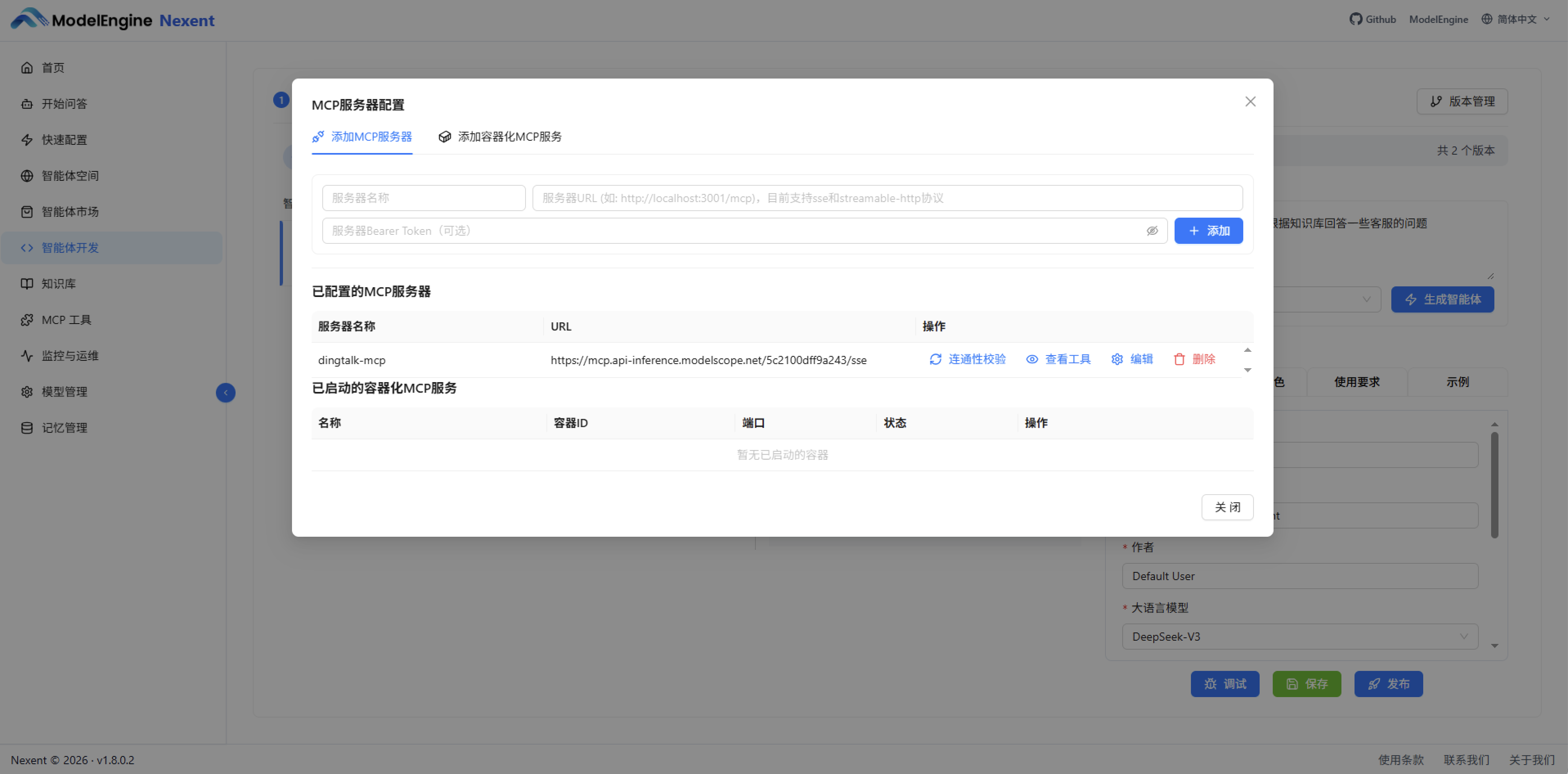

如果连接成功后,可以看到工具列表中新增了一个MCP工具,这里可以进行连通性的测试、查看相关的工具、编辑和删除的功能:

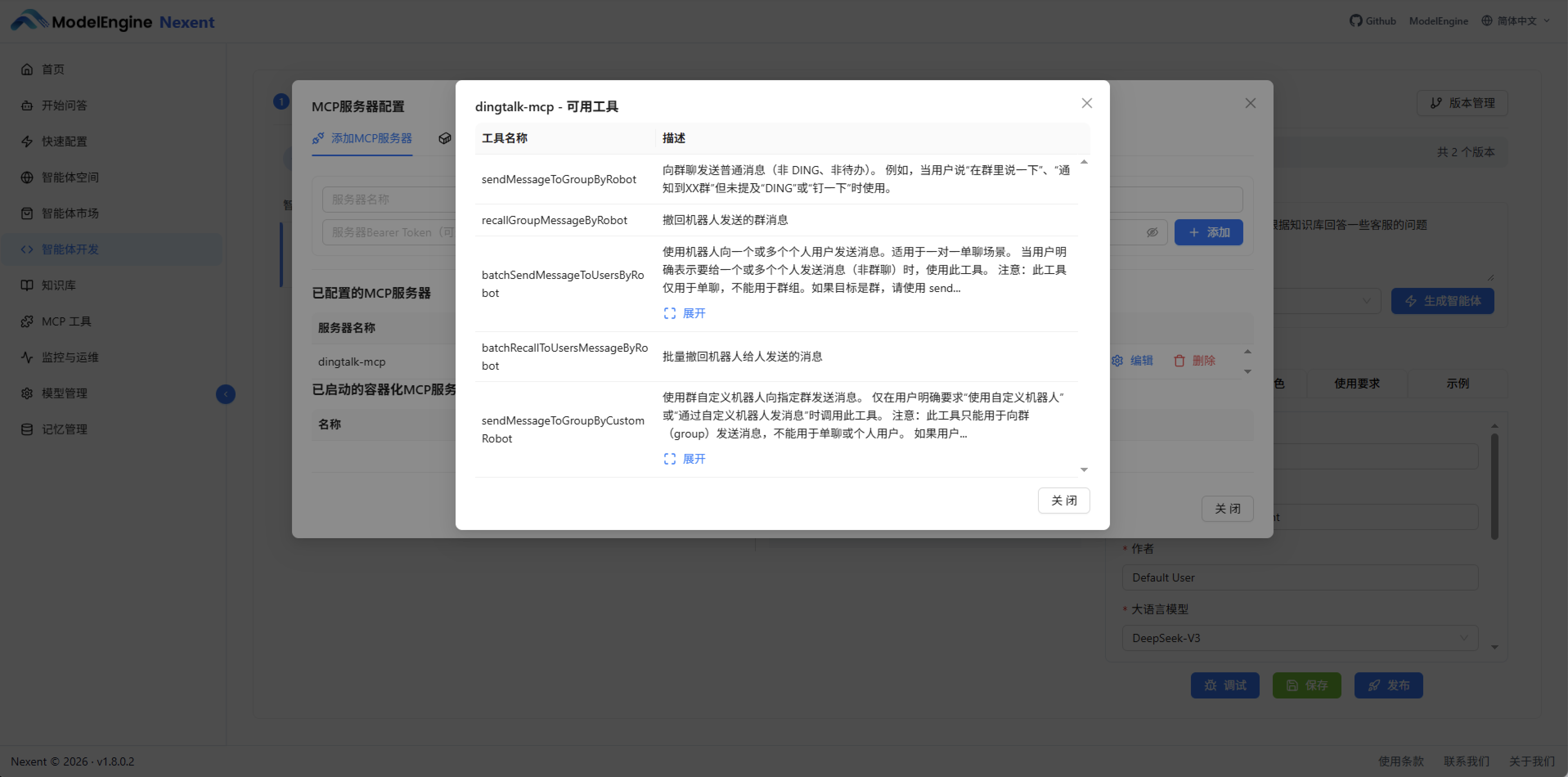

对于dingtalk-mcp提供的可用工具列表如下:

| 工具名称 | 描述 |

|---|---|

| sendMessageToUserByRobot | 向个人用户发送普通消息(非 DING、非待办)。 例如,当用户说“给XX说一下”、“通知XX”但未提及“DING”或“钉一下”时使用。 |

| recallGroupMessageByRobot | 撤回机器人发送的群消息 |

| batchSendMessageToUsersByRobot | 使用机器人向一个或多个个人用户发送消息。适用于一对一单聊场景。 当用户明确表示要给一个或多个个人发送消息(非群聊)时,使用此工具。 注意:此工具仅用于单聊,不能用于群组。 |

| batchRecallToUsersMessageByRobot | 批量撤回机器人给人发送的消息 |

| sendMessageToGroupByCustomRobot | 使用群自定义机器人向指定群发送消息。 仅在用户明确要求“使用自定义机器人”或“通过自定义机器人发消息”时调用此工具。 注意:此工具只能用于向群(group)发送消息,不能用于单聊或个人用户。 |

配置成功后,可以看到智能体的工具中已经有dingtalk-mcp工具了,右边也显示了可用的工具列表:

重新再修改一下智能体的提示词,将信息整理后发送给钉钉机器人:

可以看到示例中的提示词就已经修改为其它的提示词了,接下来就可以进行测试了。

示例1:用户询问"如何购买产品A?"

思考:我需要先查询知识库获取产品A的购买流程信息,然后将信息整理后发送给钉钉机器人。

代码:

``<RUN>

product_info = knowledge_base_search(query="产品A 购买流程")

print(product_info)

``<END_CODE>

观察结果:产品A的购买流程:1.登录官网 2.选择产品A 3.填写收货信息 4.完成支付

思考:我已经获取了购买流程信息,现在需要整理并发送给钉钉机器人。

代码:

```<RUN>

dingtalk_message = "产品A购买流程:\n1.登录官网\n2.选择产品A\n3.填写收货信息\n4.完成支付"

dingtalk_robot(message=dingtalk_message)

print("消息已发送")

```<END_CODE>

观察结果:消息已成功发送到钉钉机器人

思考:我已经完成了任务,现在将回复用户。

产品A的购买流程信息已发送给您,请查收钉钉消息。

---

### 示例2:用户询问"你们的会员怎么开通?"

思考:我需要查询知识库获取会员开通方式,然后整理信息发送给钉钉机器人。

代码:

``<RUN>

member_info = knowledge_base_search(query="会员 开通方式")

print(member_info)

``<END_CODE>

观察结果:会员开通方式:1.官网注册 2.APP内购买会员 3.联系客服人工开通

思考:我已经获取了会员开通信息,现在需要整理并发送。

代码:

``<RUN>

dingtalk_message = "会员开通方式:\n1.官网注册\n2.APP内购买会员\n3.联系客服人工开通"

dingtalk_robot(message=dingtalk_message)

print("消息已发送")

``<END_CODE>

观察结果:消息已成功发送到钉钉机器人

思考:任务已完成,回复用户。

会员开通方式已发送给您,请查收钉钉消息。

---

### 示例3:用户询问"退货流程是什么?"

思考:我需要查询知识库获取退货流程信息,然后整理发送。

代码:

``<RUN>

return_info = knowledge_base_search(query="退货流程")

print(return_info)

``<END_CODE>

观察结果:退货流程:1.联系客服申请 2.填写退货单 3.寄回商品 4.等待退款

思考:信息已获取,现在整理发送。

代码:

``<RUN>

dingtalk_message = "退货流程:\n1.联系客服申请\n2.填写退货单\n3.寄回商品\n4.等待退款"

dingtalk_robot(message=dingtalk_message)

print("消息已发送")

``<END_CODE>

观察结果:消息已成功发送到钉钉机器人

思考:任务完成,回复用户。

退货流程信息已发送给您,请查收钉钉消息。

---

### 示例4:用户询问"产品B的售后服务政策"

思考:我需要查询知识库获取产品B的售后服务政策,然后整理发送。

代码:

``<RUN>

service_info = knowledge_base_search(query="产品B 售后服务政策")

print(service_info)

``<END_CODE>

观察结果:产品B售后服务:7天无理由退货,1年保修

思考:信息已获取,现在整理发送。

代码:

``<RUN>

dingtalk_message = "产品B售后服务政策:\n7天无理由退货\n1年保修"

dingtalk_robot(message=dingtalk_message)

print("消息已发送")

``<END_CODE>

观察结果:消息已成功发送到钉钉机器人

思考:任务完成,回复用户。

产品B的售后服务政策已发送给您,请查收钉钉消息。

---

### 示例5:用户询问"如何查询订单物流?"

思考:我需要查询知识库获取订单物流查询方法,然后整理发送。

代码:

``<RUN>

logistics_info = knowledge_base_search(query="订单 物流查询")

print(logistics_info)

``<END_CODE>

观察结果:物流查询方法:1.登录账号 2.进入订单详情 3.查看物流信息

思考:信息已获取,现在整理发送。

代码:

``<RUN>

dingtalk_message = "物流查询方法:\n1.登录账号\n2.进入订单详情\n3.查看物流信息"

dingtalk_robot(message=dingtalk_message)

print("消息已发送")

``<END_CODE>

观察结果:消息已成功发送到钉钉机器人

思考:任务完成,回复用户。

订单物流查询方法已发送给您,请查收钉钉消息。

5.5 钉钉MCP测试:

最后我们可以通过钉钉MCP测试,在智能体中进行询问,可以看到相关信息已经发送到了钉钉机器人中:

-

钉钉机器人搭建:在钉钉开发者后台创建自研应用,添加机器人能力,优选 Stream 长连接模式适配调试;配置消息发送、用户查询、互动卡片等关键权限,完成应用发布后,留存 Client ID、Client Secret 两大核心凭证,用于对接魔搭 MCP。

-

魔搭 MCP 联动配置:在魔搭 MCP 广场录入钉钉凭证创建专属 MCP 工具,再将 MCP 服务器地址、名称填入 ModelEngine Nexent 智能体;连通后可启用私聊 / 群聊发消息、撤回消息等全套钉钉机器人工具,同时优化智能体提示词,打通信息流转逻辑。

落地应用场景与实操逻辑搭建完成后形成标准化应答流程:用户咨询产品购买、会员开通、退货售后、物流查询等业务问题时,智能体先检索知识库抓取对应资料,规整精简信息,再通过钉钉 MCP 工具自动推送消息至指定用户 / 群组;全程实现 AI 问答 + 钉钉消息触达联动。

最终效果完成全流程配置与测试后,可实现企业轻量化智能答疑,把大模型知识库能力无缝融入钉钉办公场景,无需复杂底层开发,就能让业务咨询信息自动同步推送,落地高效便捷的企业 AI 办公助手。

六、总结:

通过本次基于华为 ModelEngine Nexent 零代码平台的智能体能力深度实践可见,ModelEngine(Nexent)凭借零代码、高度自动化的智能体开发模式,大幅降低了 AI 应用的开发门槛。平台将开发者从繁琐复杂的流程编排、提示词工程及底层基础设施搭建中解放出来,使其能够聚焦于业务逻辑设计与核心创新,告别复杂的节点连线,也无需编写胶水代码,开发者仅需用自然语言完整描述任务目标,平台便能自动生成一个具备完整提示词、工具集成与执行逻辑的可用智能体。

对于希望快速验证创意的个人开发者及小型团队而言,该平台显著降低了智能体(Agent)的入门成本:几乎无需编写代码,即可在半小时内快速搭建出集智能问答、工具调用、知识库应用于一体的基础智能体应用,真正实现高效、轻量化的 AI 创新落地。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)