基于零代码平台的订单利润分流数据加工

本实验报告详细介绍了使用助睿ETL软件进行数据处理的完整流程。实验通过MySQL数据库中的订单和产品表,演示了从数据抽取、多表关联、字段清洗到数据分流的ETL全过程。关键步骤包括:使用表输入组件获取数据,通过记录集连接实现表关联,运用字段选择进行数据清洗,最后按利润条件分流输出为盈利/亏损两个Excel文件。实验验证了ETL工具在数据整合、质量管控方面的有效性,展示了如何将原始数据转化为可供分析的

·

一、实验概述

1.1 实验目的

- 掌握助睿 ETL 软件基本操作:新建转换、添加组件、执行转换

- 掌握核心组件使用:表输入、记录集连接、字段选择、过滤记录、表输出

- 能够实现多表关联、数据过滤与分流处理

1.2 实验环境与平台

- 实验平台:助睿数智(Uniplore)数据集成平台

- 平台地址:https://lab.guilian.cn/

- 数据源:MySQL 数据库(business_analysis 库)

- 源表 1:order_detail(订单详情表)

- 源表 2:product(产品信息表)

- 输出形式:Excel 文件(盈利订单表、亏损订单表)

- 核心组件:表输入、记录集连接、字段选择、过滤记录、Excel 输出

1.3 实验流程

数据抽取→多表关联→字段清洗→数据分流→结果加载→数据验证

二、实验原理

2.1 ETL 核心概念

- 抽取(Extract):从业务数据库、文件等源系统获取原始数据,支持全量 / 增量抽取。

- 转换(Transform):对数据进行清洗、去重、格式标准化、关联计算、条件过滤,消除脏数据与异构问题。

- 加载(Load):将规范后的数据写入目标库、文件或数据仓库,供分析与应用使用。

- 总的来说ETL 就是把散落在各处的 “原始数据”,加工成 “干净、统一、能用” 的数据,再放到目标地方的全过程。

2.2 关键技术点

- 多表关联:通过主键 / 外键实现订单表与产品表的左连接,整合业务信息。

- 数据清洗:剔除冗余字段、统一字段格式、处理空值与异常数据。

- 数据分流:按业务规则(利润≥0/<0)将数据拆分为不同输出。

- 可视化流程:零代码拖拽组件,降低 ETL 开发门槛,提升可维护性。

三、实验步骤

3.1 平台登录与项目创建

- 打开实验平台https://lab.guilian.cn/,完成账号登录。

- 新建团队 / 项目,创建转换任务,进入可视化流程设计界面。

- 第一次需创建,后续直接打开

3.2 数据抽取(Extract)

- 拖拽表输入组件,配置 MySQL 连接,选择 business_analysis 库。

- 分别读取 order_detail 与 product 表数据,预览确认数据无误。

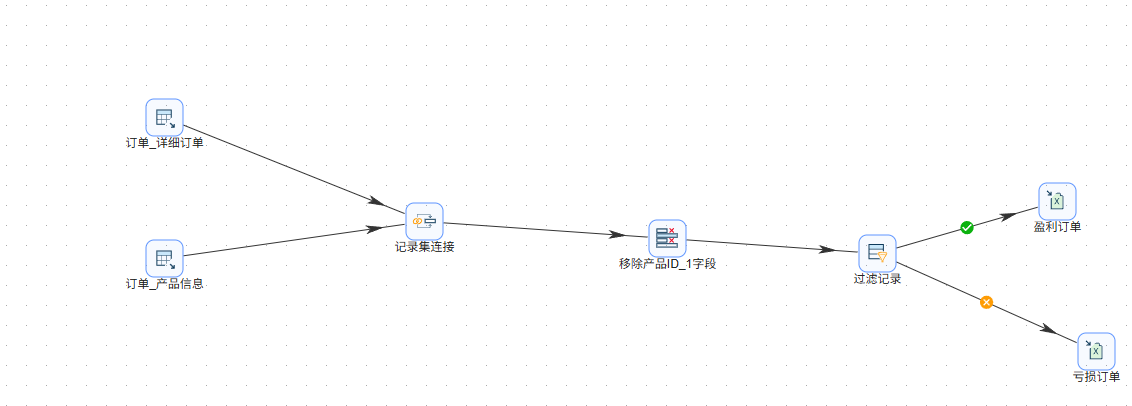

3.3 数据转换(Transform)

- 多表关联:添加记录集连接组件,以 product_id 为关联键,执行左连接,合并订单与产品信息。

- 字段清洗:使用字段选择组件,保留订单编号、产品名称、销量、单价、成本、利润等关键字段,删除冗余 ID 与无用列。

- 数据分流:添加过滤记录组件,设置分流规则:

- 盈利订单:profit ≥ 0

- 亏损订单:profit < 0

3.4 数据加载(Load)

- 拖拽Excel 输出组件,分别连接盈利、亏损分流端口。

- 配置输出路径与文件名,执行转换任务,生成结果文件。

3.5总结

从订单明细表和产品信息表中抽取原始数据,通过记录集连接按产品 ID 进行多表关联合并,再通过字段选择移除重复字段、完成数据清洗;接着通过过滤记录组件按盈利条件将订单分流为两类,最后分别加载输出为盈利订单和亏损订单文件,实现了订单数据从抽取、整合、清洗、分流到落地的全流程自动化处理。

3.6 结果验证

- 打开输出 Excel,检查字段完整性、数据准确性、分流正确性。

- 核对记录总数,确保无丢失、重复、错分数据。

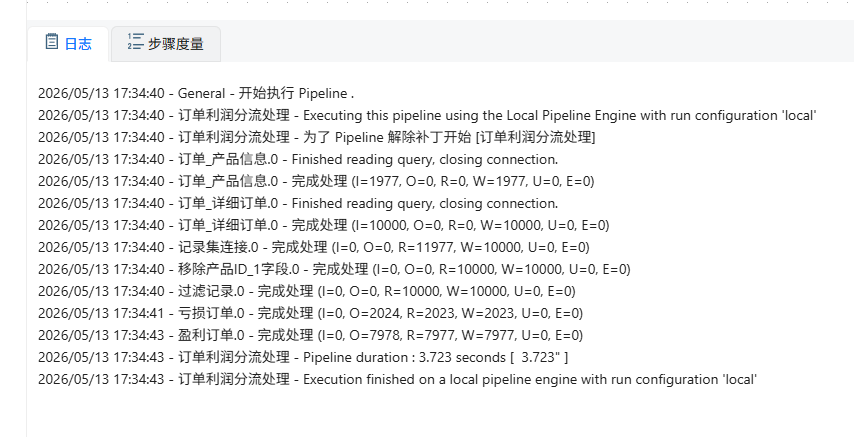

四、实验结果

- 成功完成订单数据与产品数据的 ETL 全流程处理。

- 输出两份标准 Excel 结果表:

- 盈利订单表:包含所有利润≥0 的订单明细

- 亏损订单表:包含所有利润<0 的订单明细

- 数据无缺失、无重复、无异常,字段格式统一,满足业务分析要求。

五、实验总结

本次实验完整复现了企业级 ETL 数据处理流程,从源数据抽取、多表关联、清洗转换到分流加载,覆盖数据工程核心环节。通过可视化工具实操,我深刻理解了 ETL 在数据仓库中的关键作用,掌握了零代码数据集成的基本方法,提升了数据质量管控与业务逻辑实现能力。

ETL 是数据仓库与数据分析的基石,规范的 ETL 流程可有效保障数据准确性、一致性与可用性,为后续报表开发、数据挖掘、经营决策提供可靠支撑。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)