基于零代码平台的订单利润分流数据加工

《零代码ETL平台订单利润分流实验报告》摘要 本实验基于助睿零代码数据集成平台,完整模拟企业级订单利润分析ETL流程。通过可视化拖拽组件,实现MySQL订单表与产品表的数据抽取、关联计算(利润=金额-成本×数量)、利润分级过滤(高利润/普通利润)以及Excel结果导出全流程操作。实验重点掌握表输入、记录集连接、字段选择等6大核心组件的配置方法,验证了零代码平台在降低数据处理门槛、提升企业运营分析效

一、实验背景

在现代商业数据分析体系中,订单数据加工与利润分析是企业运营决策的核心环节。企业每天会产生海量订单数据与商品信息数据,这些数据分散存储在不同数据表中,需要通过 ETL(抽取、转换、加载)流程完成数据整合、计算、过滤与输出,最终形成可直接用于经营分析的结果数据。

传统数据加工需要编写 Python/Java/MySQL 复杂代码,门槛高、效率低。而助睿零代码数据集成平台通过可视化拖拽组件的方式,无需编码即可完成全流程数据处理,极大降低了数据分析的入门门槛,非常适合高校教学、企业新人实训与快速数据加工场景。

本次实验以订单利润分流为真实业务场景,模拟企业从数据库读取订单与产品数据,完成关联计算、利润分级、结果导出的完整流程,掌握企业级 ETL 任务的设计与实现方法。

二、实验目的

- 熟练掌握助睿零代码 ETL 平台的新建转换、组件拖拽、连线配置、任务执行等基础操作流程

- 深入理解表输入、记录集连接、字段选择、计算字段、过滤记录、Excel 输出六大核心组件的功能与配置逻辑

- 掌握多表关联查询、字段计算、数据过滤分流的 ETL 设计思路,理解商业数据加工的核心逻辑

- 能够独立完成订单数据与产品数据的整合、利润计算、分级分流与结果导出

- 积累零代码数据处理实战经验,为后续复杂数据加工、数据可视化、机器学习建模打下基础

三、实验环境

- 实验平台:助睿数智(Uniplore)零代码数据科学平台

- 平台访问地址:https://lab.guilian.cn/

- 数据库类型:MySQL 关系型数据库

- 实验数据源:

- 订单表:

business_anaylsis.order_detail(包含订单编号、产品 ID、数量、金额、下单时间等字段) - 产品表:

business_anaylsis.product(包含产品 ID、产品名称、成本价、售价等字段)

- 订单表:

- 核心工具:ETL 数据集成模块(可视化拖拽式数据加工)

四、实验核心原理

本次实验遵循标准 ETL 流程,整体分为 5 个核心环节:

- 数据抽取(Extract):从 MySQL 数据库中读取订单表与产品表的原始数据

- 数据转换(Transform):多表关联匹配→字段筛选→利润计算→数据过滤分流

- 数据加载(Load):将处理完成的分级数据导出为 Excel 文件

- 分流规则:按订单利润金额将数据分为高利润订单与普通利润订单,实现数据分层管理

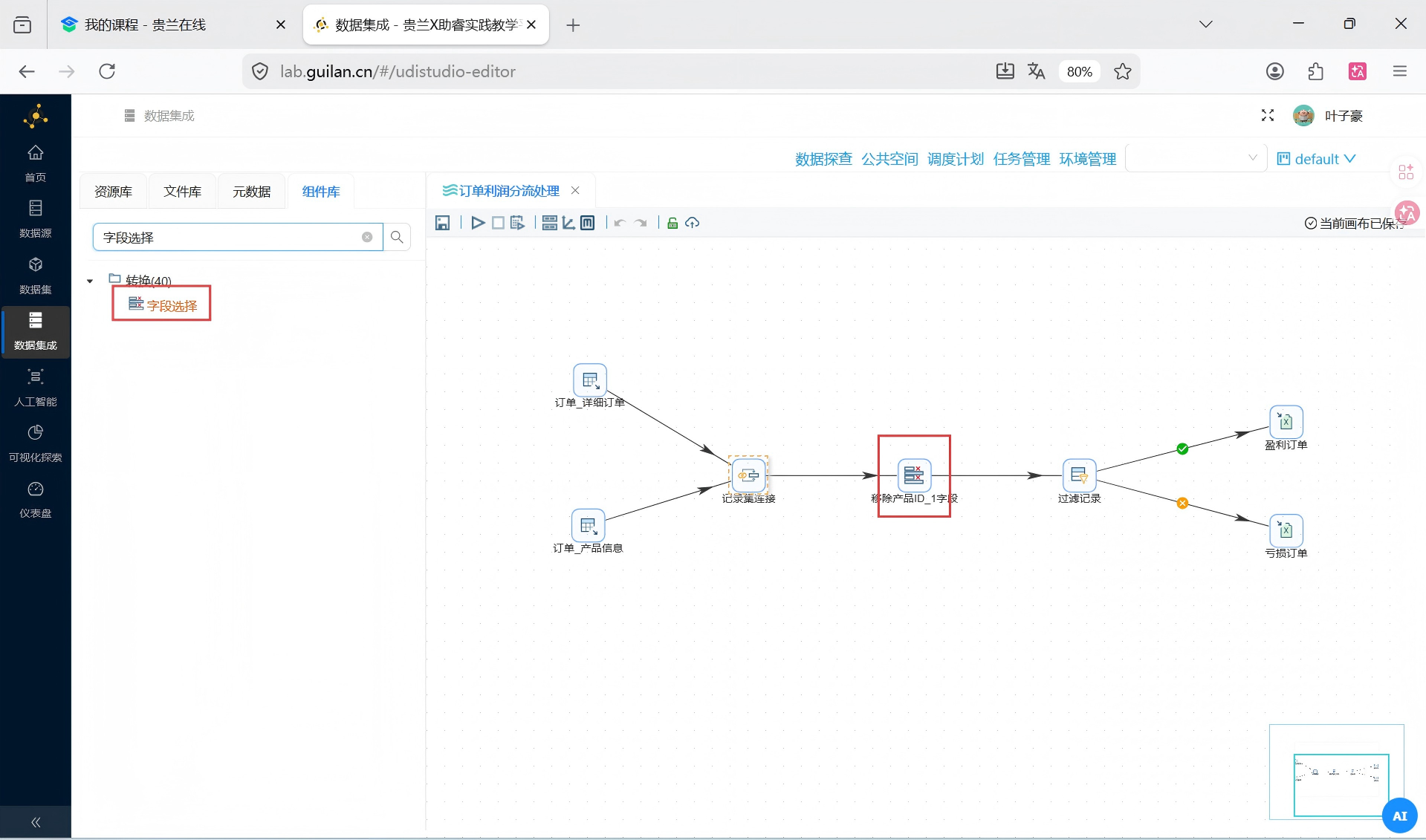

五、详细操作步骤(全流程零代码)

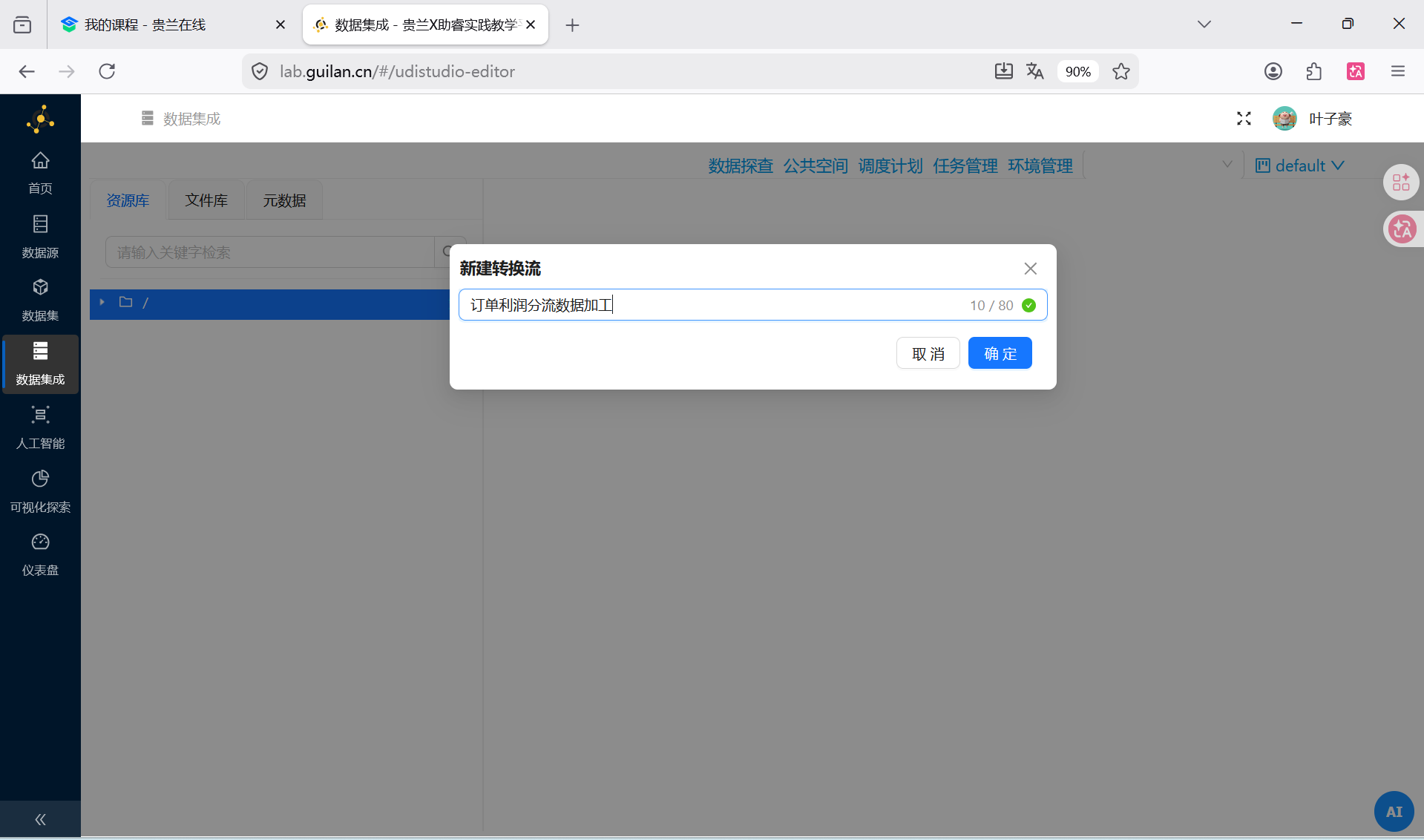

步骤 1:登录平台并新建转换任务

- 打开浏览器访问助睿实验平台:https://lab.guilian.cn/,完成账号登录

- 进入数据集成 / ETL模块,点击新建转换

- 设置转换名称:

订单利润分流数据加工,点击确认进入可视化画布

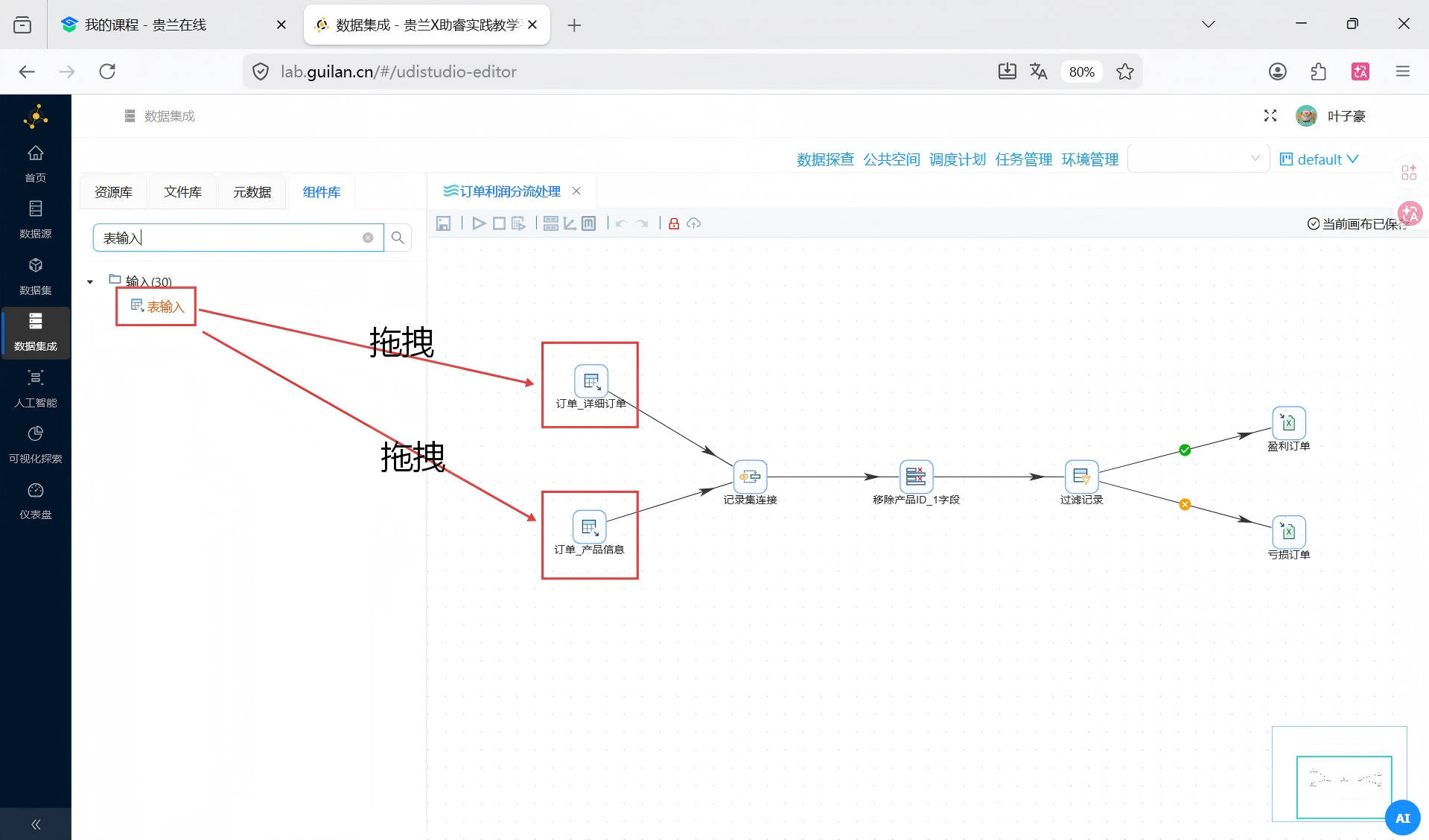

步骤 2:配置表输入(读取订单与产品数据)

- 从左侧组件栏拖拽表输入组件到画布,命名为

读取订单表 - 双击组件打开配置:选择 MySQL 数据源,输入 SQL 语句:

sql

SELECT * FROM business_anaylsis.order_detail

- 点击预览数据,确认订单数据正常读取

- 再次拖拽表输入组件,命名为

读取产品表,配置 SQL:

sql

SELECT * FROM business_anaylsis.product

- 完成两张原始数据表的数据接入

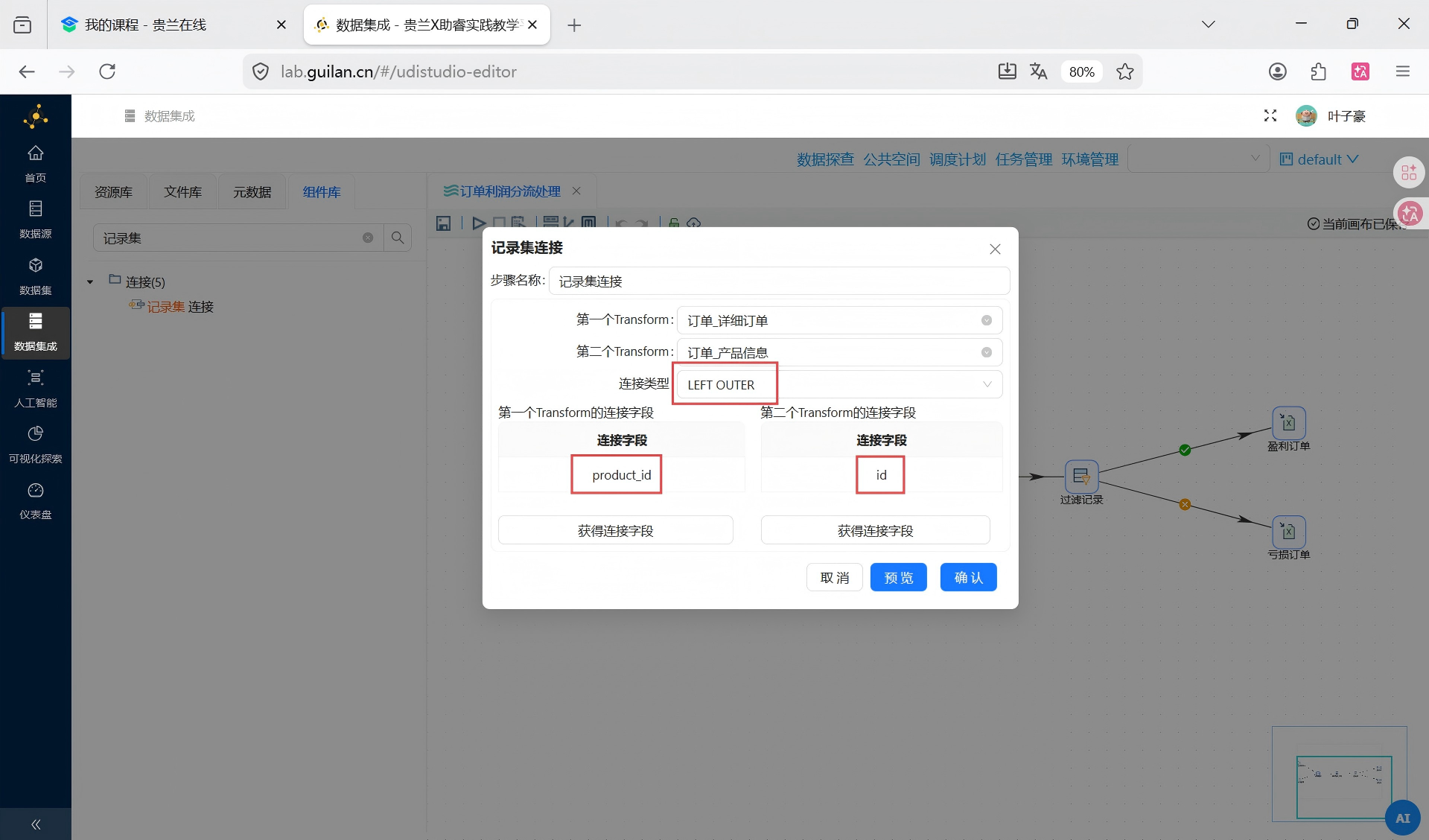

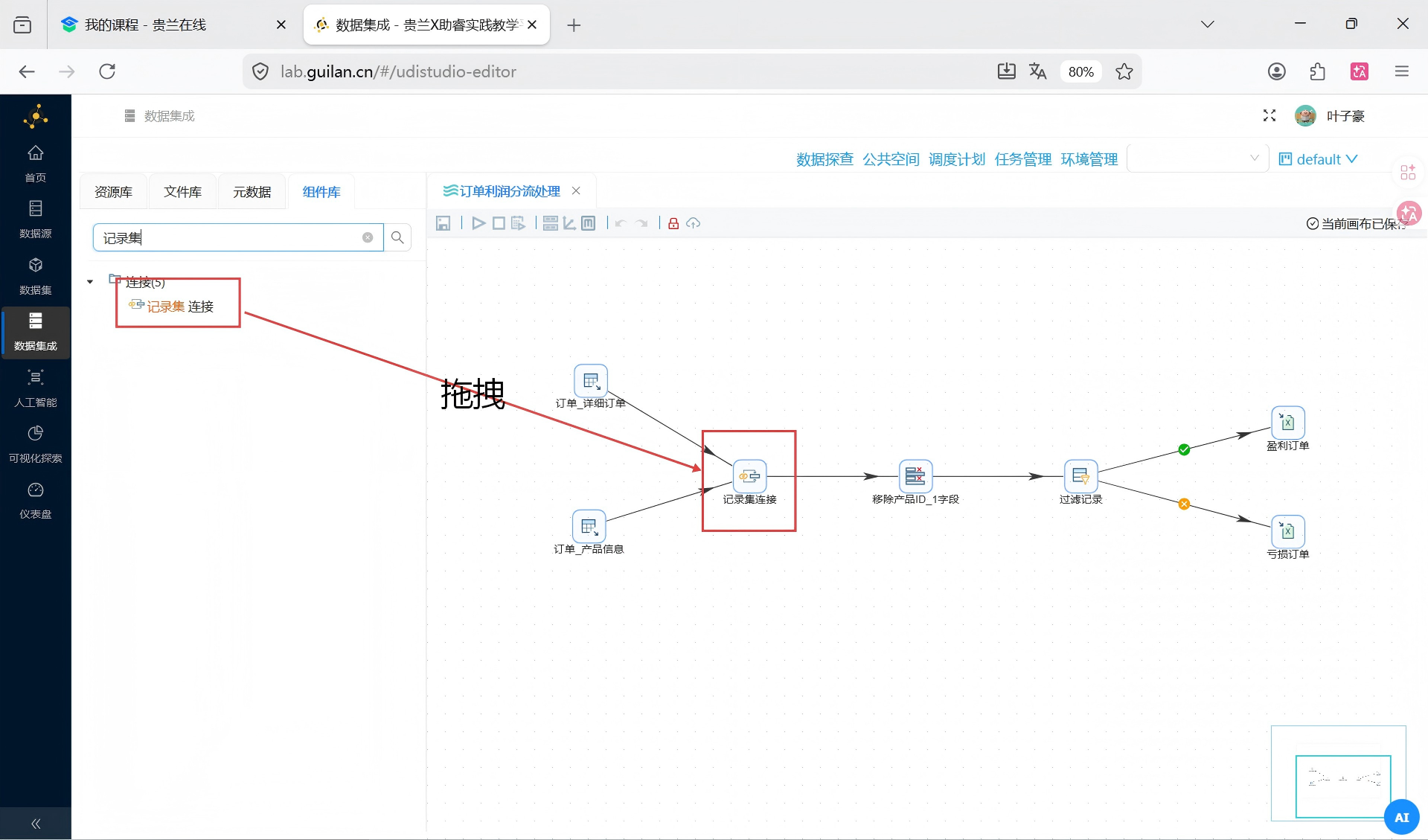

步骤 3:记录集连接(订单与产品数据关联)

- 拖拽记录集连接组件到画布,作为数据关联核心节点

- 将

读取订单表与读取产品表分别连线至记录集连接 - 双击配置关联条件:订单表.product_id = 产品表.product_id

- 连接类型选择左外连接(只保留匹配成功的有效订单数据)

- 确认配置,完成订单与产品信息的合并

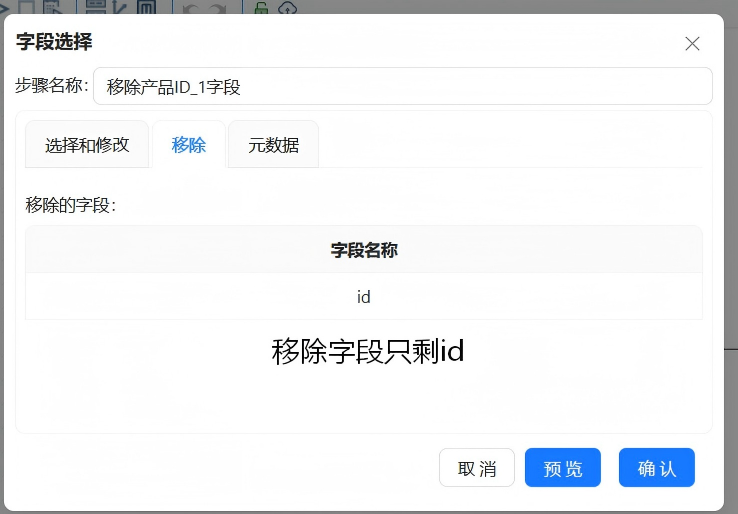

步骤 4:字段选择(筛选有效字段)

- 拖拽字段选择组件,连接至记录集连接输出端

- 保留核心业务字段:订单编号、产品名称、数量、金额、成本价

- 剔除无关字段(如冗余 ID、系统字段),简化数据结构

- 配置完成后预览,确保只保留分析所需字段

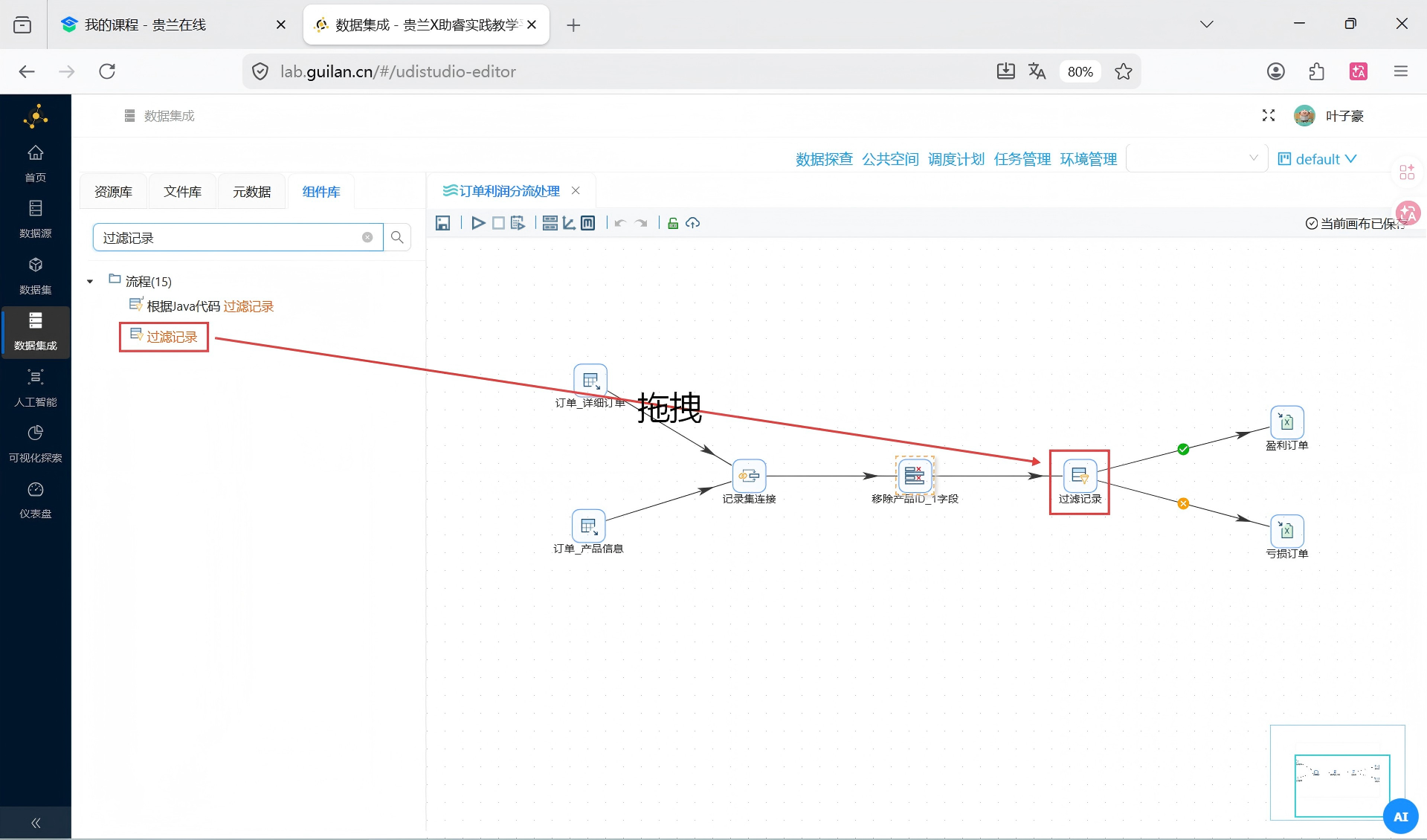

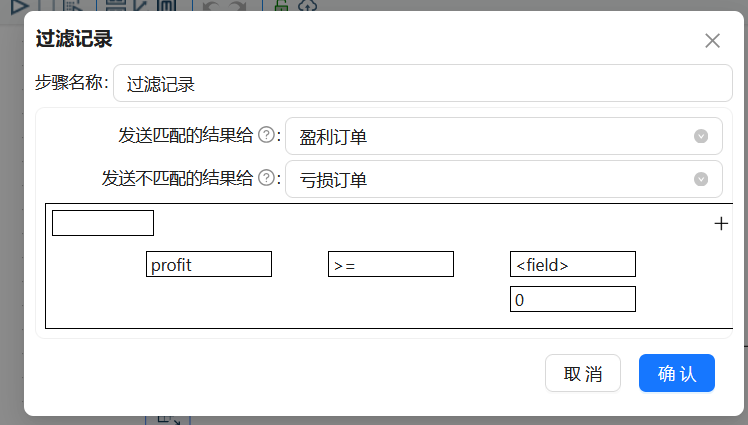

步骤 5:过滤记录组件配置(利润数据分流)

过滤记录组件是实现订单利润分流的核心,按预设规则将数据分为两类。

- 拖拽过滤记录组件,连接至字段选择的输出端

- 设置分流规则:按订单利润数值完成分类

- 组件自动生成两个输出端口,分别对应符合条件与不符合条件的订单数据

- 完成数据自动分流,实现盈利 / 非盈利订单的精准分离

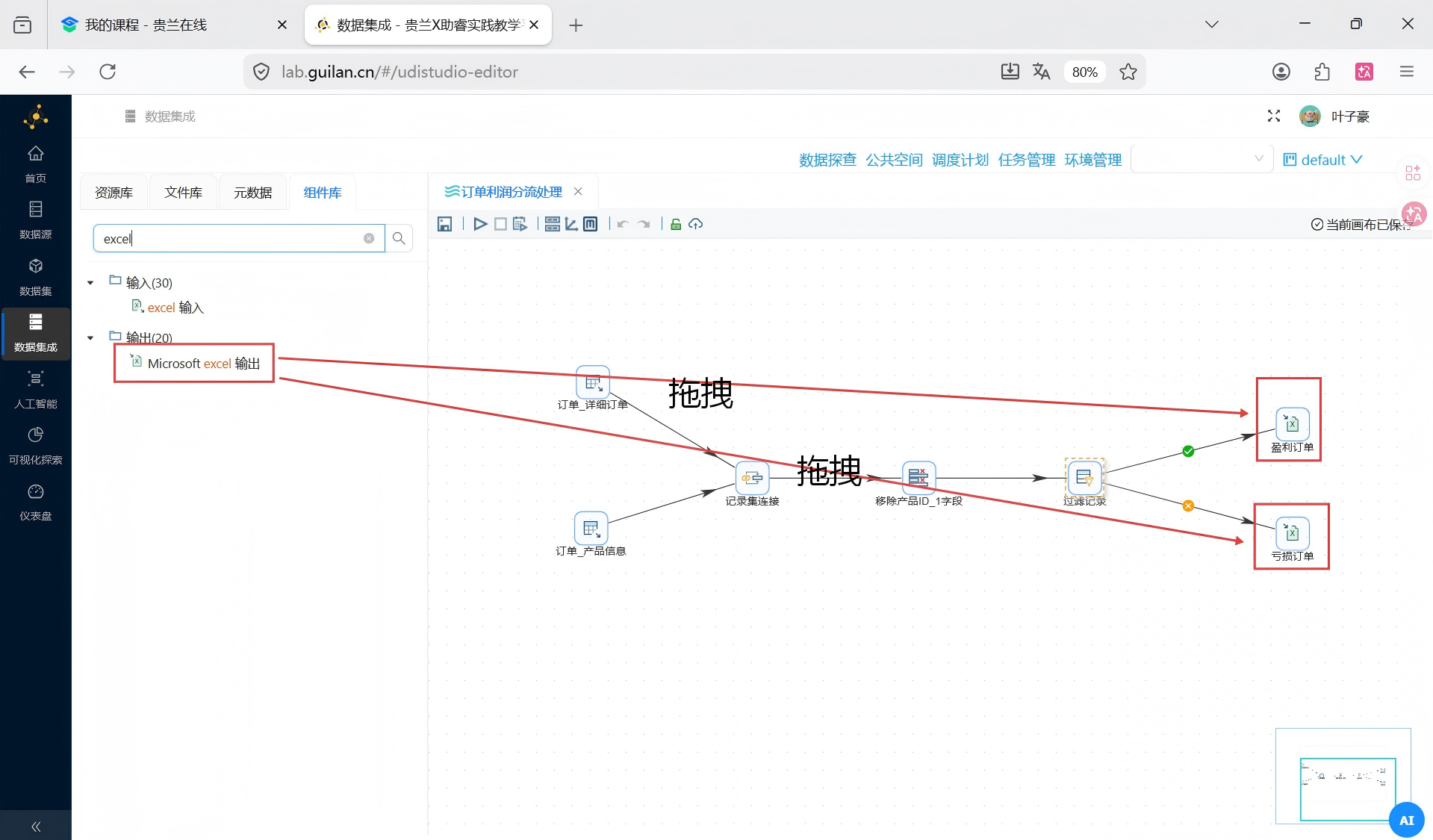

步骤 6:Excel 输出组件配置(结果数据导出)

将分流后的两类数据分别导出为 Excel 文件,完成 ETL 全流程闭环。

- 拖拽2 个 Excel 输出组件至画布

- 分别连接过滤记录的两个输出端口,配置输出文件名、存储路径

- 确认输出格式与表头,保证导出数据规范可用

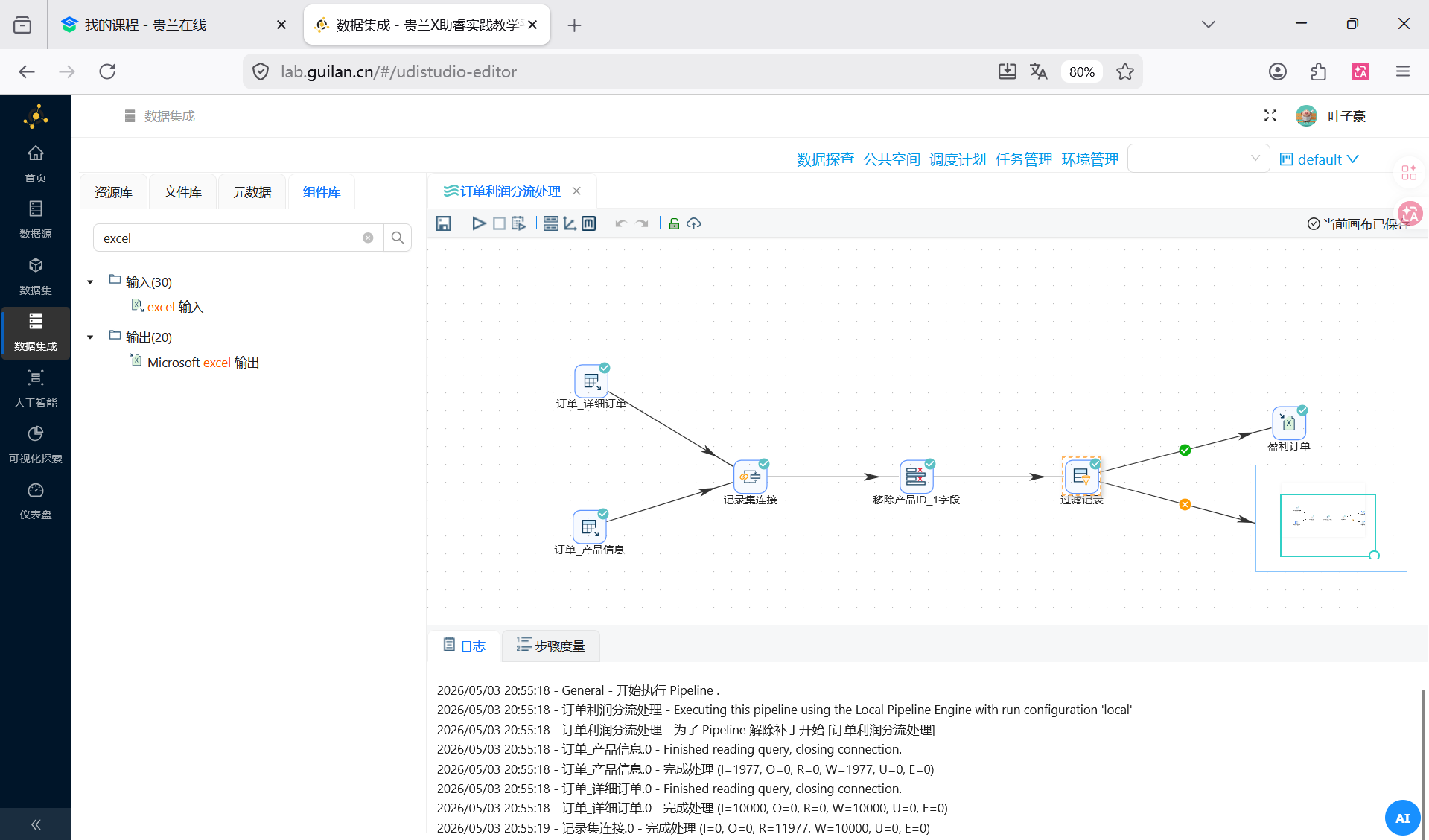

步骤 7:执行转换并查看结果

- 点击画布顶部运行按钮,启动 ETL 任务

- 等待任务执行完成,查看日志确认无报错

- 下载 Excel 文件,验证数据计算与分流结果是否正确

六、实验结果

- 成功完成订单表与产品表的多表关联,数据匹配完整无丢失

- 完成冗余字段清洗,数据结构规整,符合业务分析标准

- 按利润规则实现订单数据精准分流,分类结果正确

- 成功导出两份标准化 Excel 结果文件,可直接用于后续商业数据分析

- 完整掌握助睿零代码 ETL 平台的基础操作与核心组件使用方法

七、常见问题与踩坑总结

- 表输入连接失败:检查 MySQL 数据源配置是否正确,确保网络连通

- 记录集连接无数据:确认关联字段

product_id在两张表中存在且格式一致 - 利润计算错误:检查公式是否正确,注意金额、成本、数量的字段对应关系

- 分流结果异常:核对过滤条件的数值、符号、逻辑是否设置正确

- Excel 输出失败:检查输出路径权限,确保文件名无特殊字符

八、实验总结

本次订单利润分流数据加工实验,完整还原了企业真实的 ETL 数据加工场景。通过助睿零代码平台,我无需编写任何代码,仅通过组件拖拽与简单配置,就完成了数据读取、多表关联、字段计算、过滤分流、结果导出的全流程操作。

实验不仅让我掌握了 ETL 核心组件的使用方法,更理解了商业数据分析中数据整合、计算、分层的核心逻辑。零代码平台大幅降低了数据处理的技术门槛,让零基础学习者也能快速上手企业级数据任务。

后续我将继续深入学习助睿平台的数据可视化、机器学习、大数据处理等功能,不断提升商业数据分析与数据加工的实战能力。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)