助睿实验作业1-订单利润分流数据加工

本文介绍了在助睿数智Uniplore平台上进行的订单利润分流数据加工实验。实验通过零代码ETL操作,使用表输入、记录集连接等核心组件,完成订单与产品数据关联、字段清洗及利润正负分流处理。主要步骤包括:创建转换流、添加并配置ETL组件(表输入、记录集连接、字段选择、过滤记录和Excel输出)、执行转换流并验证结果。实验成功实现了数据整合与分流,输出盈利和亏损两类订单文件。平台可视化操作降低了大数据处

助睿实验作业1-订单利润分流数据加工

一、实验背景

1.1 实验目的

本次实验依托零代码ETL实操,掌握助睿数智Uniplore数据集成平台基础操作,熟练运用表输入、记录集连接、字段选择、过滤记录、Excel输出核心组件,完成订单与产品数据关联、字段清洗、利润正负分流及分类导出,理解ETL数据加工核心逻辑,夯实大数据零代码实操基础。

1.2 实验环境

本次实验全程依托助睿数智(Uniplore)一站式数据科学实验平台完成,该平台是覆盖数据接入、ETL数据集成处理、机器学习建模到可视化分析的全链路Agentic零代码数据智能平台,无需代码编程,仅通过可视化拖拽即可完成全流程数据处理工作。平台产品官方官网地址:https://www.uniplore.com/,本次实验专属实操登录地址:https://lab.guilian.cn/。实验配套数据库采用MySQL数据库,内置本次实验所需核心业务数据,核心数据准备包含两大业务数据表,分别为订单明细表business_anaylsis.order_detail、产品信息表business_anaylsis.product,所有原始数据均已同步至平台线上公共只读数据源,可直接调用无需额外数据预处理。

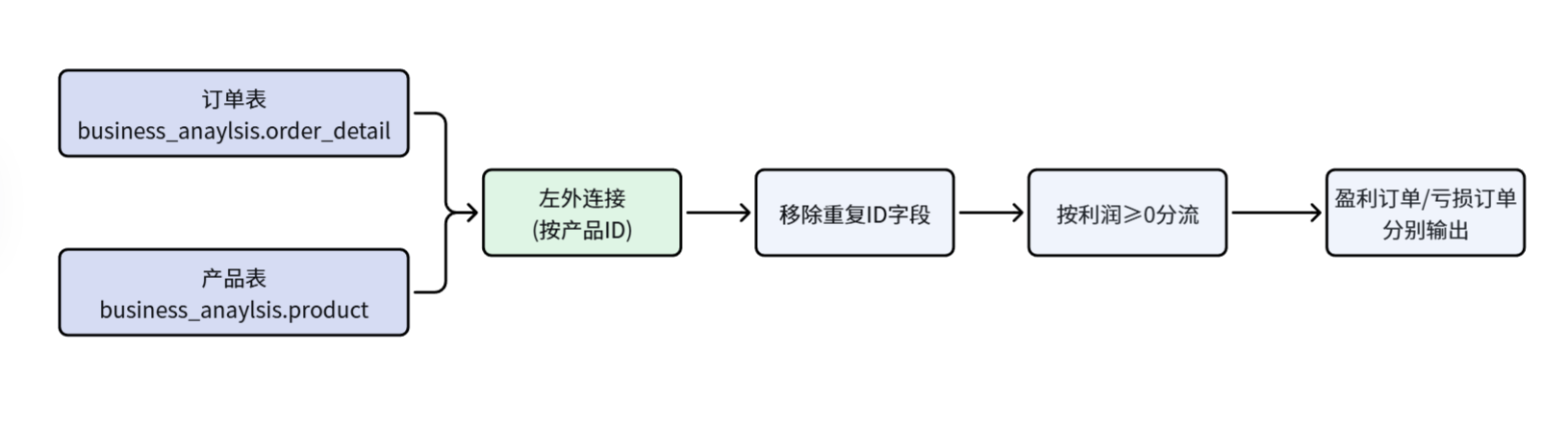

1.3 处理流程

表输入抽取两张原始数据表→记录集连接左外关联数据→字段选择清理重复ID→过滤记录按利润≥0分流→Excel分别导出盈利、亏损两类订单文件。

二、实验步骤

2.1 实验核心基础概念了解

实验正式实操前,首先系统学习助睿数智数据集成ETL平台核心专业基础概念,明确各核心功能单元的定义、作用及应用场景,区分转换与作业的核心差异,为后续拖拽搭建转换流、配置组件操作奠定理论基础,核心概念明细及说明如下表所示:

|

核心概念 |

详细说明 |

|

Pipeline(转换) |

面向数据流通处理的核心功能单元,主要用于承载完整的数据ETL加工处理流程,由多个不同功能的Transform步骤组合构成,聚焦数据本身的加工转换操作。 |

|

Workflow(作业) |

面向整体任务执行调度的管理单元,用于完成一项完整的实验或业务任务,由多个不同类型的Action任务项组成,作业流程配置必须包含开始执行项,侧重任务整体调度管控。 |

|

Transform(步骤) |

转换流程内部的最小独立操作单元,平台内所有数据处理操作均以步骤形式呈现,常见包括表输入、Excel输入、字段选择、过滤记录等,每个Transform步骤均可独立开启线程运行,单独配置参数。 |

|

Action(任务项) |

作业Workflow的基础执行单位,主要用于任务调度辅助操作,常见包括流程启动、任务停止、执行成功后发送邮件通知等辅助功能性操作,不直接参与数据加工处理。 |

|

Hops(节点连接) |

转换流程内各步骤、作业流程内各任务项之间的数据传输与流程连接通道,用于串联各个操作组件,确定数据流转方向和任务执行先后顺序。 |

同时明确两类核心工作流核心区别,转换工作流核心用于纯数据加工处理,适配本次订单数据关联分流实验场景;作业工作流核心用于多任务组合调度,适配复杂多步骤批量执行场景,本次实验仅使用转换工作流即可完成全部操作。

2.2 团队管理创建与实验数据源同步

操作说明:完成实验前置团队配置,创建实验小组专属团队并了解平台核心功能菜单,同步本次实验所需MySQL公共业务数据源,为后续新建转换流、添加组件配置数据做好前置准备。

配置要点:首先登录助睿数智实验实操平台,点击进入数据集成/ETL功能模块,进入数据集成核心操作页面;点击页面左侧“团队管理”菜单栏,选择“新增团队”按钮,在弹出的创建窗口中填写对应小组团队名称及团队简单描述,确认信息无误后点击“确认”完成团队创建;创建成功后,点击团队卡片右上角“更多”选项,选择“添加成员”,完成小组成员批量邀请加入,便于后续团队实验作业统一管理。

随后熟悉平台左侧三大核心菜单功能,资源库主要用于工作流新建、修改、删除、调度管理;文件库用于存储工作流运行所需文件及实验输出结果文件;元数据管理用于数据库、运行配置等基础参数设置,本次实验重点使用资源库和文件库。最后点击“元数据”菜单,右键点击根目录下“关系数据库”选项,选择“同步数据源”,同步完成后交替切换文件库与元数据页面,刷新确认线上公共数据源(Readonly)同步成功,数据源加载正常可正常调用数据表。

2.3 新建订单利润分流专属转换流

|

组件名称 |

组件核心作用 |

|

表输入 (订单 / 产品) |

读取 MySQL 数据库中的订单明细表和产品信息原始业务数据,为后续数据加工提供基础数据源。 |

|

记录集连接 |

以产品 ID 为关联关键字段,对订单数据表和产品信息数据表进行左外连接,实现两张业务数据表的数据整合关联。 |

|

字段选择 |

清理两表关联后产生的重复冗余 ID 字段,仅保留核心有效业务字段,保证数据集整洁规范。 |

|

过滤记录 |

按照订单利润正负数值设置筛选条件,将整合后的数据自动分流为盈利订单数据和亏损订单数据两类。 |

|

Excel 输出 |

将过滤分流后的盈利订单、亏损订单两类数据,分别单独导出为独立 Excel 文件,完成实验结果落地输出。 |

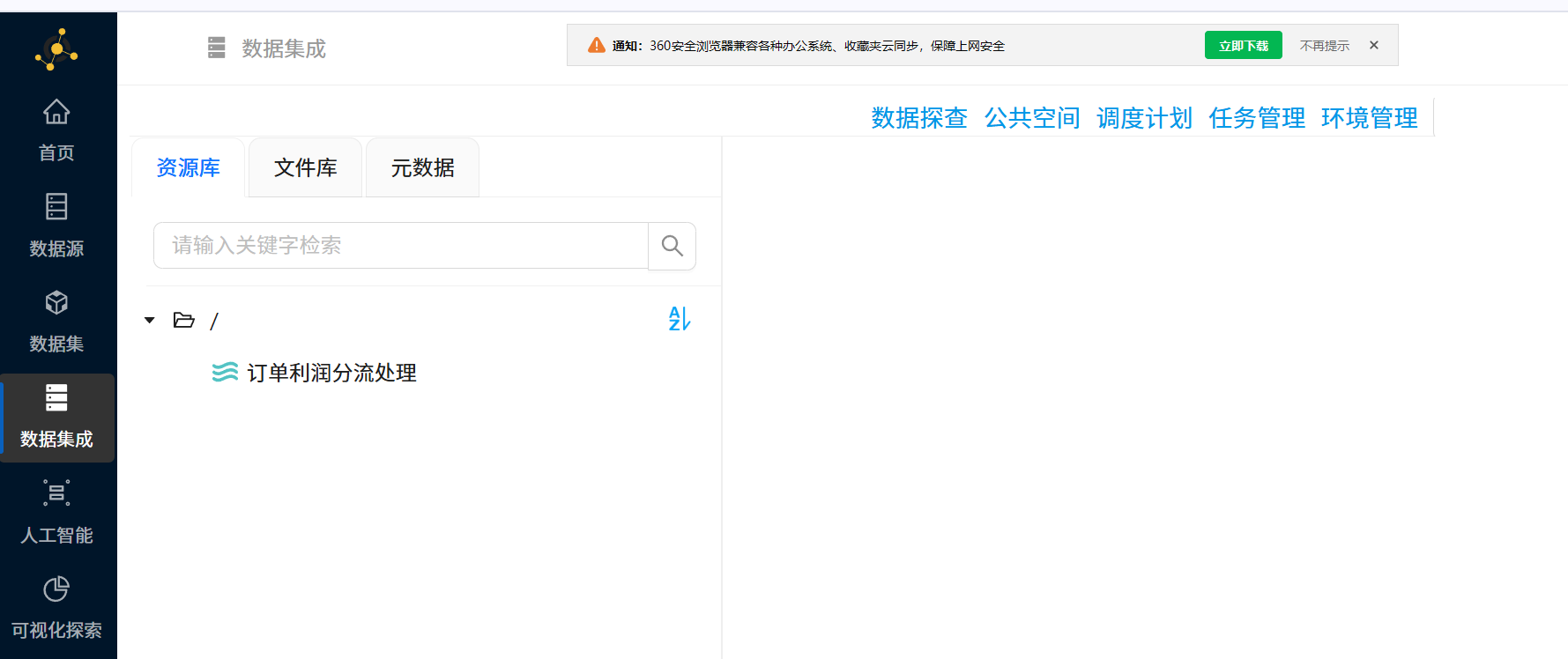

操作说明:在平台资源库根目录下新建专属数据转换流,命名为订单利润分流处理,解锁转换流编辑权限,为后续添加各类ETL操作组件、搭建数据处理流程做好基础准备。

配置要点:切换平台页面至资源库菜单,右键点击资源库根目录空白位置,选择“新建转换流”操作选项;在弹出的转换流命名窗口中,准确输入转换流名称“订单利润分流处理”,点击确定完成转换流创建;默认新建的转换流处于锁定保护状态,无法直接拖拽编辑组件,需点击编辑页面上方��锁定图标,解锁转换流编辑权限,解锁后画布可正常添加、拖拽、配置各类ETL实操组件。

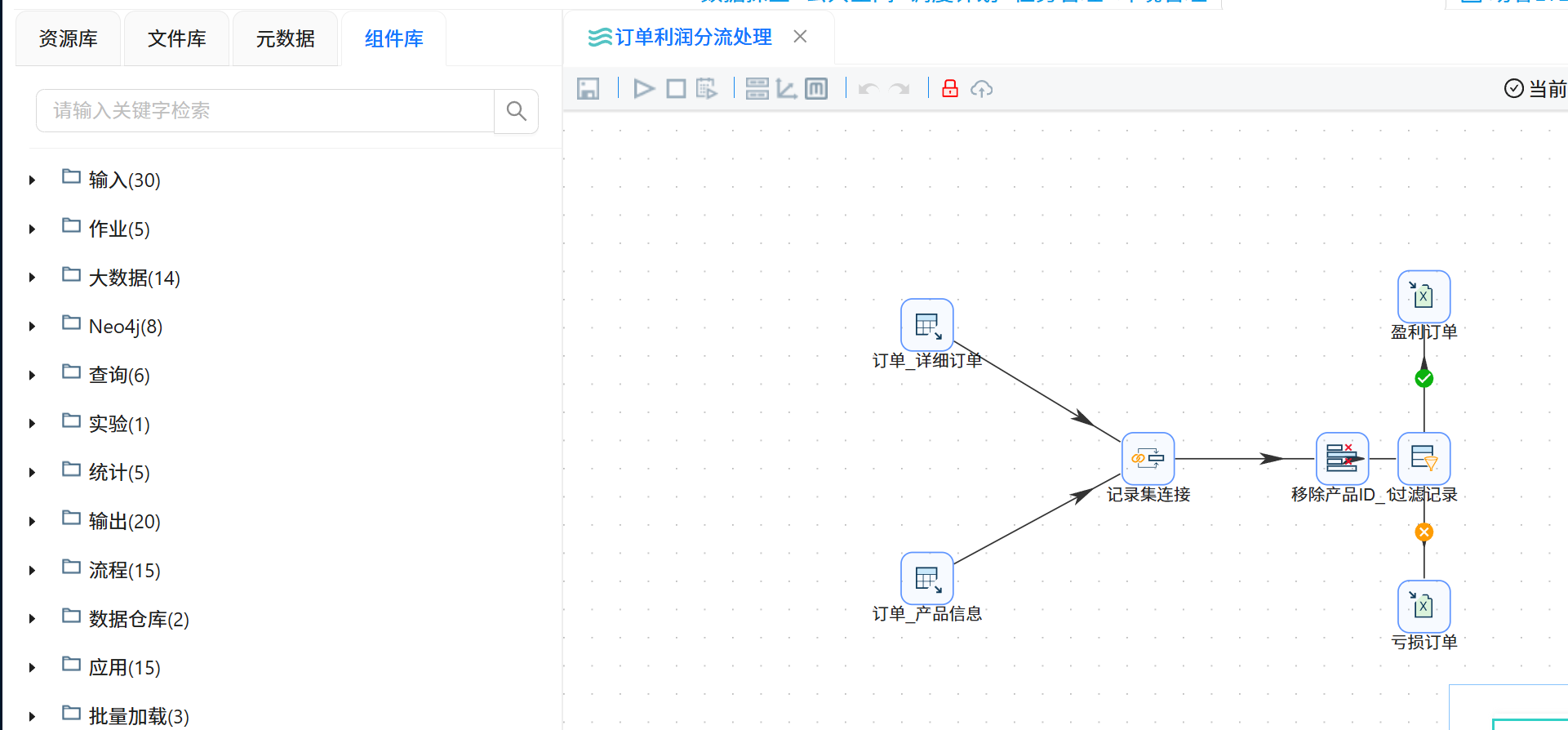

2.4 全流程ETL核心组件添加与重命名

操作说明:按照订单数据加工整体逻辑,依次在转换流画布中拖拽添加表输入、记录集连接、字段选择、过滤记录、Excel输出五大类核心组件,并重命名各组件,明确每个组件实操用途,规范数据流转节点。

配置要点:一是添加两个表输入组件,在组件库搜索框输入“表输入”,拖拽两个相同组件至画布空白处,分别右键编辑组件,重命名为“订单_详细订单”和“订单_产品信息”,用于分别读取两类原始业务数据表;二是添加记录集连接组件,搜索“记录集连接”并拖拽至画布,用于后续两张数据表关联整合;三是添加字段选择组件,搜索“字段选择”拖拽后重命名为“移除产品ID_1字段”,用于清理重复冗余字段;四是添加过滤记录组件,搜索“过滤记录”拖拽至画布,用于按利润正负实现订单数据分流;五是添加两个Excel输出组件,搜索“excel输出”拖拽后分别重命名为“盈利订单”和“亏损订单”,用于分流后两类数据单独导出保存。所有组件添加完成后,初步按数据流转顺序排布在画布中,便于后续连接线路和参数配置。

2.5 各ETL核心组件参数精细化配置

操作说明:依次对所有添加完成的组件进行参数配置、数据关联、条件设置和输出路径配置,搭建完整数据流转链路,确保数据抽取、关联、清洗、分流、输出全流程正常执行。

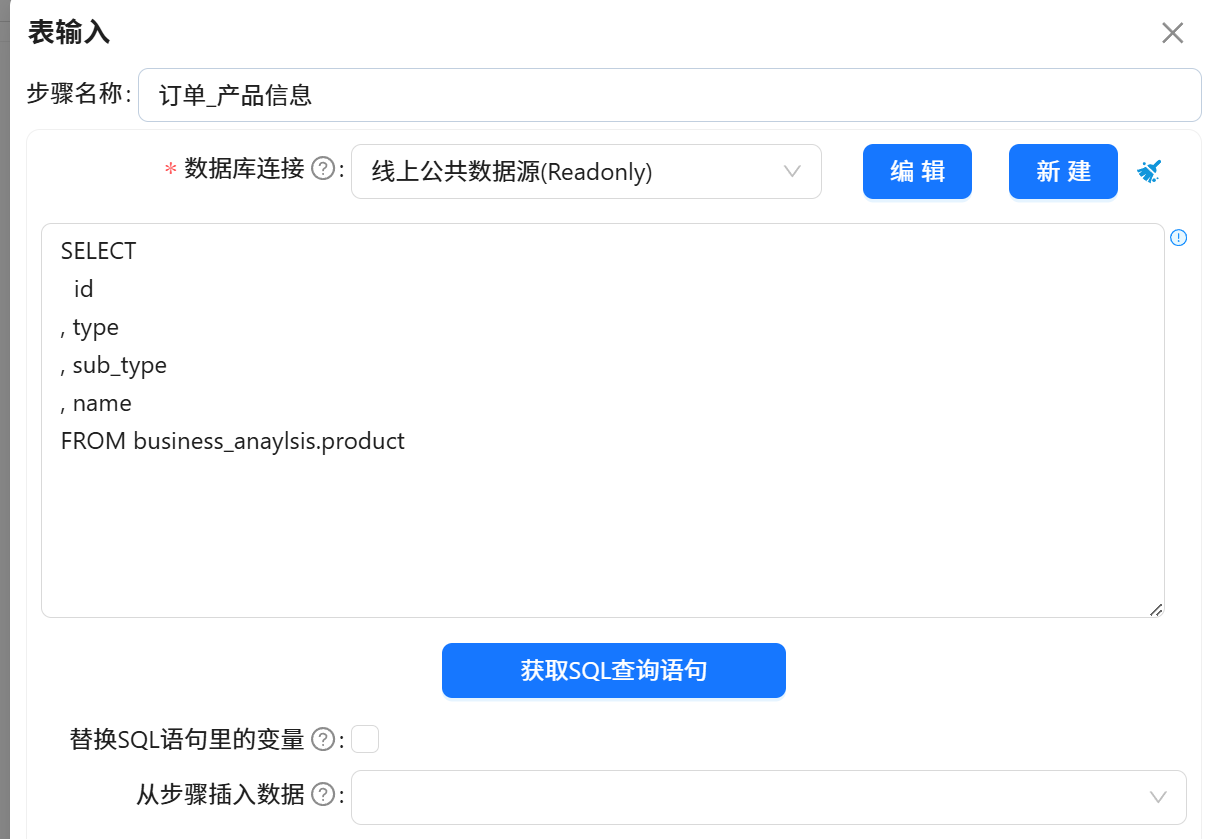

配置要点:第一,表输入组件配置,分别双击两个表输入组件,点击“获取SQL查询语句”,在线上公共数据源(Readonly)数据表目录中,分别选中business_anaylsis.order_detail订单明细表和business_anaylsis.product产品信息表,确认自动生成SQL查询语句,无需手动修改,点击确认完成数据读取配置;

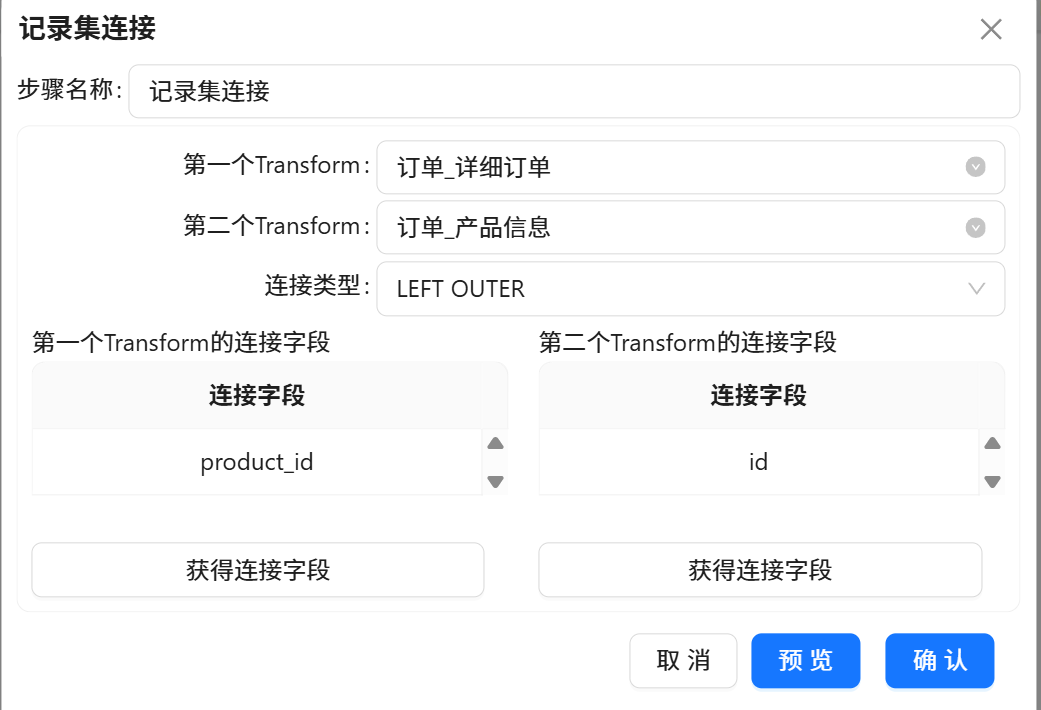

第二,记录集连接组件配置,双击该组件,第一个Transform选择订单_详细订单,第二个Transform选择订单_产品信息,连接类型设置为LEFT OUTER左外连接,分别点击获取两个Transform的连接字段,保留产品ID关联字段,删除多余重复标识字段;

第三,字段选择组件配置,进入配置页面删除重复的id冗余字段,仅保留唯一产品关联ID及核心业务数据字段,确认字段清理完成;

第四,过滤记录组件配置,以利润字段为核心判断依据,设置过滤条件为利润≥0,满足条件为盈利订单走True输出,不满足条件为亏损订单走False输出;

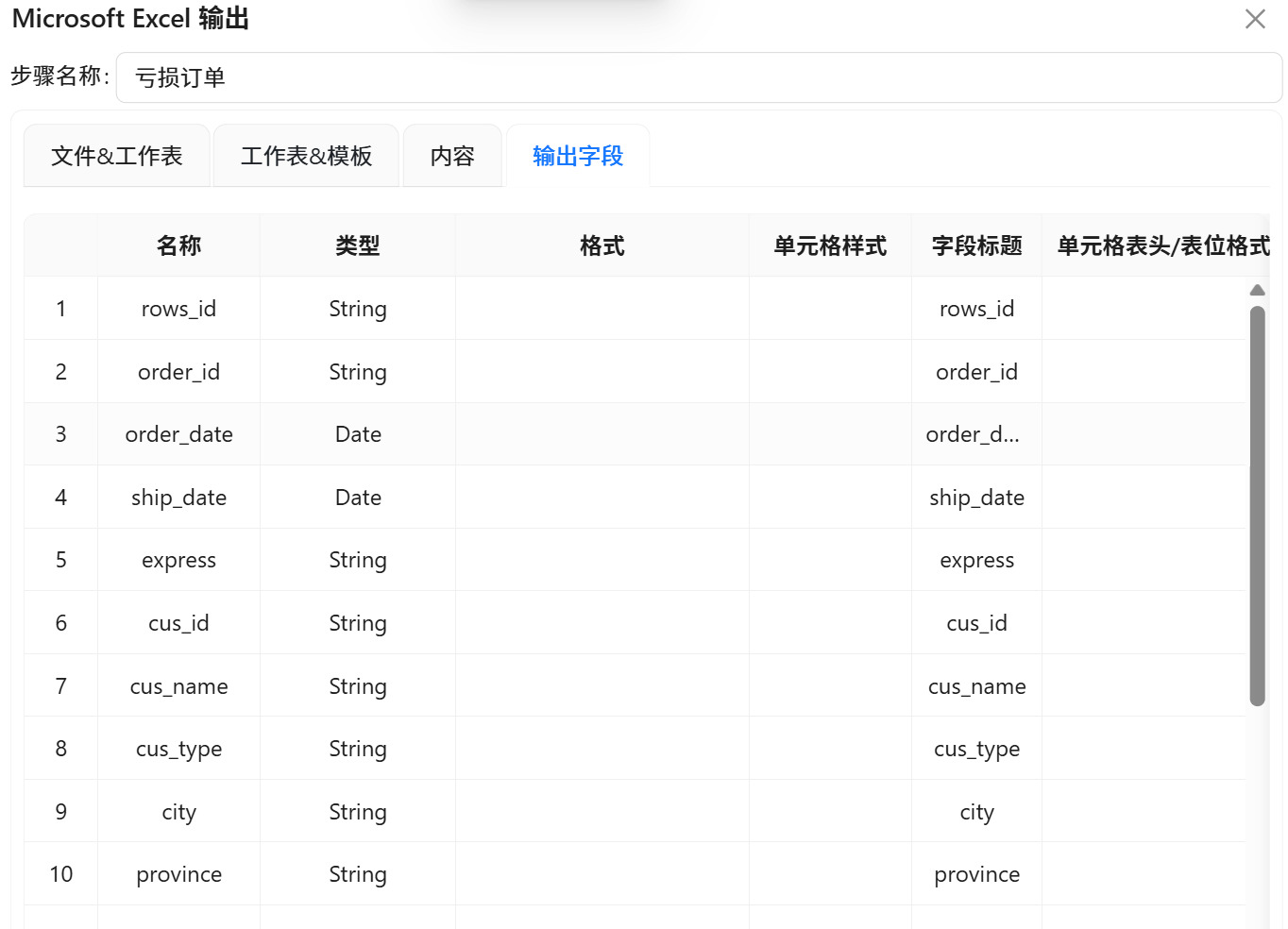

第五,Excel输出组件配置,分别双击两个Excel输出组件,文件名对应修改为“盈利订单”和“亏损订单”,文件格式选择xlsx适配高版本Excel,其他参数保持默认配置。所有组件配置完成后,按数据流向依次创建各组件连接线,对应匹配True/False输出链路。

2.6 执行转换流并查看下载实验输出结果

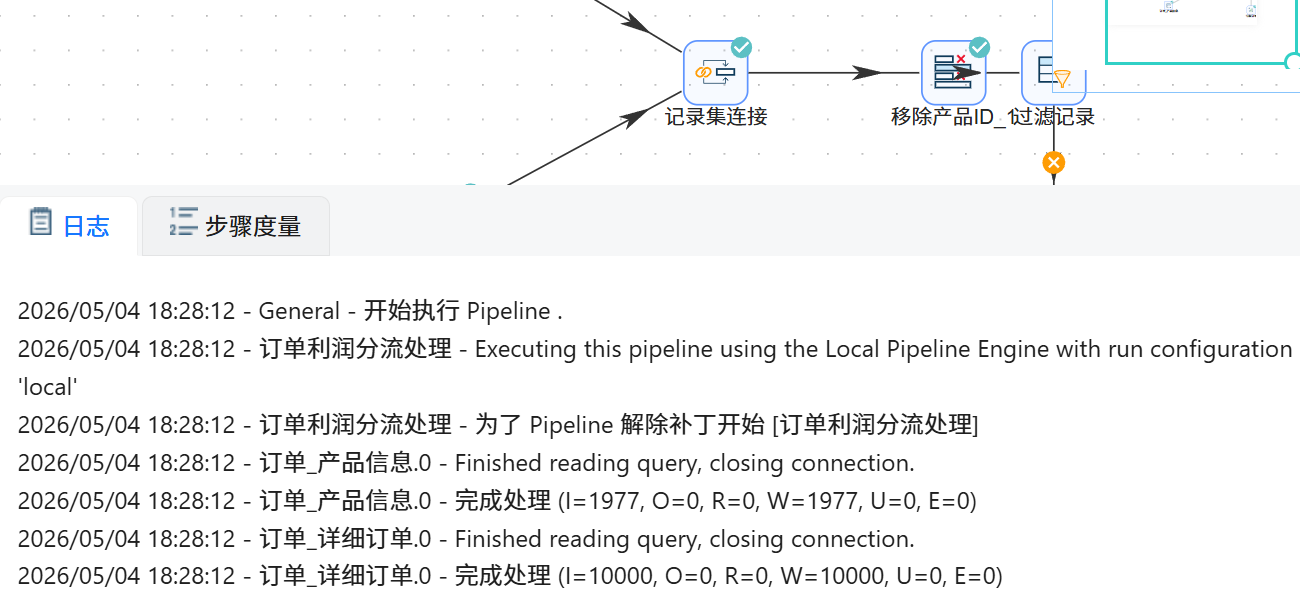

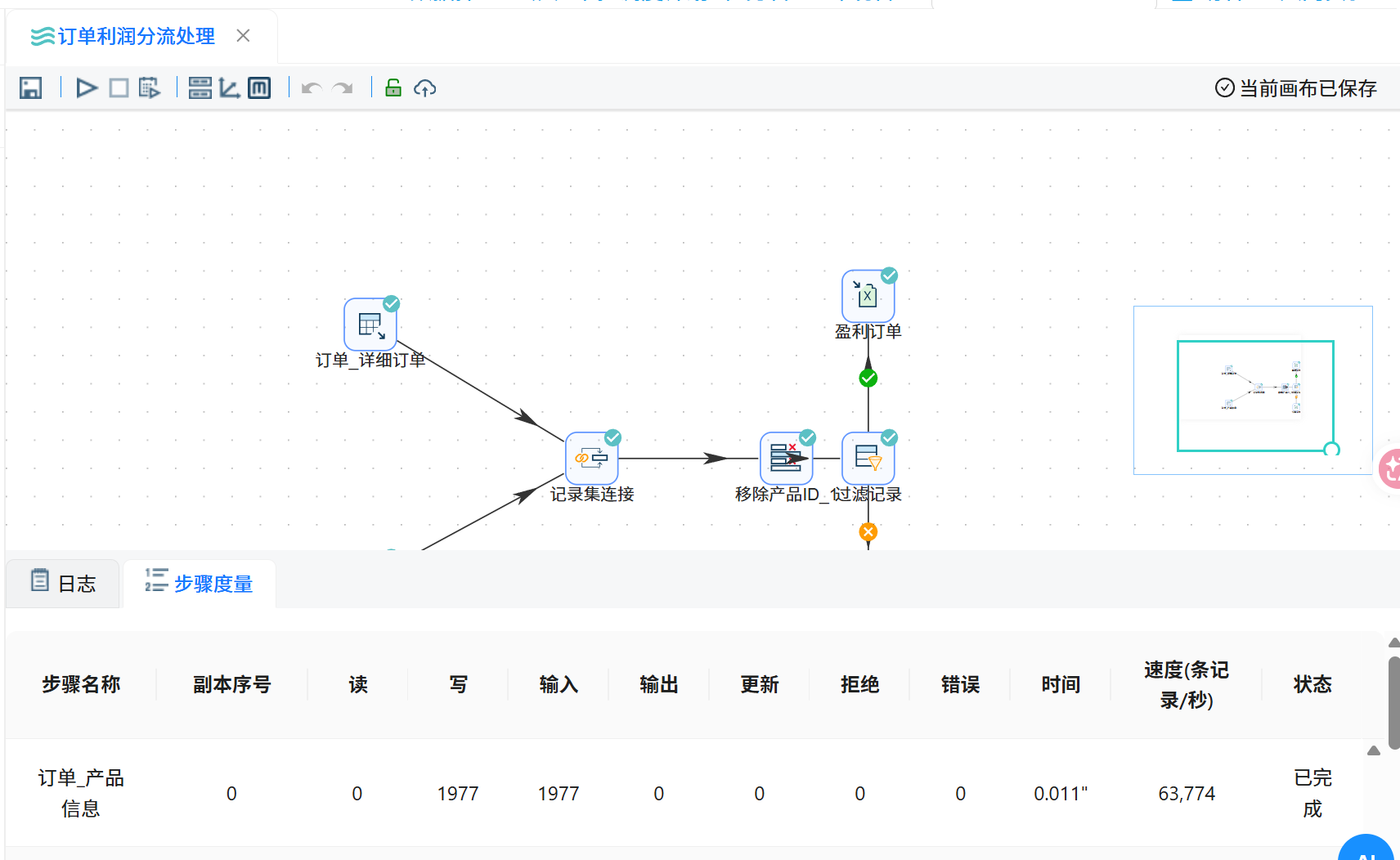

操作说明:运行已配置完成的订单利润分流处理转换流,执行全流程数据加工操作,运行结束后进入文件库查看并下载两类输出Excel结果文件,验证实验加工成果。

配置要点:返回转换流编辑页面,点击执行运行按钮,启动转换流任务,等待系统自动完成数据抽取、关联、清洗、分流、输出全流程处理,待任务执行成功无报错后;点击平台文件库菜单,右键点击根目录刷新页面,即可看到生成的盈利订单、亏损订单两个Excel结果文件,右键分别下载文件至本地电脑,便于后续结果核对与分析验证。

三、实验结果

本次助睿数智订单利润分流数据加工实验执行完成后,平台文件库成功生成并输出两个独立的Excel格式结果文件,分别为盈利订单.xlsx和亏损订单.xlsx,文件生成无报错、数据输出完整无缺失,成功实现了预设的订单数据关联整合与利润正负条件分流核心实验目标。

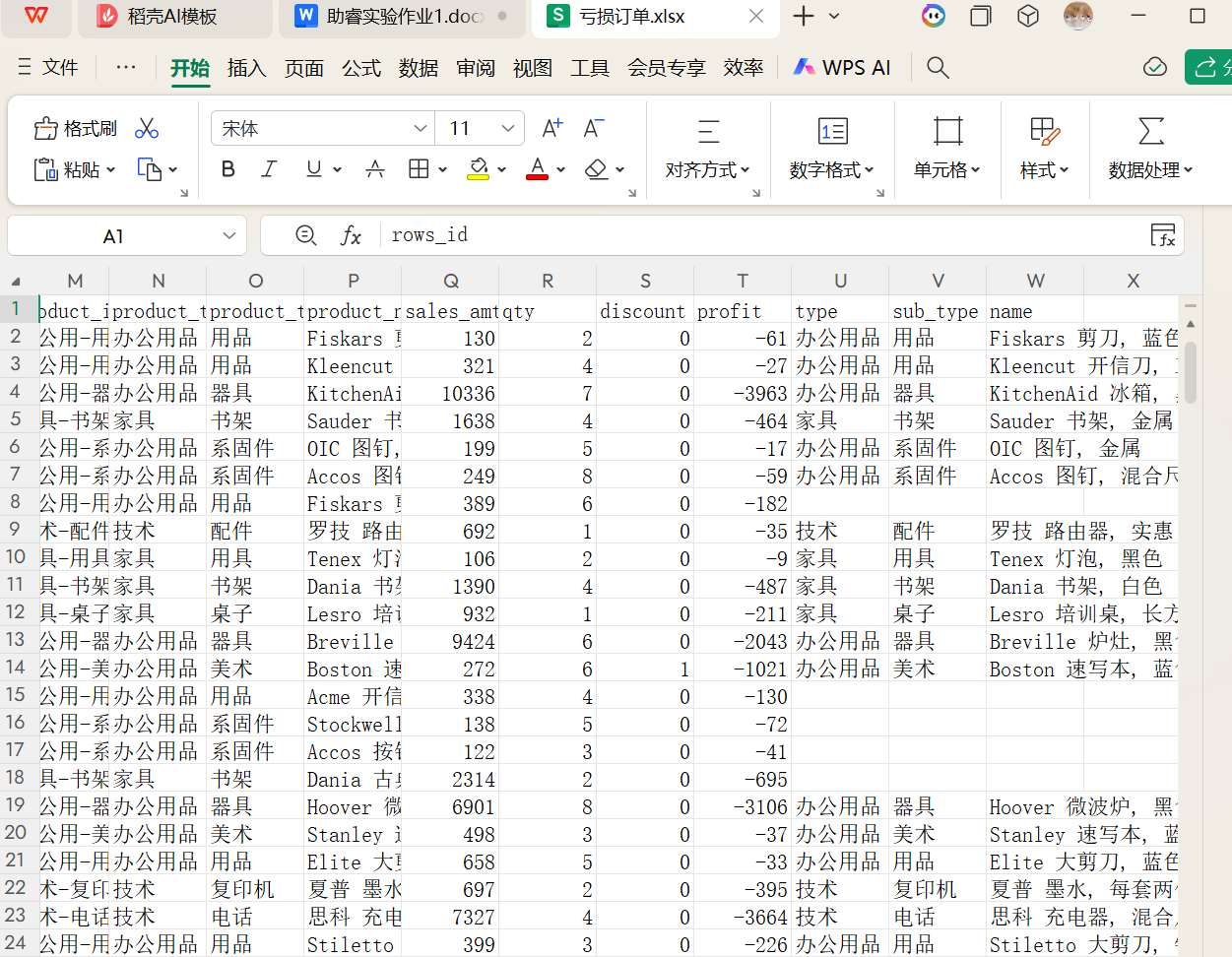

下载两个Excel文件打开查看后可见,数据表已完成订单明细表与产品信息表的左外关联,重复冗余ID字段已全部清理剔除,表格字段整洁规范、数据对应关系准确无误;其中盈利订单Excel文件中,仅留存订单利润数值大于等于0的盈利类业务订单数据,亏损订单Excel文件中,仅留存订单利润数值小于0的亏损类业务订单数据,数据分流精准、分类清晰,完全契合本次实验预设的数据加工业务逻辑和处理要求。通过对结果数据随机抽样核对,原始数据加工转换准确,无数据错乱、数据缺失、分流错误等问题,实验数据加工处理结果有效合规,达到实验预期学习与实操效果。

四、问题与解决

- 问题现象一:Excel输出组件配置后执行转换流无数据输出,文件生成空白:转换流整体运行显示执行成功,但文件库生成的盈利订单和亏损订单Excel文件打开后无任何数据内容,表格空白无加工数据。

- 问题原因:过滤记录组件与两个Excel输出组件之间的连接线类型选择错误,盈利订单未匹配True输出链路、亏损订单未匹配False输出链路,数据无法正常流转至输出组件,导致数据加工完成后无法写入Excel文件,最终输出空白文件。

- 解决方法:删除原有错误连接线,重新搭建过滤记录组件与两个Excel输出组件的传输链路,盈利订单Excel输出组件选择关联True输出链路,亏损订单Excel输出组件选择关联False输出链路,连接线配置完成后重新保存转换流,再次执行运行任务,重新生成的Excel文件即可正常输出对应分类订单数据,问题彻底解决。

- 问题现象二:两个Excel输出组件默认文件名一致,转换流执行时报错运行失败:首次配置完两个Excel输出组件参数后点击执行转换流,系统弹出运行报错提示,转换流任务强制终止,无法完成数据输出。

- 问题原因:平台Excel输出组件默认输出文件名统一为file,两个输出组件未手动修改自定义文件名,系统无法识别区分两类不同输出数据文件,文件命名冲突导致任务执行报错终止。

- 解决方法:分别双击打开两个Excel输出组件配置页面,将默认文件名分别修改为“盈利订单”和“亏损订单”,统一设置文件拓展格式为xlsx,保存配置后重新启动转换流执行任务,命名冲突问题消除,转换流正常运行并成功输出对应结果文件。

五、实验总结

个人学习收获:通过本次订单利润分流数据加工实验,我全面熟悉并掌握了助睿数智Uniplore零代码数据集成ETL平台的基础操作流程,熟练掌握了新建转换流、同步数据源、拖拽添加核心ETL组件、组件参数配置、数据链路连接、任务执行运行、结果文件下载查看的全流程实操技能。同时深入理解了Pipeline转换、Transform步骤、Hops连接等大数据ETL基础专业概念,熟练掌握表输入、记录集连接、字段选择、过滤记录、Excel输出五大核心组件的实际应用场景和配置方法,深刻理解了多表左外关联数据整合、条件数据分流的核心数据加工逻辑。相较于传统代码编写SQL处理数据的方式,零代码可视化拖拽操作更加简单直观,数据流转脉络清晰,排查报错、调试流程更加便捷,大幅降低了大数据数据处理的学习门槛,让我能够快速上手基础业务数据ETL加工工作,为后续复杂数据分析、建模实验打下了扎实的实操基础。

平台整体评价:助睿数智一站式零代码数据科学实验平台操作界面简洁直观,功能分区清晰明确,无需复杂编程代码,零基础也能快速上手大数据ETL数据处理实操,非常适合大数据、数据分析相关专业学生入门学习实训。平台可视化拖拽式操作让数据处理流程可视化、具象化,便于理解大数据ETL核心原理和数据流转逻辑,配套数据源同步、组件配置、结果输出等功能完善,运行稳定不易出现系统故障,能够很好满足日常课程实验教学和基础数据加工实操需求,是适配学生学习大数据数据分析知识、锤炼实操技能的优质实训平台。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)